fala pessoal hoje a gente vai conversar sobre Será que a inteligência artificial está criando um cérebro digital é exatamente isso e vocês já até sabem nosso queridíssimo professor Miguel nicolelis vai se chacoalhar com o esqueleto até não poder mais se ele estava dormindo pode ter certeza que agora ele vai acordar porque ée o tipo de notícia que ele detesta e que a gente já sabe que ele vai dizer que não mas eu quero mostrar o ponto e eu quero mostrar o que que eu tô observando E por que que eu tô dizendo isso Então vem

comigo é isso aí vamos L Então pessoal Sempre agradecendo a todo mundo que deixou o seu like e a todo mundo que se inscreveu um agradecimento especial a todos os membros do canal que patrocinam esse canal aqui de Inteligência Artificial e hoje a gente vai levantar uma pergunta aqui que de filosófica não tem nada ela está se tornando uma coisa muito prática e parece que é isso que está acontecendo será que estamos criando um cérebro digital com a inteligência artificial com as evoluções que estão acontecendo e com todas as etapas que estão acontecendo e eu

gosto sempre de lembrar do nosso professor nicolelis porque ele é um grande crítico da Inteligência Artificial que ele sempre disse que a inteligência não é inteligente e nem artificial tem um vídeo aqui que eu comento aqui o ponto de vista dele e o que que eu penso sobre aquele ponto de vista mas uma coisa importante que a gente tem que falar e que eu não falei até agora é que de acordo com que se estuda sobre neurociências aproximadamente entre 500 e 600 milhões de anos atrás surgiu o primeiro neurônio ou os primórdios do neurônio os

fundamentos do que seria o nosso cérebro hoje esse número é importante porque são 500 milhões de anos não é meia hora não é uma hora não é um mês nem um Milênio 500 a 600 milhões de anos sem falar que antes do sistema nervoso teve que desenvolver toda a vida e tudo mais e que se a gente for fazer um paralelo a inteligência artificial surge ali na década de 40 50 Isso significa que não temos nem sequer 100 anos de Inteligência Artificial imagina o que que aconteceria se fossem 500 milhões de anos de Inteligência Artificial

aonde é possível chegar com tudo isso dito isso nós estamos realmente num processo evolutivo e uma coisa que muitos críticos sempre falam a inteligência artificial não faz isso a inteligência artificial não faz aquilo esse tipo de crítica não faz o menor sentido porque é uma área em construção é uma área em desenvolvimento ela está evoluindo e tudo que vem sendo pesquisado tá sendo melhorado ao longo do tempo acima de tudo porque falar a inteligência artificial não faz isso é uma grande injustiça diante da grande quantidade de técnicas diferentes de inteligência artificial algoritmos genéticos redes neurais

grafos lógica fuz e um monte de outras coisas que não são só redes neurais que não são só llms mas em se tratando de llms a gente precisa dar uma olhadinha e entender um pouquinho por que eu tô dizendo que estamos criando um cérebro digital Então vamos lá para nosso caderninho de rascunho Como que é o modelo clássico lá o começão da Inteligência Artificial teríamos as entradas que a gente chama de inputs e a gente tem os neurônios aqui essas entradas elas se conectam com esses neurônios e elas fazem uma série de contas aqui uma

série de cálculos e elas têm uma saída você pode definir se vai ser uma saída só se vão ser duas se vão ser TR e os neurônios de saída vão se conectar com eles aqui E esse aqui é arquitetura clássica você já deve ter visto isso aqui em algum lugar podem ter mais camadas intermediárias né eu posso transformar essa saída numa camada intermediária e definir que tem mais uma saída aqui que vai lá para lá depois eu posso definir que tem mais uma aqui ó e que tem mais um neurônio aqui ó e conecta todo

mundo ali e que a saída é essa E aí eu começo a criar camadas Inter intermediárias essas camadas intermediárias aqui conforme a gente vai colocando muitas camadas mas muitas camadas mesmo a gente vai dizendo que isso aqui vai se aprofundando e daí surge a expressão Deep learning Deep significa profundo e esse modelo seria basicamente assim eu posso colocar uma foto aqui e aí cada Pixel dessa foto seria uma entrada então se essa foto tem 1 milhão de pixels Eu precisaria ter 1 milhão de entradas aqui muitas entradas e se nessas fotos eu tô tentando identificar

um gato um cachorro então poderia ter duas saídas essa aqui para gato e essa aqui para cachorro então ficou claro né milhões de entradas e uma saída para gato uma saía para cachorro mas e se eu quisesse identificar gato cachorro e galinha Então gato cachorro e galinha coloca mais uma e se fosse gato cachorro galinha e cavalo Põe mais uma né cavalo elefante não sei o que lá e você treina essa rede neural para isso aqui você vai ter os dados das entradas que são fotos de gato foto de cachorro foto de cavalo você faz

as marcações nela e aqui você identifica se fosse uma rede neural de texto uma llm ao invés de ter milhões de entradas aqui que seriam os pixels a gente vai ter o que a gente chama de janela de contexto que é onde a gente coloca o texto que a gente vai colocar na entrada e ao invés da palavra ser gato cachorro e cavalo vão ser as palavras do alfabeto desde lá do começo ah Aleluia alface coisas assim com a letra a depois a letra B depois a letra C Isso significa que conforme eu coloco um

texto aqui na frente que pode ser uma pergunta por exemplo Qual a capital do Brasil e aí ele vai ter que prever qual palavra que ele vai falar na sequência e essa palavra pode ser por exemplo a letra A porque ele vai responder a capital do Brasil e a Brasília mas a rede neural só responde uma palavrinha por vez fechou quando é llm e outra coisa importante a llm já não tem mais essa arquitetur Zinha simples aqui ela é um pouco mais complexa Mas nós vamos chamar tudo isso de uma caixinha preta que tem escondido

e a gente não sabe o que tem ali dentro Isso aqui é uma llm então a gente coloca uma pergunta joga dentro da caixinha preta e a caixinha vai dar uma única a palavra que a gente vai chamar de resposta só que se a minha pergunta é Qual a capital do Brasil e a resposta foi só a letra A não ajuda muito né a gente quer saber a resposta inteira o que que eu faço eu pego a pergunta somo com a resposta um vou chamar isso aqui de resposta um jogo de novo dentro da nossa

caixinha e ele vai me gerar uma resposta dois que é uma nova palavra que pode ser por exemplo a capital e assim por diante você pega essa palavra que ele gerou a resposta dois aí a pergunta mais resposta um mais resposta dois e assim por diante joga na caixinha gera mais uma resposta três e por aí vai Vocês entenderam né esse ciclo aqui é infinito até que chega o momento que ele dá uma resposta final que é um caractere especial que diz terminei Fechou tá entendido é assim que funciona a llm na hora dela fazer

uma geração de resposta então de forma resumida a gente pega uma pergunta joga numa caixinha e entra num loop de perguntas e respostas incremental aqui até chegar no componente final encerra a pergunta fechou entendido isso então como seria num ser humano fazer uma pergunta se eu chegasse pro ser humano e perguntasse Aonde que fica a padaria mais perto o ser humano e eu vi essa pergunta e lá no cérebro dele isso aqui juro para vocês isso aqui é um cérebro essa pergunta vai entrar pelos ouvidos dessa pessoa esse ouvido vai processar essa informação lá no

cérebro e depois lá do cérebro vai jogar pra boca e ele vai dar uma resposta Fechou tá entendido mas tem uma coisa bem diferente que tá acontecendo aqui no cérebro que não tá acontecendo nessa caixinha preta aqui o cérebro não simplesmente Começa a responder com Conforme você manda a pergunta ele não vai lançando uma palavra de cada vez conforme vai respondendo ele começa a pensar aqui dentro antes de responder ele começa a pensar ele começa a imaginar o que que ele deveria fazer se ele vai por uma rua ou outra se ele vai por um

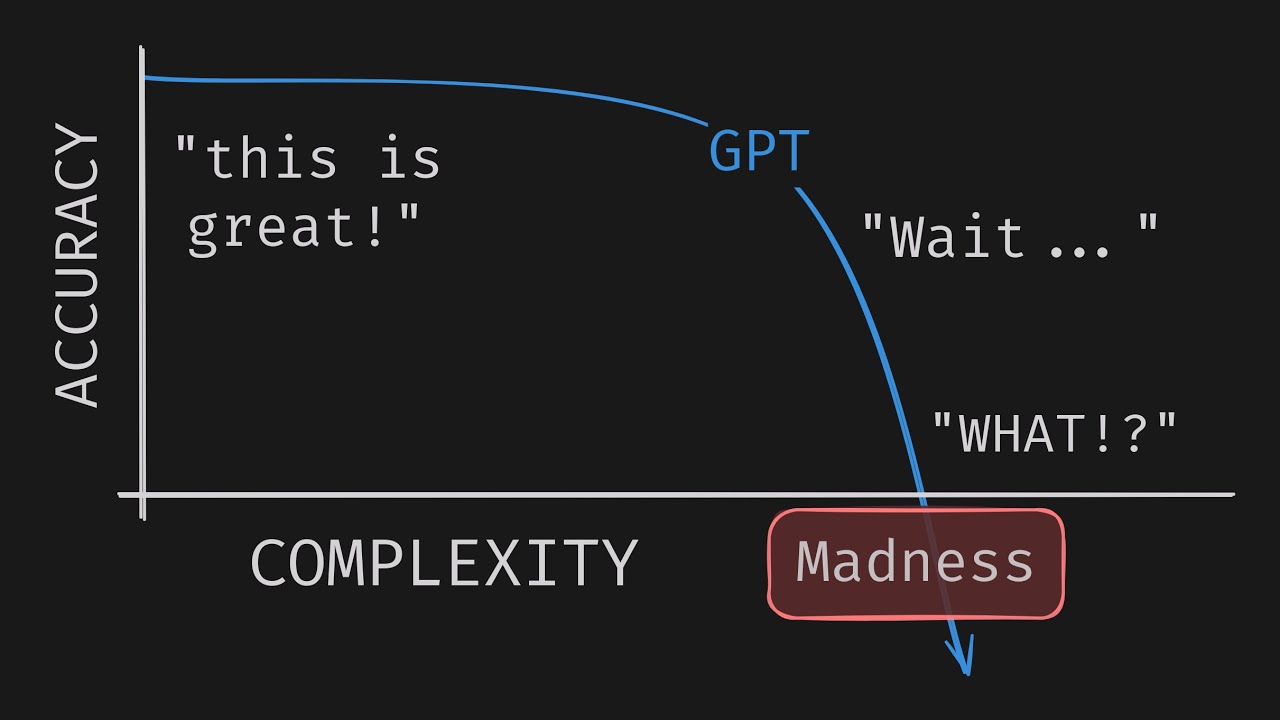

caminho mais longo pelo caminho mais curto se a pessoa não conhece a região Qual que é o caminho mais fácil ela pensa um monte de coisas a inteligência levanta hipóteses pensa uma série de informações e só depois que a pessoa responde isso é bem diferente do processinho dessa caixinha preta nessa caixinha preta quando você perguntou qual é a é a capital do Brasil ela não reflete ela não faz nada ela começa a jogar palavras e jogar palavras e jogar palavras e jogar palavras e ela não está pensando não tem um raciocínio não tem nada é

um monstre de cálculo matemático calculando a próxima palavra e que no fim aquele texto corresponde a uma pergunta que pra gente faz sentido Então significa que essa resposta da rede nural Ela é bem diferente do cérebro humano perfeito perfeito bom o que que tá acontecendo hoje E por que que eu acho que a gente tá indo num caminho de criar um cérebro digital Porque hoje a gente tá fazendo o seguinte seguinte eu tenho a minha pergunta e eu vou mandar a minha pergunta para um sistema e agora a coisa aqui começa a ficar um pouco

mais complexa um pouco mais divertida essa pergunta agora eu posso passar para uma llm e essa llm pode ter a seguinte instrução levante três hipóteses para responder essa pergunta fechou quando ela terminar essa resposta ao invés de mandar essa resposta pra pessoa que perguntou eu posso pegar esse prompt de resposta e jogar de novo para uma llm e falar dessas três hipóteses Qual que é a melhor e porquê tá essa ll M agora tem uma nova tarefa depois que ela faz essa avaliação eu posso inclusive passar por uma próxima llm e perguntar para essa próxima

LM baseada nessa resposta confirma para mim se essa resposta é real aí essa llm pode chegar numa conclusão não não é real e aí se não for real ela manda passar de novo lá na primeira ela vai gerar novas três hipóteses escolher qual que é a melhor hipótese vai fazer uma correção eventualmente Se tiver tudo certo ela pega e responde para cá E aí sim vai sair uma resposta pro usuário vai sair uma resposta pra pessoa e agora agora as coisas começaram a virar o que a gente chama de reflexão esse processo aqui que ela

fica rodando em looping antes de responder começa a se tornar uma coisa muito semelhante ao que é o cérebro e O interessante é que isso começa a se tornar algo muito semelhante a a gente pensando olhando os nossos próprios pensamentos e pensando sobre o que a gente pensa olhando para aquelas informações que a gente tá gerando e decidindo não isso aqui sim esse aqui não isso aqui eu gostei isso aqui eu não gostei antes de dar uma resposta final e por que que é interessante an perceber isso é interessante porque a gente não fez isso

intencionalmente a gente não tá chegando nesse caminho porque alguém pensou lá no passado que a gente ia fazer isso não a gente está chegando nessas soluções nas soluções de reflexão a partir da prática vendo que aquela caixinha preta não conseguia responder a pergunta a gente começou a fazer reflexão bom se você já entendeu a reflexão então se liga no que tá acontecendo agora perfeito imagina agora que estamos aqui dentro da nossa reflexão e que agora a nossa reflexão dentro daquelas respostas tem teve uma reflexão número um que chegou numa resposta número um teve uma reflexão

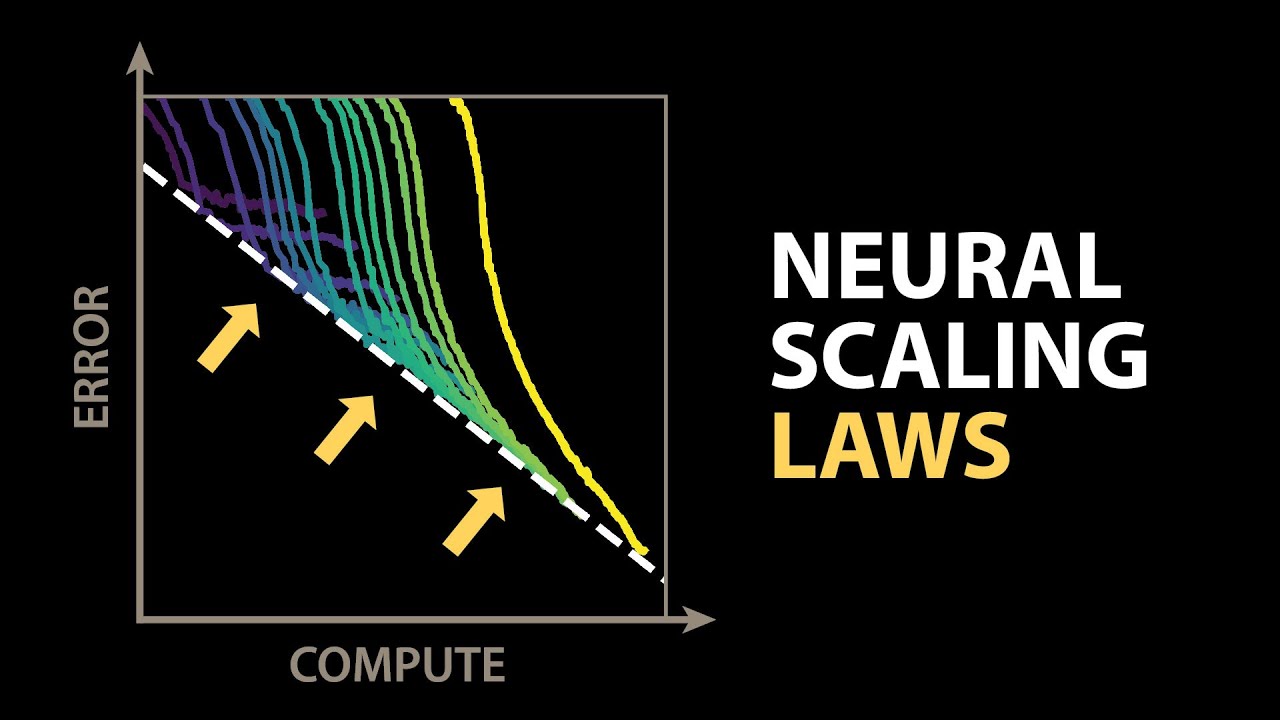

número dois que chegou numa resposta número dois e teve uma reflexão número três que chegou numa resposta número TR essa resposta aqui é uma resposta por exemplo que leva um minuto para falar essa outra resposta leva 5 minutos para falar e essa última resposta aqui leva 10 minutos para falar e as três estão corretas vamos supor que seja esse caso bom nesse caso você começa a perceber que mesmo dando respostas corretas Existem algumas respostas que são mais eficientes do que outras e ISO está fazendo com que aquele processo de reflexão agora comece a entrar num

segundo momento em que você começa avaliar as respostas avaliar a reflexão que ela faz e retreinar sabe quem a caixinha preta lembra da Caixinha Preta A llm então quando você pega uma reflexão que tá levando 10 minutos você mostra pra caixinha preta certas respostas não são adequadas não leva a resposta final num tempo rápido a resposta de 5 minutos a mesma coisa e por outro lado você queria compensas que favorecem a resposta de um minuto e esse modelo de reforçamento começa a favorecer os pensamentos mais eficientes vocês começaram a entender gente existe uma rede neural

artificial e um sistema de reforçamento artificial também e eles estão trabalhando em conjunto agora para fazer com que esse sistema de llm misturado com reflexão e misturado com reforçamento comecem a elaborar um conjunto que tá dando respostas melhores de matemática respostas melhores científicas respostas melhores em todos os outros Campos tá Bob mas o que que isso tem a ver com o cérebro isso tem a ver que a caixinha preta agora começa a mudar de função a função da Caixinha Preta até agora era ser o oráculo a caixinha preta tinha que resolver todos os problemas a

caixinha preta ela tinha que ser aquela inteligência que sabe tudo mas que que tá acontecendo ela sozinha não tá dando certo conforme a gente começa a criar modelos de reflexão e conforme a gente começa a estimular raciocínios lógicos que são mais eficientes do que outros significa que que não importa mais agora Quais são as informações que essa caixinha tem os conhecimentos prévios que ela tem o que ela precisa na verdade agora é refletir e raciocinar corretamente e sabe o que que vai acontecer a hora que a gente começar a fazer isso as bases de dados

gigantescas de trilhões de palavras ou trilhões de tokens isso vai começar a diminuir porque se a gente tá estimulando essa caixinha preta aprender a raciocinar e a refletir e esse sistema que a gente tá criando é um sistema que faz reflexão cada vez mais eficiente a gente só precisa de dados suficientes para aprender a refletir e depois a gente coloca o conteúdo que a gente quiser em cima e essa inteligência vai conseguir refletir em cima disso exatamente da mesma forma como nós humanos fazemos e para fazer isso ela precisa fazer lógica e essa questão da

lógica eu já mostrei faz bastante tempo a inteligência artificial já está fazendo lógica e esses sistemas de reforçamento vão aprimorar ainda mais a qualidade dessa lógica isso porque quando a gente faz algum tipo de lógica por exemplo lógica dedutiva a gente sempre par parte de um ser alguma coisa E então outra coisa você parte de algumas afirmações e chegam a algumas conclusões Se vocês forem perceber esse tipo de lógica tá presente em todo tipo de texto e todo tipo de texto tem em comum uma estrutura sintática uma estrutura da linguagem se esses modelos de llm

começarem a aprender as estruturas sintáticas eles vão começar a fazer lógica cada vez melhor e trabalhar com texto vai ser só um mero detalhe então basicamente agora o que que eu acredito que deve acontecer para 2025 dados de Treinamento cada vez mais curto llms cada vez mais fazendo lógica através dos modelos de reflexão e a gente vai passar os conteúdos as informações que a gente gostaria de fazer perguntas junto com a nossa pergunta e aí a llm com a capacidade dela de raciocinar vai trazer uma resposta com esse raciocínio feito na hora e como seria

isso como se você tivesse explicando a lógica que ela tem que seguir e ela segue então por exemplo se eu falar que o quadradinho Azul tem um cachorrinho e o quadradinho Verde tem um gatinho e eu vi o quadradinho Azul você lógic já entende o que que tá acontecendo e você já sabe se tem um gatinho ou se tem um cachorrinho você não precisa ficar aprendendo Você já tem o conhecimento lógico na sua cabeça e você só bate pronto e já responde e como a gente tá falando de uma inteligência artificial com menos de 100

anos de idade que já fala mais idiomas que qualquer ser humano consegue falar na face da terra que já tem conhecimento sobre mais assuntos que qualquer ser humano na face da terra consegue ter que já tá em vários testes conseguindo resolver problemas que nem seres humanos conseguem resolver e já tá encontrando soluções para perguntas de matemática que nem seres humanos resolveram Isso significa que 2025 tem tudo para ser um ano promissor e para que esses modelos evoluam naturalmente pra inteligência humana considerando todas as diferenças que o neurônio tem e o computador tem eles realmente não

são a mesma coisa eles não são iguais mas os processos de raciocínio e o processo de construção ele é muito análogo ou seja ele não é igual Mas ele tem a mesma função e parece que sem querer a gente tá fazendo a mesma coisa que o cérebro faz porque a gente está sendo justamente orientado pelo nosso cérebro a criar algo uma coisa muito semelhante a ele mesmo a criar uma coisa que foi inspirada no próprio cérebro então não tem muito para onde ir a coisa vai ficar meio parecida mesmo agora se essa inteligência artificial vai

ter consciência se ela vai sentir emoções isso é outra história mas que ela tá ficando inteligente Com certeza ela tá ficando deixa o comentário aqui embaixo o que que você tá imaginando o que que você tá pensando que eu quero saber se você quiser apoiar o canal para continuar vendo vídeos como esse seja membro os membros tem acesso ao grupo do WhatsApp vídeos antecipados É isso aí deixa aquele like valeu