bom antes de partirmos aqui para o terceiro node cluster né Eu quero só fazer aqui uma retrospectiva né do que a gente já falou dos nodes anteriores então resumindo aqui o Basic llm de fato é só para você mesmo pegar ali o prompt né que seria ali a pergunta do seu cliente do usuário e d uma resposta para ele o mais assertivo possível com base ali nas informações que a inteligência artificial tem né na na grande base de dados ali dela tá porém às vezes a inteligência artificial não vai achar resposta para tudo ok como

eu falei principalmente se forse tratando talvez aí da sua empresa de algum produto seu que seja muito recente né E aí nesse caso é que faz sentido você usar o node question ERS né enare né eu tenho dificuldade de falar essa palavra que é o node de pergunta e resposta né onde ele sempre vai estar usando ali uma fonte de dados que você mesmo define ali né pode ser um workflow ali uma informação fixa ou então puxando informações de um PDF de uma página HTML enfim você vai definir a fonte de dados Para quê Para

que quando a inteligência artificial for responder ela vai responder com base naquelas informações então pessoal pergunta ah eh Quanto custa o seu serviço x Quanto custa o seu produto x né tendo essa base de dados o chat de GPT a inteligência artificial já vai conseguir responder de forma assertiva o seu cliente tá então isso aqui é muito utilizado eh em atendimentos né quando você precisa ali criar um bote ali para sempre tá respondendo ali as dúvidas do seus clientes com relação aos seus serviços e produtos né que você tem tá bom e agora o terceiro

node é esse aqui ó deixa eu apagar tudo isso apagar aqui também terceiro node é o summarization tá esse node aqui ele é bem interessante também a proposta que é basicamente resumir um texto né então por exemplo você tem lá um PDF com várias páginas né Cada página ali com vários parágrafos né bastante textos ali falando sobre algo e esse node aqui ele usa a inteligência artificial para poder raspar né todas essas informações das páginas ali de um de um de um arquivo pode ser também uma base de dados alguma coisa assim tá E aí

ele vai meio que fazendo um merge dessas informações né ele vai pegando um pouquinho de cada um ali e vai meio que desenvolvendo o texto né como se fosse uma pessoa mesmo lendo ali um texto completo e tentando resumir ali o que que entendeu tá eu acho isso muito legal porque às vezes você tem ali eh uma fonte de dados né às vezes um PDF de apresentação ali da tua empresa ou de um produto seu e você não quer que o seu bot né chegue ali passa um textão pra pessoa né pessoal a pessoa pergunta

ah O que que significa isso aqui que que é esse teu produto aqui e aí manda um textão pra pessoa Aler não faz sentido é bem melhor ser um texto bem resumido Mas falando Praticamente tudo ali do produto tá E aí isso é possível com esse node aqui beleza eh e aí olha só que interessante aqui você pode marcar essa opção aqui em data para para ser resumido né e você pode colocar aqui o user document Loader tá ué não adicionei ele não Ah tá adicionei E aí quando você faz isso ele habilita essa opção

aqui ó para um subnode do tipo document né então antes de colocar aqui um um subnode de documents eu vou colocar aqui um modelo que é o open né chat GPT tá eh e aqui eu já posso colocar eh deixa eu ver aqui um binário né aqui ó quando você coloca documen né você pode escolher aquela opção lá deixa eu apagar porque eu acabei não falando né e tem dois aqui tem o do github né E tem tem o default data Loader né então você pode escolher esse aqui aqui no tipo de dado você pode

deixar como binário tá para ele poder e aceitar né qualquer tipo de arquivo ali binário pode ser um TXT um PDF uma página HTML enfim tá E aí você pode deixar aqui para detectar automaticamente ou então se você quiser especificar o arquivo Você pode você pode botar se é um csv se é um um PDF né se é um um Jon se é um DOC x né enfim pode deixar aqui automaticamente beleza ok já aqui em Tex SP Splitter né é para você definir ali o delimitador ou seja esse node aqui ele vai extrair as

informações ali por exemplo de um PDF A gente vai usar aqui um exemplo de um PDF tá e e para cada página ali ele vai meio que separar em índice né como ele criasse ali um arrei com vários índices e cada índice ali é um é um pedaço do texto né E aí você pode escolher Como você quer que faça essa separação se você quer que faça por algum delimitador ali no texto ponto vírgula ou se você quer que a delimitação seja por exemplo por token né aqui no caso eu tô colocando aqui seria por

caracter né Aí como eu falei se você quer separar texto ali por vírgula ou pro ponto eem vírgula por exemplo se é um csv você tá subindo uma planilha faz sentido usar o caracter tex Splitter porque você passa ali um delimitador que geralmente é vírgula ou ponto e vírgula que separa um contato do outro tá mas como no caso aqui a gente vai usar um exemplo do do PDF né e o próprio chat GPT vai estar gerando esses pedaços de textos né esses pedaços de texto A gente dá o nome de token né como eu

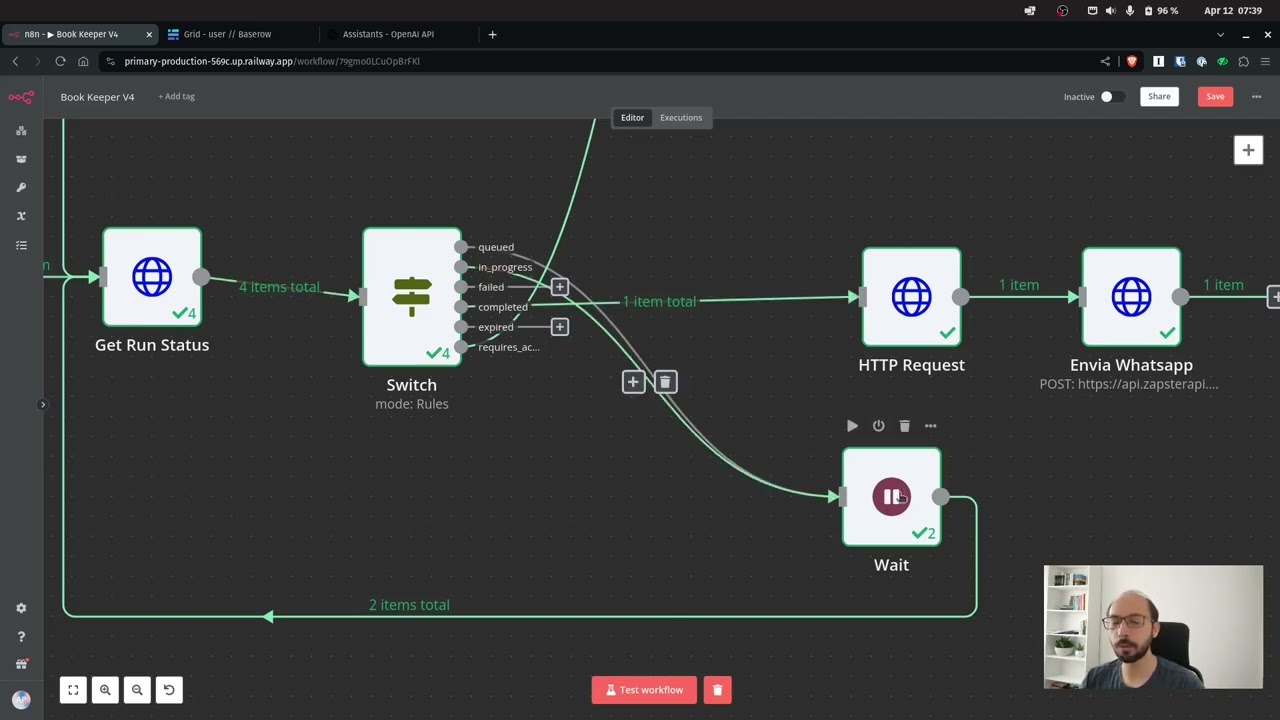

informei cada partezinha ali de uma informação gerada pelo chat GPT é um token tá então eu vou escolher token mesmo ok E aí eu posso deixar aqui nesse valor padrão tá e pronto e aí eu finalizo colocando aqui ó depois do start um node de http request Hugo Por que http request porque ele serve não só para você fazer chamada api mas para também você puxar informações por requisição http às vezes de um site você botar um site aqui e o site não tiver sistema de bloqueio de raspagem de dados web scrap você vai conseguir

extrair todas as informações do site por meio ali do HTML tá E no caso aqui a gente vai usar PDF Então eu peguei um link aqui de um PDF na web que fala sobre o Bitcoin tá então eu vou colocar aqui ó tem que terminar com a extensão do arquivo tá e você deixa aqui no método get tá aí eu posso botar aqui ó obtém informações do PDF ou então posso botar extrai texto do PDF tá E aí conecto aqui tá deixa eu dar um zoom aqui para ficar melhor pronto e aí o que que

vai acontecer se eu der um test workflow aqui o htp requ vai pegar as informações do PDF vai jogar pra Inteligência Artificial que vai varrer todas as páginas Ok se não me engano são nove páginas que tem esse PDF por isso que ele retornou aqui nove porque ele conseguiu ler as nov As nove páginas né pegando o trecho de texto de cada uma delas tá eh e aí Claro fez a a devida separação aqui tá E aí com o texto que ele extraiu de cada página né Eh com a as devidas separações ele conseguiu meio

que fazer um merge fazendo ali um resumo de tudo que envolve o PDF tá por exemplo se eu abrir aqui o pdf Ó você vai ver que de fato são nove páginas tá e repleta de informações aqui tá ó tá vendo ó é falando aqui sobre o Bitcoin então ó temos introdução transações os servidores prova de trabalho tá vendo ó muita informação né então Imagine você tendo tem que passar isso tudo aqui para o cliente né o cliente pergunta ah e resume aí para mim como funciona Bitcoin tal aí imagina você tem que passar isso

aqui tudo né então esse summarization né ele vai fazer um resumo de de todo ali seu arquivo né que você passar então quando eu abro ele aqui ó olha só que interessante ele resumiu tá vendo ó ainda botou assim ó este documento descreve o conceito de Bitcoin como sistema de dinheiro eletrônico tá vendo ó o sistema proposto utiliza provas computacionais tal tá vendo ó a blockchain sentiva honestidade ou seja de nove folhas ali ó ele resumiu aqui ó em um simples texto ó de um parágrafo só tá então É bem interessante esse node Aqui também

tá ele serve também para você poder passar ali uma uma informação uma pessoa que pergunta sobre algum serviço ou produto seu mas você quer passar uma resposta mais resumida possível pra pessoa já bateu o olho e entendeu o que que se trata Ok então é isso aí tá Agradeço atenção e nos vemos na última aula Onde vamos estar explorando o node cluster mais completo né e posso dizer que um dos mais utilizado aí nas automações tá bom valeu