recientemente hubo una sesión de preguntas y respuestas ama con Sam alman en redit donde se tocaron 10 puntos clave que creo que deberías conocer vamos a entrar en materia sin perder tiempo el primer punto clave se titula espera qué porque realmente es uno de esos momentos de sorpresa alguien pregunta si la Inteligencia artificial general agi se puede lograr con el Hardware actual o si será necesario algo completamente diferente Esta es sin duda una de las preguntas más importantes que se pueden hacer sobre la agi ya que suele haber mucha especulación sobre los requisitos de Hardware

necesarios algunas personas piensan que necesitaremos Hardware biológico mientras que otros creen que será necesario un ordenador cuántico para conseguirlo sin embargo Sam alman Afirma claramente que creen que es posible lograr la agi con el Hardware actual es importante destacar que altman dice creemos que es posible lo que no significa que sea 100% alcanzable pero implica que tienen una hoja de ruta hacia la agi sin depender de un cambio drástico de Hardware esto no quiere decir que no puedan beneficiarse de Hardware nuevo y mejorado sino que en su perspectiva el Hardware actual no es el principal

obstáculo también deja entre ver que la clave para alcanzar agi no está tanto en el Hardware sino en el avance de la investigación en ia la optimización de algoritmos y quizás en la calidad de los datos esto sugiere que Open Ey ha visto indicios de que el hardware no es el problema central el foco está en los algoritmos y en escalarlos adecuadamente para alcanzar nuevos niveles de capacidad una vez se logre la agi con el Hardware actual es es probable que el Hardware especializado en la ia acelere el proceso posiblemente de 10 a 20 veces

lo que significa que el desarrollo de la agi podría llevar mucho más rápido de lo que inicialmente pensamos el segundo punto clave es el modelo 01 frente a su versión preliminar 01 preview ya que muchas personas están familiarizadas con el modelo 01 un nuevo paradigma en modelos que piensan Antes de hablar alguien preguntó si el modelo completo 01 representa realmente Una mejora notable respecto a la versión de prueba y el vicepresidente de in ería de Open eye confirmó que sí Para quienes estén usando la versión 01 preview es probable que al tener acceso completo a

01 noen una gran diferencia de hecho hubo un pequeño incidente en el que 01 se lanzó accidentalmente y algunas personas pudieron probarlo brevemente con imágenes según las pruebas de rendimiento 01 es entre un 10% y un 15% mejor en diferentes métricas esto significa que en áreas d01 preview podría parecer menos competente el modelo completo debería ofrecer mejoras claras para quienes encuentren dificultades con 01 preview se recomienda proporcionarle el mayor contexto relevante posible esto implica dar detalles específicos que puedan ayudar al modelo a razonar mejor sobre el problema como por ejemplo en temas de salud incluir

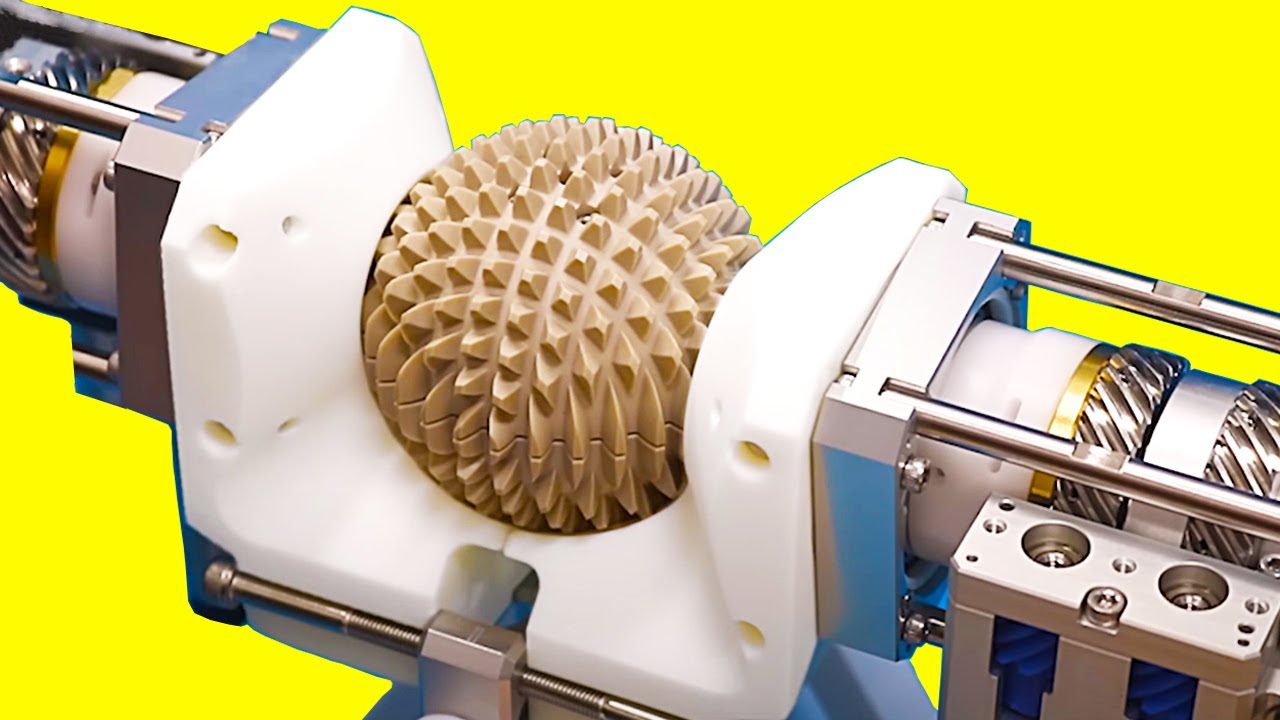

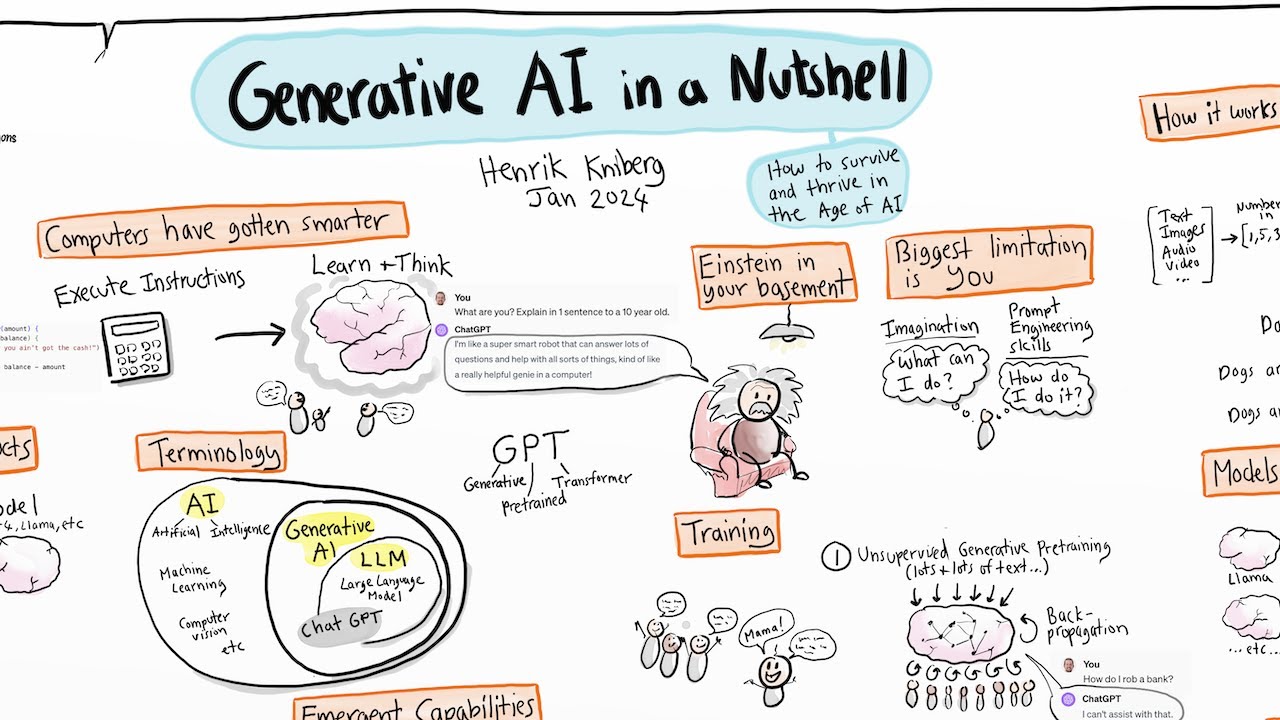

información relevante como edad hábitos de vida etnia etcétera este tipo de contexto ayuda a que el modelo haga saltos de razonamiento más precisos y útiles en el tercer punto se aborda el futuro de la escalabilidad de los modelos de lenguaje alguien preguntó si el modelo 01 influirá la escalabilidad de los llms Y si Open Ey se centrará en escalar los modelos de acuerdo con las leyes de escalado tradicionales o en modelos más pequeños Que ofrezcan tiempos de inferencia más rápidos y prolongados aquí Kevin el director de productos de Open eye responde que no se trata

de un enfoque exclusivo de uno o de otro sino de ambos mejores modelos base combinados con mejoras en el tiempo de inferencia y escalado computacional este enfoque Dual tiene mucho sentido al compararlo con el modo en que los humanos procesamos información las personas empleamos dos tipos de pensamiento el sistema uno que es rápido e intuitivo como responder inmediatamente Cuál es tu comida favorita y el sistema dos que es más lento y deliberado como planificar una ruta los humanos alternamos entre estos sistemas según el tipo de problema y algo similar sería ideal para los sistemas de

ia que busquen acercarse a la agi en el futuro estos sistemas probablemente adoptarán un proceso similar decidiendo de manera automática si una pregunta necesita una respuesta rápida o un análisis más profundo utizando así los recursos computacionales y el tiempo de inferencia para ofrecer respuestas que sean tanto rápidas como bien razonadas según el contexto esto permite un balance entre respuestas inmediatas y procesos de razonamiento más detallados lo cual será crucial para lograr una agi efectiva en el cuarto punto se aborda el tema de las alucinaciones en los modelos de ia que aún persisten alguien agradeció el

trabajo de Open eye y preguntó si las alucinaciones serán una característica permanente de estos modelos especialmente porque en la versión 01 preview el modelo parece alucinar más a medida que se acerca al final de una cadena de pensamiento también cuestionaron cómo opene manejará los datos antiguos de hasta 2s años que pueden estar obsoletos la solución será un entrenamiento continuo de los modelos o algún tipo de recolección de basura de la información este problema con la veracidad y actualización de los datos es relevante ya que los modelos de ia actúan como cápsulas de tiempo entrenados con

información hasta una fecha de corte específica como abril mayo o junio de un año particular después desa fecha los modelos no tienen conocimiento actualizado lo que es especialmente problemático en esta era de la ia donde las cosas evolucionan rápidamente aunque los modelos pueden usar funciones de búsqueda para Actualizar información los datos obsoletos siguen siendo un reto cuando se intenta razonar sobre hechos o paradigmas cambiantes el vicepresidente de investigación de Open eye respondió que están dedicando mucho esfuerzo a reducir las alucinaciones en los modelos una prioridad clave para mejorar la precisión y confiabilidad de la ia

el vicepresidente de investigación de Open eye señaló que que las alucinaciones son un problema fundamentalmente difícil de resolver ya que los modelos aprenden de textos escritos por humanos quienes a veces afirman cosas con seguridad sin tener plena certeza aunque los modelos están mejorando en citar Fuentes confiables para respaldar sus respuestas Open Ey cree que el aprendizaje por refuerzo ayudará ya que al poder verificar de manera programática si los modelos alucinan podrían recibir recompensas por evitarlo esta situación es alentadora para quienes temen que la ia pueda reemplazar sus trabajos pero menos favorable para quienes buscan usar

chat gpt o gpt 4 en aplicaciones de alta precisión los modelos generativos debido a las alucinaciones no son adecuados para ciertas áreas ya que los errores en algunos sectores como el de la salud pueden tener consecuencias muy graves Aunque estos modelos pueden ofrecer diagnósticos o resúmenes bastante útiles los estándares de fiabilidad y las regulaciones en Industrias sensibles hacen que sea improbable que se adopten a gran escala hasta que la fiabilidad sea extremadamente alta imagina un modelo con una tasa de error o alucinación de Del 3 al 5% sería como si cada tercer o quinto avión

se estrellara o cada tercer motor de coche explotara estos niveles de fallo serían inaceptables Open eye reconoce que este es probablemente uno de los mayores desafíos para el uso comercial amplio y seguro de la ia en sectores críticos Y si dicen que es un problema complejo es porque realmente lo es el siguiente punto clave es el próximo gran Avance en la línea de productos de gpt y según alman ese avance serán los agentes Aunque Open continúa mejorando sus modelos alman menciona que los agentes serán el próximo salto importante esto apunta a que Open eye está

trabajando en agentes que podrían ofrecer una fiabilidad y autonomía superiores a lo que hemos visto hasta ahora ya existen proyectos de agentes con empresas como Microsoft y Google con el proyecto Astra pero el enfoque de Open eye en desarrollar agentes autónomos podría suponer un cambio significativo en la ia Dado que los agentes requieren consistencia y fiabilidad a largo plazo Open eye suele estar en la vanguardia de estos desarrollos y cuando lanzar algo nuevo tiende a marcar una gran gr diferencia en la industria dejando otras empresas intentando ponerse al D ese avance podría abrir la puerta

a un sinfín de aplicaciones y es algo que según Open Ey merece la atención como el próximo granito en el mundo de la ia el sexto punto claves trata sobre Cómo sobrevivir en la era de la ia un tema relevante para quienes se preocupan por la economía post agil ante la pregunta de Qué habilidades cultivara Si tuviera 15 años hoy en día el coanfitrión de la charla respondió que la adaptabilidad y la capacidad de aprender son las habilidades más importantes en un mundo en constante cambio la adaptabilidad se convierte en una cualidad esencial no se

trata solo de poseer habilidades actuales sino de aprender a aprender rápidamente y de manera eficiente convirtiendo ese conocimiento en habilidades prácticas con la aparición de nuevas industrias y la desaparición de algunas tradicionales aquellos que puedan adaptarse y adquirir nuevas competencias de forma continua será quienes tengan mayores oportunidades de éxito en el futuro adaptarse o quedarse atrás Parece ser el lema en esta era impulsada por la ía uno de los temas más comentados ha sido qué vio Ilia una pregunta que estuvo en tendencia en Twitter durante semanas después de que routers publicara que Open eye había

desarrollado una ía avanzada potencialmente peligrosa Sam alman respondió diciendo que Ilia vio el futuro trascendental lo describió como una persona con una visión increíble capaz de ver el futuro con más claridad que casi nadie según alman Ilia fue fundamental en la formulación de las ideas iniciales que llevaron al desarrollo de modelos avanzados como el 01 se rumorea que Ilia podría fundar su propia empresa dedicando todos sus recursos a alcanzar la superinteligencia pasando incluso por encima de la agi A diferencia de Open eye que trabaja dentro de ciertos límites y plazos de productos Ilia podría concentrarse

exclusivamente en esa meta lo que le daría una ventaja en cuanto a enfoque y recursos computacionales si logra la superinteligencia antes que Open eye podría cambiar el mundo en un solo día algo que todos en la industria persiguen actualmente sin duda es un momento fascinante y lleno de expectativas en el campo de la a avanzada en el octavo punto se destaca el modo avanzado de voz y visión una función que mucha gente ha olvidado pero que sigue siendo emocionante alguien preguntó sobre el cronograma para el modo avanzado de voz con visión Y por qué gpt

5 y el modelo completo 01 tardan tanto en salir Sam alman explicó que Open eye está priorizando el lanzamiento de 01 y sus Sucesores ya que los modelos se han vuelto bastante complejos y no es posible lanzar tantas funciones en paralelo como les gustaría deben tomar decisiones difíciles sobre cómo asignar sus recursos computacionales en pocas palabras el modo avanzado de voz y Visión Es una característica genial pero no tiene retorno de inversión esperado porque probablemente no tendrá un uso tan amplio como otros desarrollos en cambio Open eye se centra en el modelo 01 que es

un modelo de vanguardia mucho más avanzado y con aplicaciones que interesan especialmente a sus clientes empresariales además con modelos futuros como el 02 03 y potencialmente hasta el 05 podrían estar acercándose a la agi e incluso la asi superinteligencia oficial esto es son ambicioso Pero considerando la evolución de gpt desde su primera versión hasta gpt 4 los avances parecen posibles Especialmente con mejoras en la escalabilidad de la inferencia por si no recuerdas de qué se trata el modo avanzado de voz y visión fue presentado en una breve dem modela app Be My Eyes que permite

a personas con discapacidad visual tomar una foto de algo y recibir ayuda de otros usuarios que describen lo que aparece en la imagen con este modo avanzado de voz y visión en lugar de depender de personas aleatorias la gua de chat gbt se convierte en los ojos de quien usa la app básicamente funciona como una transmisión en vivo similar a una videollamada en facetime en la que la illa observa lo que el usuario está viendo y ofrece descripciones detalladas en tiempo real este tipo de aplicación Es verdaderamente innovadora ya que permite a las personas con

discapacidad visual realizar tareas cotidianas con mayor facilidad en el ejemplo de la demo alguien usó el modo avanzado para reservar un taxi y recibir indicaciones detalladas Como cuándo levantar la mano para detenerlo este tipo de ía promete mejorar significativamente la vida de personas con discapacidades haciendo que tareas comunes sean mucho más accesibles que una vez que esta tecnología esté disponible a gran escala en el siguiente punto se preguntó cuándo se actualizará el modelo de generación de imágenes y texto ya que Dali 3 se considera algo desactualizado Sam alman respondió que la próxima actualización valdrá la

pena pero que aún no tienen un plan de lanzamiento lo cual indica que no es su prioridad en este momento como mencionó anteriormente su enfoque principal ahora mismo es el modelo 01 y los agentes Así que mientras Open Sigue avanzando en el modelo 01 y en el desarrollo de agentes autónomos es probable que no veamos novedades importantes en el área de generación de imágenes hasta que estos proyectos más prioritarios se consoliden otro punto interesante es que Open eyee está trabajando en ampliar la ventana de contexto de sus modelos alguien comentó que la ventana de 32,000

tokens gpt 4 es insuficiente para tareas extensas de codificación o escritura especialmente en comparación con otros modelos de ia la respuesta fue Clara openen está de acuerdo y ya está en ello para quienes necesitan manejar grandes volúmenes de información en una sola conversación una ventana de contexto mayor permitirá trabajar con textos o proyectos largos sin perder detalle Esto será una mejora significativa para tareas complejas y de Gran alcance facilitando mucho más la experiencia en proyectos prolongados Por último el punto número 11 se centra en las funciones avanzadas de generación de modelos 3D e imagen en

gpt 4.5 alguien preguntó cuándo tendríamos información sobre la generación de imágenes de los 3D en gpt 40 y la respuesta fue que sería pronto además mostraron una captura de pantalla de un editor en tiempo real de html que parece ser una de las características que se lanzarán primero en gpt 4.5 gpt 40 que en realidad es un modelo ovni entrada y salida de cualquier tipo de dato tiene potencial para trabajar con audio imágenes vídeos y modelos 3D Aunque muchas de estas funciones aún no se han lanzado el editor html en tiempo real permitiría a los

usuarios ingresar contenido y verlo o manipularlo en tiempo real lo cual sería una herramienta bastante útil y emocionante aún no se sabe la fecha exacta de lanzamiento pero parece que esta capacidad está en camino Y promete Añadir una nueva dimensión interactiva a las capacidades del modelo acabo de lanzar mi proyecto más grande hasta la fecha una newsletter sobre Inteligencia artificial con la que podrás mantenerte Al Día de todo lo que está pasando con tan solo 5 minutos te lo resumo día a día tendrás el link en la descripción Así que si te interesa regístrate que

es totalmente gratuito Saludos y Level labs Es una herramienta de ía generativa de voz que ofrece una de las tecnologías de texto a voz voz a voz y también clonación de voz más avanzadas del mercado quieres crear voz de narradores realistas para tu contenido o necesitas un lector de texto fácil de usar y Level labs tiene la solución