bonjour à tous je suis très content de vous retrouver poser de nouvelles vidéos et aujourd'hui on va parler de kafka et pour moi vraiment quand on parle de kafka le plus important vraiment c'est de considérer l'absurde comme un mouvement de déshumanisation vraiment au delà de la métamorphose que l'on pardon ben je parle de l'auteur franz kafka 1 vous en avez pas vous en avez pas à pas jusqu'à oui oui je peux vous expliquer ça aussi tout de suite l'essentiel à retenir en vidéo c'est maintenant et c'est parti mon goût qui [Musique] vous qui connecte et

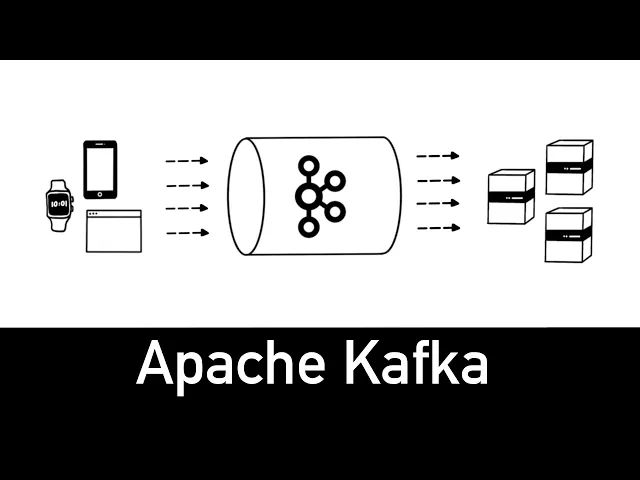

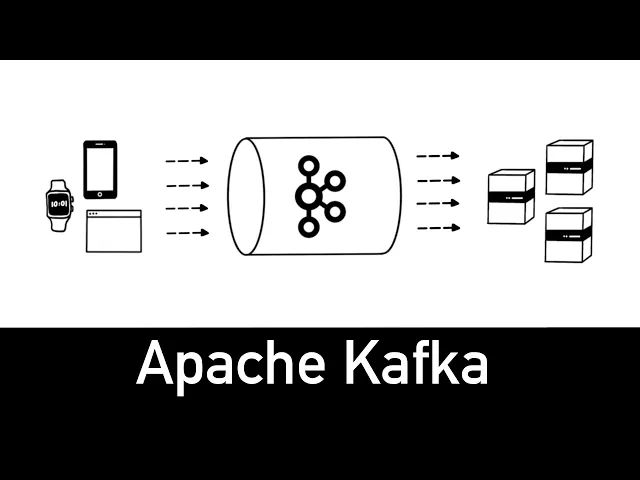

les échanges de données passent par des systèmes producteurs de données qui envoient des données à des systèmes consommateurs de données or chaque système a sa propre façon de communiquer son propre protocole de communication formats de données ou schéma de données ce qui rend l'intégration globale complexe et chronophage pour que tous puissent échanger ensemble et c'est là que kafka intervient en servant d'intermédiaire pour découpler les producteurs et les consommateurs de données kafka est un système de messagerie distribué open source basé sur un mécanisme de publication et d'abonnements facilitant la transmission de messages entre les émetteurs et

les consommateurs de messages aulas est hyper simplifiée mais si vous voulez en savoir plus sur ce pattern dit publish subscribe et des changes asynchrone je vous conseille d'aller voir ma vidéo sur les mom ou messages oriented middleware en gros kafka est conçu pour la gestion des flux de données c'est à dire la collecte depuis plusieurs sources de données appelée producers est ensuite assuré leur distribution à travers plusieurs cibles appelé comme tumors que ce soit en temps réel en batch ou en raquettes réponse est tout ça à grande vitesse et on parle quand même de plusieurs

millions de messages par seconde autre notion importante nos caf car c'est la notion d'événement la lecture et l'écriture donné dans kafka c'est sous forme des veines comme par exemple une action d'un utilisateur sur un site web une température qui passe de 20 à 25 degrés une nouvelle transaction financière etc ensuite ce service kafka et implémenter sous la forme d'un cluster kafka qui constitué d'un ou de plusieurs serveurs implémentant kafka appelé aussi brockers kafka le cluster kafka peut ainsi scale et horizontalement grâce à l'ajout de brokers supplémentaire aux clusters de serveurs en d'autres mots ça va

permettre aux clusters kafka de monter facilement en charge pour pouvoir supporter des volumétries importantes de données et les données envoyées sont conservés jusqu'à l'expiration d'une période de conservation déterminer qui est configurable plusieurs jours moi ou pour toujours kafka peut très bien conserver très longtemps les données cette persistance permet de rejouer les messages s'il ya un problème au niveau du traitement kafka organise les messages en catégorie appelée topix et les topics ce sont des flux particulier de données résultant d'événements ils sont assez similaires à la notion de table dans les bases de données par exemple on

aura un topic transactions commerciales et à notre topic référentiel client ensuite c'est aux pics sont constitués de partitions chaque partition et ordonnée et chaque message au sein d'une partition reçoit un identifiant incrémentielle les producers envoie donc et message dans cette optique est l'icône tumors vont chercher ses messages dans ces mêmes topic et ils peuvent lire les messages à partir du point qu'il soit chaque partition a souvent un ou plusieurs répliques a sur différents brokers kafka en termes de kde usage de caf car on à l'utilisation comme bus de messages distribué avec cette capacité à proposer

des grosses performances avec des transferts de millions de messages par seconde kafka est aussi utilisé pour la supervision en temps réel puisqu'il est souvent intégrés dans des pipelines de données de centralisation de metric des différentes applications de la même façon kafka peut être utilisé pour collecter et agréger les log de plusieurs applications et enfin kafka est principalement utilisé aujourd'hui pour ce qu'on appelle le data streaming le data streaming désigne les échanges de données issues de sources variées surtout généré de manière continue ce qui est indispensable notamment pour des applications qui nécessitent le traitement de données

dès qu'elles sont disponibles au fil de l'eau et qui vont donc analyser et réagir en permanence aux données en continu comme par exemple des applications réalisant la détection de fraudes de la maintenance prédictive du machine learning du trading ou des traitements big data voilà j'espère que cette vidéo vous a plu si c'est le cas et si vous voulez m'aider en retour à produire d'autres vidéo sachez que vous pouvez contribuer au développement de la chaîne via un don sur ma page youtube ou tipi donc n'hésitez pas et puis quant à nous on se retrouve pour une

prochaine vidéo ciao