Bom dia a todos todos aí que estão nos assistindo né presencialmente remotamente é um prazer estar aqui muito obrigado pela oportunidade de falar um pouco sobre o chat PT que é um assunto que tá todo mundo falando é bastante difícil falar algo inteligente sobre o chá de PT hoje em dia porque todo mundo sabe sobre o chefe de PT tudo não pode usar o chat PT no fim de semana saiu uma reportagem de uma página no Jornal Estado de São Paulo no Fantástico saiu uma reportagem semana passada então muita coisa sabida mas talvez seja o

interessante dá uma olhada nas ferramentas básicas que compõem esse tipo de software que parece às vezes um oráculo grego assim que sai coisas lá de dentro você não sabe de onde vieram né então eu acho que eu vou tentar sem falar nada muito técnico sem mostrar equações nem nada procurar dar um pouco do contexto tecnológico que levou ao chat de tempo da história que que nos fez chegar nisso né e quais são os principais ideias por trás desse tipo de aparato desse tipo de dispositivo tá consigo controlar a tecnologia aqui bom a área nós estamos

falando de um dispositivo que tá na área de processamento de linguagem natural é assim que nós nos referimos a área onde está o chat de PT a área que procura entender como é que a linguagem funciona em processar ela computacionalmente essa é uma parte da Inteligência Artificial né que é uma área muito em evidência hoje é uma área que tem uma história né começou lá atrás já tem 50 por aí ela já era discutida já era comentada bom então essa área de processo de linguagem natural é parte da área inteligenciar uma área que tem várias

subdivisões né subdivisões que estão conectadas com os mais diversos Ramos do conhecimento humano né então existe uma preocupação sobre como representar é conhecimento raciocinar que é um tema da filosofia da epistemologia situação de como tomar decisões que é um tema da economia de administração há uma preocupação de como aprender com dados experiência que é um tema da estatística e assim por diante né áreas como visão computacional e procedimento de linguagem natural são áreas que estão mais ligadas a como interagir com o mundo né nos últimos anos a inteligencial passou a ter um pouco esse essa

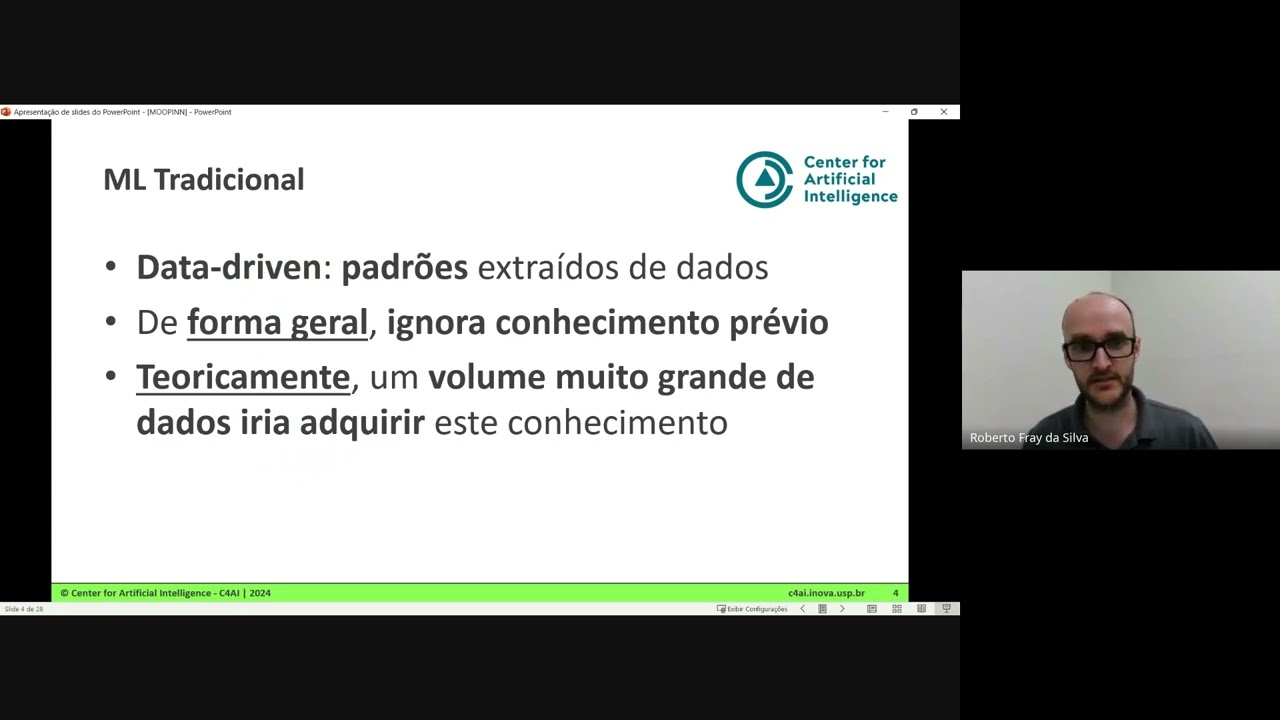

aparência aqui tudo ficou vou dizer contaminado mas ficou influenciado profundamente pela área de aprendizado de máquina é que é uma área onde se a preocupação principal é coletar dados e construir modelos do mundo que possam os padrões como as coisas funcionam que possam se reproduzir isso pela máquina para resolver problemas práticos né eu acho que a chegada do Big Data dos Mega dados né ajudou muito hoje nós temos muitos dados e a capacidade computacional melhorou muito nos últimos na última década com isso nós conseguimos processar mais dados e ter a capacidade de usar aprendizado de

máquina para resolver grande parte dos problemas eu tô usando aprendizado não aprendizagem as pessoas falam aprendizagem de máquina mas as máquinas ainda não vão na escola certo ainda não tem um processo de aprendizagem Então o que acontece é que há um aprendizado para resolver tarefas específicas e a área de processamento de linguagem natural que é uma área importante que é a área onde está todo esse movimento do chat de PT é uma área que teve um crescimento gradual até mais ou menos 2010 e depois teve uma explosão de atividade não é então eu vou falar

mais dos últimos anos até 2010 várias diferentes técnicas né quem quem se lembra do Eliza né que é um programinha que respondia a perguntas era um programinha bastante simples Quem se lembra de modelos de linguagem da década de 90 que respondia Um telefonemas e tal sim isso daí é o passado né as coisas tiveram uma revolução e nós vamos dar uma olhada nessas palavras todas que estão aí depois de 2010 né aprendizado profundo impedis Transformers Bart de PT tem uma série de palavras que são muito técnicas às vezes eu vou procurar só dar as ideias

básicas né para mostrar porque como que a coisa funciona de uma forma bastante abstrata Então quem se lembra dela quem não se lembra o elaisa era um programinha né da década de 60 66 que recebia frases do usuário e respondia simulando um psicólogo né e é muito interessante porque ele funcionava de uma certa forma bastante bem né então se você escrevesse estou infeliz não Então porque você acha que isso está infeliz ele tinha essa capacidade de repetir um pouco os padrões ele funcionava basicamente por regras você colocava um monte de regras e ele respondia o

que as regras diziam que tinha que ser falado essa é uma estratégia muito comum hoje sistemas como dialog floxista ele funciona por regras né a maior parte do chatbots que estão aí no mercado que a gente interage com para fazer comércio eletrônico é baseado em regras ainda né então é são são muito mais sofisticados que o Elisa mas funciona ainda dessa forma os que eu queria dizer isso para não parecer que tá todo mundo já usando já PT comercialmente agora o que é interessante no lilás eu acho que ele mostra um pouco assim que o

ser humano gosta de conversar né Mesmo quando você tem um programa que tem um esquema de padrões bastante simples a gente acha que é uma coisa muito inteligente bom esses bons tempos aí da década 60 70 80 eles progrediram lentamente né e as ferramentas eram baseadas muito em regras e análise linguística aquilo que se aprende na escola análise sintática Qual que é o verbo Qual que é o substantivo Qual que é o sujeito Qual que é o predicado e eu vou contar aqui uma piada do meu tempo de doutorado né faz uns 30 anos é

que era muito comum eu não sei se alguém já ouviu mas a piada era o seguinte tinha um sistema de tradução que funcionavam o estado da arte na época era isso pegava as palavras de uma língua traduzia para outra como se fosse um dicionário dava uma ajeitada se é em português era uma ordem sem inglês e na outra e vamos assim então a piada que tinha um tradutor de inglês para Russo da guerra fria né E esse esse tradutor tinha um tradutor de inglês para Russo para inglês e Alguém escreveu uma frase em inglês traduziu

para Rússia e voltou e usou um tradutor e outro né e a frase que foi colocada é uma frase da Bíblia né que nós usamos em português o espírito é forte mas a carne é fraca e a piada é que a frase foi voltou assim que a vodka é boa mas a carne é uma porcaria né Então por quê Porque se você faz essa tradução por regras realmente O resultado é esse né hoje em dia usando aprendizado você consegue outro tipo de coisa que é o que faz o Google né então se você fizer esse

experimento no Google hoje a frase vai e volta igual né você descreve em inglês vai em russo traz para Inglês fica a mesma frase quem tem interesse nessa piada essa piada saiu até no your time Então qual foi a primeira revolução nesse processo em uma revolução que aconteceu mais ou menos em 90 né nessa época era uma época que o darva né uma agência norte-americana de financiamento da pesquisa estava muito interessado em sistemas de tradução e houve uma série de avanços né em várias universidades universidades que eu fiz doutorado que a carne de Melon tinha

um laboratório muito grande né a IBM também tinha um laboratório muito grande a empresa é que foi a empresa que o laboratório que deu origem a essa revolução que eu vou falar que é o seguinte o pessoal percebeu que vez de colocar regras sintáticas para fazer traduções entendimento do texto em vez de usar puramente linguística era melhor você pegar um monte de frases e calcular a probabilidade da próxima palavra dado o que foi falado antes para você entender como que a linguagem funciona tá então eu vou dar um exemplo bastante simples Se você pegar se

você chegar no seu e-mail lá e se abre tem um e-mail da pró-reitoria de pesquisa tá escrito assim segue anexo ofício para Qual é a próxima palavra né bom ou é providências ou é conhecimento ou é Ciência não vai ser pizza certo não vai ser então se você quiser entender se você quiser prever qual vai ser a próxima palavra você olhando os documentos emitidos já você vai conseguir saber a probabilidade para essa palavra e chutar entre aspas muito bem né Então é isso que se faz nos chamados modelos de linguagem eu tô fazendo a questão

de falar esse termo porque o GPT é um modelo de linguagem é isso que ele é né Ele é um modelo é um aparato é uma função matemática vamos dizer assim quem quiser sofisticar mas é um programa que calcula a probabilidade da próxima palavra dado o que foi emitido antes né no caso do chat PT ele leva em conta três até três mil palavras que foram faladas anteriormente né então se eu falar para você assim qual é a probabilidade da palavra providências dado que você leu o ofício para não pode ser acho que é alta

essa possibilidade então se você quiser prever ou emitir uma palavra dado que foi falado você pode usar as probabilidades nessa maneira nessas propriedades das palavras da próxima palavra das palavras anteriores essas propriedades formam o que se chama o modelo de linguagem né então como é que você monta o modelo de linguagem você coleta milhões bilhões de textos certo o chat PT é baseado em pelo que a gente lê né pelos dados da própria empresa em 500 bilhões de palavras né então e você estima a probabilidade essas é esses conjuntos de palavras são chamados corpora se

constrói um corpos que é um conjunto de palavras e você estima a probabilidade da próxima palavra da das palavras que foram emitidas isso é um modelo de linguagem é muito comum hoje uma palavra que tá na moda a gente vê até no jornal essa palavra que você tem modelos de linguagem generativos que acho que nenhuma palavra em português muito certo mas que que é o modelo gera texto né então se eu escrevo no modelo Assim Segue anexo Segue anexo ofício para e pergunta qual é a próxima palavra Qual é a palavra que tem maior probabilidade

providências Aí eu pergunto bom Segue anexo ofício para providências qual a próxima palavra cabíveis certo e você vai falando as palavras assim sem nem saber o que se trata certo e é impressionante o quão bem você consegue fazer isso existem testes muito interessantes só uma outra piada né que pegam as obras de Shakespeare e monta o modelo de linguagem e pedem para o modelo falar frases de Shakespeare É impressionante como parece Shakespeare embora não tenha nada a ver com nada né Então essa capacidade de gerar coisas a partir de dados é impressionante né existe um

artigo que eu recomendaria muito para quem tiver interessado nessa nessa discussão toda de 2009 eu acho que é muito interessante entender o momento não é de 2019 onde os autores que são três autores três pessoas que trabalhavam lá no trabalho trabalhavam na Google colocam isso né Eu acho que o próprio título do artigo já diz tudo que é bom Inteligente você pode parecer é quase rizz na bom se você só pega padrões e vai reproduzir depois de 2019 nós tivemos várias revoluções na área de processamento de linguagem natural tem a revolução da aprendizado profundo que

eu vou falar rapidamente A Revolução dos inbedios que ninguém traduz mas a palavra difícil traduzir dos Transformers que é uma outra palavra também que pouco traduzida mas transformadores né então eu vou falar rapidamente desses desses dessas expressões aí procurar Dá a ideia básica por trás de cada uma delas sem matemática sem muita discussão técnica né Eu acho que cada uma delas é um passo para chegar no GPT e para chegar no 7º CPT que é onde eu queria que ia chegar aqui dá uma visão geral para vocês então primeiro o primeiro passo interessante assim primeira

revolução que eu queria falar sobre a qual queria falar depois desses modelos de linguagens estabelecido já a partir da década de 90 aconteceu Por volta de 2003 a 2013 é que é a Revolução dos imbejens né então o que que é um impede o imagine essa palavra é uma palavra que os matemáticos vão reconhecer tem outro sentido em matemática né o impedem é uma é uma função é um é uma relação que para cada palavra te coloca números então transforma as palavras em números de maneira intuitivamente que você possa agrupar as palavras por distâncias Então

tudo aquilo que nós temos como símbolos pode ser transformados em números e com isso você ganha a possibilidade de agrupar as coisas e determinar similaridades né eu coloquei aqui uma figura de um livro muito muito fundamental na área que é o livro dos jurados que Martin que está disponível na internet inclusive quem quiser quem tiver interesse essa figura você vê o seguinte eles pegaram um monte de palavras de um monte contextos e fizeram Esse mini Bad que eu não vou explicar muito como que se faz mas eles chegaram em números para as palavras e eles

colocaram nesse nessa figura aí a cada palavra a sua posição Onde estão os números que a representam o que é interessante que eu queria chamar atenção é o seguinte as palavras que falam coisas boas tão perto estão em verde as palavras que falam coisas ruins então perto entre elas então em vermelho esse particular exemplo ele funciona para o seguinte vamos supor que você queira interpretar Você tem uma empresa você quer interpretar seus clientes estão falando bem da sua empresa olhando as revisões na internet então por exemplo se você sabe se você tem uma regra e

se a pessoa escreveu o Wonderful é bom o sistema vai saber que escreve porque se ela escreveu também é bom se ela escreveu Bad não é bom porque porque as coisas estão perto ou longe nessa escala numérica tá então o que que você conseguiu fazer com essas ideias você conseguiu transformar a necessidade de construir um dicionário Olha tá a palavra é boa a palavra é ruim a palavra era a questão numérica essas palavras estão perto então o entendimento que era possível transformar símbolos em números foi fundamental né e levou a toda uma série de revoluções

que é o conjunto de revoluções que levou a esse tipo de modelo chamado Transformer o GPT é um Transformer então ele é um modelo de linguagem Como já expliquei é um programa que te dá a probabilidade da sua próxima palavra dado o que foi falado dado foi livre é isso que ele faz agora Existem várias maneiras de fazer esse cálculo de probabilidade uma delas é usando Transformers tá então eu queria gastar aí alguns minutos né Espero ser relativamente Claro aqui para explicar o que que é um Transformer pelo menos um nível bastante abstrato né vocês

possam entender o que tá acontecendo lá dentro daquele daquela caixa preta então Transformer primeira coisa é que transforma todo transforma é uma rede neural né O que que é uma rede neural bom vamos me desculpar os os médicos que entendem de cérebro e tal isso não tem nada a ver com a rede neuronal realçar é uma mera tentativa de reproduzir o que se acha que pode ser o caso de ser parecido com o cérebro humano tá então todas essas esses serões aqui é o seguinte você tem um modelo né uma representação onde você tem entradas

as entradas você pode imaginar Com palavras você tem saídas as saídas podem ser as próximas palavras por exemplo né Essas palavras de entrada transformadas em números da forma como a gente já viu agora elas vão ser esses números vão ser somados subtraídos multiplicados Então você vai pegar todas essas palavras que estão aí em azul e vai somar multiplicar subtrair vai chegar numa outra num outro valor que tá em verde escuro você vai fazer essas operações várias vezes e todas essas essas operações intermediárias são chamadas operações que te levam a camada oculta tá lá no meio

você vê as entradas você vê as saídas Mas tem uma série de operações intermediárias que são a camada oculta da rede neural depois os números que estão nessa camada oculta estão de novo multiplicado subtraído somados e você chega na saída a mensagem que eu queria passar aqui para vocês é o seguinte você tem muitas entradas muitas saídas você tem muitas em muitas ridem coisas ocultas ali que são resultados de operações muito simples são só uma subtrações e tal mas como são muitas células muitos neurônios escondidos o resultado completo é uma função muito sofisticada pode ser

uma função para quem conhece essa linguagem uma função altamente não linear que mapeia as entradas para saídas tá se você não se preocupa com funções na unidade pensa assim é uma função muito complexa é passa das entradas para saídas então o que que a gente faz o que que se faz você tem essas funções que dependem de vários números esses números são estimados são apreendidos são treinados Mas você treina você extrai esses números de dados Então você aprende a rede neural o que que é uma regeneral profunda tá então acho que essa é um dos

principais mensais o que que é profunda essa rede que eu desenhei aqui ela tem uma camada oculta ela tem uma camada entre a entrada e saída Essa não é uma rede profunda certo uma rede profunda é uma rede onde você tem as entradas sem processadas passadas por uma camada oculta essa camada oculta é processada passa para outra camada oculta E vai assim por muitas camadas né uma rede neural profunda muito famosa que foi a rede chamada Alex net que era uma rede de 2012 identificava rostos com muita coisa identificava rostos com capacidade quase melhor do

que o ser humano ela tinha ela tem né oito camadas oito camadas né Essa daqui tem uma mas essa daqui é uma rede que eu desenhei deve ter 20 30 números que especificam essa rede a rede Alex net tinha 60 milhões de números que são envolvidos nessas operações né então é uma função entre a entrada e saída muito complexa né que pode ser representada por uma rede dessa a segunda ideia que realmente foi revolucionária aí na construção desses Transformers é que quando você vai usar passar de palavras palavras para alguma outra coisa né no caso

dos Transformers de palavras para palavras né porque lembre-se o que que nós estamos tentando fazer estamos tentando pegar um monte de palavras e falar uma próxima palavra certo então a nossa entrada é um monte de palavras a nossa saída é a próxima palavra certo então uma ideia importante nesse nesse mundo aí dos Transformers e tal das redes neurais é o que se chama os esquemas de atenção tá esse é um nome técnico A ideia é muito simples é muito simples então deixa ver se eu consigo passar com toda a simplicidade que ela merece A ideia

é o seguinte imagina que você tem como entrada um monte de palavras Então segue anexo ofício né então você associa a cada palavra a sua posição na frase Então segue a primeira anexo a segunda você também coloca nas palavras números Olha a palavra segue a quarta palavra a palavra anexo são palavras que estão no seu dicionário de palavras Então você associa a cada palavra dois números o seu o seu representante numérico e a sua posição e você vai construir para cada palavra o seu valor numérico que é o impedem que eu falei anteriormente usei a

palavra Bad é o valor numérico associado essa palavra mas notem que agora e esse é o principal hein notem que a palavra segue ela não vai ter um valor numérico toda vez que ela aparecer ela vai ter um valor numérico quando ela aparece seguida de anexo para e a palavra Ofício não vai ter um valor numérico sempre ela vai ter um valor numérico quando ela aparece precedida de Segue anexo ou seja é um valor numérico que captura com o conceito da palavra e o seu contexto né então Tecnicamente se fala que é um ideia de

contextual né e leva em conta a palavra seu significado e o que está em volta porque obviamente se eu escrevo Ofício se eu escrevo por exemplo marcar com um contexto de biológico é um animal você escreve macaco no contexto automobilístico é o é o equipamento né então o contexto Onde tá a palavra é importante para você saber qual o valor numérico que ela tem que ter naquele momento tá E é isso que os transformas fazem Então você pega as palavras associa as palavras eu tô simplificando muito certo mas eu não quero muito detalhe você pega

as palavras você pega suas posições você pega o seu posição no dicionário e você vai criar um valor para uma palavra que é o impedem da um valor para cada uma das outras palavras e esses valores dependem de formas diferentes das palavras pendulado é óbvio né É óbvio porque se eu quero saber o que que uma palavra significa Nem todas as palavras que estão em voltas são importantes algumas são mais importantes que outras né Então tudo isso é o que se procura capturar com esses Transformers tá o primeiro transforma que fez incrível sucesso assim que

foi revolucionário foi um Transformer ou seja uma rede neuronal neural que tem todos esses números envolvidos para especificar a relação entre saída então foi um transforma é produzido pela Google tá produzido pela Google que tinha diferentes versões 110 a 340 milhões de números envolvidos na especificação então vocês terem ideia do tamanho dessas coisas são milhões de parâmetros que estão envolvidos ele foi treinado numa quantidade gigantesca de palavras mais de três bilhões de palavras foram usadas ele fez muito sucesso Deixa eu te perguntar tem mais tempo Então eu queria usar um outro tempo aqui para falar

desses Transformers porque são realmente importantes para entender o que que faz o GPT né então existe o Bert que eu acabei de falar existem outros Transformers famosos também que são os Transformers generativos tá de novo uma palavra aí que existem mas é muito usadas a palavra é muito usadas dessa maneira Esses transformas generativos são os Transformers que são modelos de linguagem ou seja eles que que eles fazem Eles produzem a probabilidade da próxima palavra dado o que foi falado antes é isso que eles fazem não existe um Transformer famoso também da Google que é o

T5 é uma família de Transformers esses transformas São enormes eles têm 11 bilhões de parâmetro veja essas coisas são tão grandes que é difícil É como se eu falasse né você ganhar um real ou 11 bilhões de reais sabe mais ou menos o que que é 11 milhões no seu bolso então isso daqui é gigantes são 11 milhões e números que são usados para especificar a relação entre a entrada e saída outro conjunto de Transformers generativos famosos e obviamente famoso nós estamos aqui falando eles são gpts né o gp GPT significa generative né o t

é de Transformers e o g é degenerativo certo então eu queria pelo menos que essas duas palavras se soubessem ao fim dessa dessa conversa aqui porque são as palavras estão no título do chat ept tem vários gpts o 1 ou 2 e o 3 eram modelos generativos básicos vamos dizer assim eles tinham problemas sérios de responder coisas erradas falar coisas que não tem a ver ser agressivos falar coisas impróprias coisas de caráter sexual discriminatória havia de toda sorte de problemas então houve uma mudança muito grande entre o GPT 3 e 4 o quatro no meio

dos dois houve um GPT que é o GPT que foi treinado para responder instruções e esse repertência ele tem habilidade tem mais habilidade de evitar alucinações erros O que é incrível sobre esse gpts é o tamanho né onde eles foram levando a coisa né então já o gpt3 tem 175 bilhões de parâmetros né Realmente gigantesco o gpt4 nós nem sabemos porque no próprio site da empresa né Open Ai que lançou eles deixam Claro que não vão divulgar o tamanho a gente não sabe quanto que é tem outros então tem um que chama Lhama tem outros

eu vou pular umas coisas aqui que eu tinha eu só eu queria mostrar eu vou pular uma aplicação muito interessante essas coisas mas acho que não vai dar tempo eu queria só mostrar um exemplo de uma aplicação desses modelos que não é o chat PT tá para vocês entenderem que não é só o chat de PT que tá espantando a comunidade acadêmica realmente tem muitas outras coisas acontecendo eu vou dar um exemplo de um de um de um projeto que que tem a ver com coisas que estão acontecendo no nosso centro de interseção é um

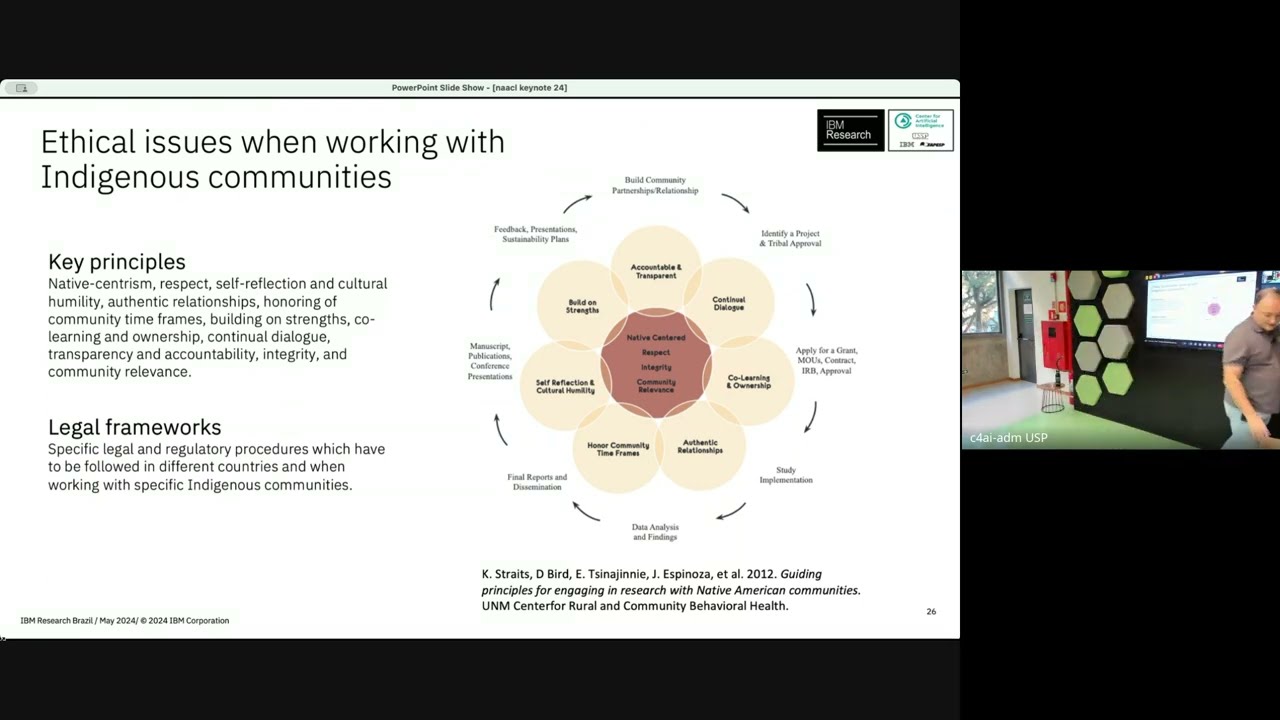

projeto que foi conduzido pelo pelo vice-diretor de sempre que é o Cláudio Pinhais que é uma pessoa da IBM né Nós temos esse centro em parceria com IBM e vou falar um trabalho que começou lá na IBM Agora nós estamos Lounge está expandindo com o nosso centro aqui é um trabalho que é o seguinte é um trabalho de tradução de línguas indígenas brasileiras né o problema de você fazer tradutores línguas indígena que existem poucas palavras você não tem milhões de frases em Guarani você tem alguns milhares traduzidos Então qual foi a ideia deles Vejam Só

eu queria dizer qual o ponto que eu acho importante eles pegaram um tradutor um Transformer de inglês para alemão que foi criado com 500 milhões de pares de frases alemão em inglês se pegar esse transformam e pegaram esse Transformer que é inglês alemão certo aparentemente não tem nada a ver com Guarani e Tupi e refinaram fizeram um treinamento adicional com 45 mil pares de frases de entupir outras línguas indígenas e com isso criaram um tradutor aceitável de Tupi de Guarani para outras línguas indígenas é incrível certo é incrível que você consiga é com tantos dados

e com relativamente poucos dados de uma linguagem mas muito de outra combinar tudo e gerar uma tradução de línguas que não foram vistas Pelo modelo original então tem muita coisa espantosa sobre esses modelos não é só os sete PT certo que tá trazendo certo bom o que então vamos ao chat e o que que é o chat de PT é um sistema criado pela empresa né era uma era uma era uma instituição não não lucrativa mas agora é uma empresa chamada é uma empresa que foi criada em 2015 e tem feito muito barulho aí com

muitas outras propostas e outras técnicas que eles têm lançado e eles lançaram no ano passado já tinha PT né é um sistema de conversa é um Agente conversacional né você escreve uma coisa ele responde você escreve outro me responde que usa o gpt3.5 que é o basicamente o GPT instruts que eu acabei de mencionar Então como o próprio nome diz é um chat Você escreve coisas recebe coisas é um chat baseado no generative eu espero que tenha dado para entender de forma bastante abstrata o que que é o transforma o que que é generativo né

significa apenas que ele vê um monte de palavras e falar a próxima agora se você perguntar para ele eu acho que todo mundo aqui já deve ter tido já ouviu falar do chat GPT ou já teve experiência de interagir com ele você perguntar o que ele é ele responde em português muito bom ele escreve muito bem é muito correto as frases são muito corretas as coisas são surpreendentemente bem articuladas né então ele explica exatamente o que que ele é é como que ele foi construído né ele foi construído usando uma quantidade gigantesca de textos é

um corpos o mesmo corpos que foi usado para gerar o strex GTT Então são 500 bilhões de palavras que foram usados segundo as publicações que a gente tem acesso e depois que foi gerado o modelo eles fizeram todo um refinamento que eu não vou explicar aqui mas só coloquei as palavras lá um refinamento com seres humanos que interagiram com o chat e falaram olha essa resposta tá boa essa resposta tá boa essa é melhor que essa eles fizeram todo um processo de refinamento que ele melhorou um strept GPT né que eram um chat que ainda

falava muitos absurdos e transformou naquilo que a gente vê hoje no chat PT que é um chat eu acho que vocês concordam bastante dócil né ele responde ele fala que nossa eu posso eu sou apenas uma máquina ele tem toda essa característica essa essa personalidade como de cinco colega meu meio submissa né ele sempre te dá uma resposta e com um bom português bom uma boa linguagem e tal isso foi obtido com refinamento feito por pessoas né Por chamamos de rotuladores pessoas que foram lá e avaliaram e essas informações foram usadas para melhorar o extrato

de PT como eu já disse o que é incrível nesses modelos nesse modelo em particular é que ele usa muitas palavras para falar a próxima né ele usa três mil palavras então é muita coisa O sistema tem um processamento prévio né E tem moderação Então nem tudo que ele responde aparece para para o usuário ele tem o chat ept tem um sistema próprio de detecção de respostas tóxicas discriminatórias em próprias completamente errado então ele tem um sistema Inclusive a empresa tem artigos sobre isso estão disponíveis na internet e é aquela coisa né esses modelos todos

erram mas o chat PT erra menos que o GPT Então é só um exemplo engraçado se você perguntar um exemplo tá no próprio artigo do chat BT se perguntar me diz me diz alguma coisa sobre quando Colombo chegou no Estados Unidos o estresse GPT era aquela coisa né não Colombo chegou nos Estados Unidos 2015 ele tava muito animado de estar lá então ele sempre Queria visitar Ou seja é um absurdo né É isso que nós chamamos na comunidade de alucinações são erros que não são simplesmente erros factuais são criações completamente fora da realidade né então

o que que nós temos hoje eu já vou terminando aqui nesse sistemas em particular no chat de PT mas todos os temas baseados nesses modelos generativos tá eles têm grande capacidade de responder perguntas eu diria assim surpreendente capacidade é incrível eles conseguem propor soluções para problemas organizar viagens organizar código promotor código eles são excelentes vamos dizer assim né eles estão sendo usados tem vários colegas na indústria que já me falaram que o programadores estão usando com aumento de produtividade nesses sistemas Aparentemente a Microsoft vai incorporar em programas como Word Excel assistentes que usam esse sistemas

então eles têm eles têm qualidades acertos aí mas eles têm alguns problemas que vem da própria forma como eles são criados né como eles são criados apenas para propor a próxima palavra dado um monte de palavras eles têm a questão de gerar coisas totalmente absurdas que são as alucinações Mas além disso eles respondem coisas incorretas impróprias também às vezes existe um problema sério que é o possível plágio você não sabe de onde veio aquilo que tá aparecendo né você não tem como citar você pode estar citando alguma coisa que que tem propriedade intelectual associada se

você escreve eu não sei se você já fizeram essa brincadeira se você escreve fale sobre alguém né é muito comum vir algo completamente absurdo então eu fiz essa experiência comigo né então eu perguntei quem é Fale sobre muitas outras coisas tal mas engraçado por exemplo eu sou do departamento PCs da escola eu não sou do PCs sou de outro departamento eu qualificaria isso como um erro porque tudo bem eu sou da escola no departamento não sou do outro mas Além disso eu sou fundador do lado de fora da Usp eu não sou fundador e Até

onde eu sei não existe o Love for então essa é o que eu chamaria não é um erro É uma Alucinação certo é uma coisa completamente absurda e você não sabe de onde tirou existe um lava e fora na Fiocruz mas eu não fundei certo não fui eu e eu não sei de onde veio então a gente não fica sabendo como que essa palavra apareceu de onde ela foi o que trouxe ela na no conto de probabilidades que o modelo de linguagem está fazendo tá eu acho que eu vou pular isso daqui e vou falar

só o seguinte que em vista dessas sim do potencial dessa tecnologia de ajudar como assistente mas em vista dos possíveis problemas em razão de erros alucinações plágio falta de controle existem diretrizes sendo colocadas no mundo inteiro tem várias diretrizes sem discutidas algumas são óbvias por exemplo já se decidiu que não dá para ser pode ser com o autor Porque o autor tem que ser responsável pelo que tá escrito existem diretrizes de associações né Por exemplo ACL que é associação de linguística computacional em cada caso que você usa cada uma das possibilidades uma coisa ter assistência

gramatical outra coisa que busca qualquer coisa de geladeira eu queria encerrar falando um pouco assim como é que o Brasil tá nessa nessa corrida né uma verdadeira corrida espacial que a gente está vivendo hoje cada empresa pública um modelo de linguagem o meu é maior que o seu o seu é maior que o outro então eu acho que o Brasil tem uma posição relativamente boa na área de interrogação falar dois minutos mais novo tá bom se você olhar dados da Fapesp você vê que o Brasil aparece em 2014/2018 em 12º lugar na produção de artigos

científicos o Brasil tem uma uma comunidade acadêmica e há bastante grande bastante forte assim há muitos anos se você olhar os dados do CDL tem um conjunto de dados muito interessante mais recente e você pode inclusive passar o slider e ver a evolução né então o Brasil aparece ali não sei se dá enxergar tem obrar em laranja mais escuro né você tem dos campeões hoje a Estados Unidos da China a Índia um pouco atrás depois de uma série de países mais europeus Canadá o Brasil aparece logo atrás até se você passar o slider você vai

ver que até Poucos Anos Atrás o Brasil tava na frente da Holanda da Turquia e da Rússia e esses pais estão passando na frente eu acho que talvez em vista dos últimos anos de pouco investimento em pesquisa mas eu acho que é necessário alguma alguma reação do Brasil para acompanhar um pouco a evolução não ficar no pelotão mais para trás Existem muitos dados sobre o uso de ia no Brasil acho que por exemplo a embrap tem se olhar os dados da entrevista você vê que o azul escuro ali que é a maior área de investimento

da embrapinha no Brasil é e a 2021 a USP em particular falando agora eu sei que que nós estamos aqui na USP mas existem muitas colaborações e tal como colegas né mas vou falar um pouquinho da USP tem uma posição relativamente privilegiada né os que tem um conjunto de pesquisadores bastante grande várias unidades Há muitas décadas né então se você olhar os dados da Fapesp também você vê que a USP tem aí uma quantidade de publicações anual bastante significativa né temos outras instituições importantes né a UFMG por exemplo daí tem uma posição destaque também a

Unicamp certamente mas eu acho que a USP tem tido uma liderança que é importante manter é importante manter isso e servir de ponto de referência internacional né nesse contexto aí brasileiro Nesse contexto de posição do Brasil relativamente boa mas nessa competição toda eu acho que o Brasil tem vários desafios especificamente do que diz respeito a realidade que o chat PT traz né Um dos problemas é que o as línguas brasileiras são línguas debaixo até o português é uma língua de base recursos que tem Existem poucos conjuntos de dados poucas ferramentas lá no nosso centro nós

temos um esforço bastante grande desenvolvimento de ferramentas para língua portuguesa mas eu acho que mesmo assim falta falta material para o português e as línguas brasileiras serem reconhecidas com a importância que tem outro problema é que a infraestrutura necessária para rodar esses modelos é muito grande né Isso mudou muito nos últimos anos Até onde eu sei o GPT três precisa de um computador de 80 gpus para rodar o dado mais se dedigno que eu tenho bom né talvez vocês não imaginam o que é isso mas o nosso cluster o nosso cérebro custa mais de milhões

de Deus né então 80 GPS Até onde eu sei que não tem nenhum computador que consiga rodar o gpt3 eu acredito que as universidades brasileiras também não tem Até onde eu sei a Petrobras tem um computador que tem muita gpus possa rodar pode rodar mas falta mesmo como rodar esses modelos e eu acho que as instituições brasileiras simplesmente não estão preparados para corrida espacial que se virou né então acho que é um ponto de atenção é importante para o Brasil que esses modelos que no fim estão controlando a língua né sejam de fato dominados e

entendidos pela comunidade do país Então queria só concluir agradecer mais uma vez o convite a oportunidade e resumir o seguinte que o sucesso atual dessas tecnologias é resultado de um longo processo eu espero que as principais palavras tenha ficado relativamente Claras o chat PT realmente é surpreendente ele funciona muito bem como assistente apesar dos problemas tem vários problemas e controlados né eu acho que é muito boa iniciativa de procurar legislar mas é preciso fazer contato com cuidado né e refletir sobre os próximos passos em termos de investimento e de capacidade de estar presente nessa discussão

internacional com a nossa língua e não simplesmente usar aquilo que está sendo gerado a partir de dados que a gente nem sabe de onde vem tá certo então muito obrigado e com a disposição aí não sei se você tem mas muito obrigado pela oportunidade