Olá! Neste vídeo, eu apresento algumas das facilidades que o Moodle disponibiliza para acompanhar os resultados de um questionário, em termos de desempenho individual e coletivo dos estudantes. Podemos de maneira rápida e segura dispor de dados para análise e melhoria da qualidade dos questionários que vamos elaborando.

No bloco administração, clicar em Administração do curso, Configuração do livro de notas e Relatório de notas. Esta página, mostra como as atividades foram organizadas e os vários filtros para análise de desempenho, a partir da correção dos questionários. Em "Relatório de notas" vemos os resultados de todas as atividades realizadas.

Temos dois questionários corrigidos. Podemos fazer uma busca por estudante, pela primeira letra do nome e/ou sobrenome. Abaixo, à esquerda, temos a relação de todos os alunos e podemos, também, ordená-los pelo nome ou sobrenome.

Ao lado de cada nome, aparecem as notas dos questionários realizados. Pode-se ter uma visão global expandida, basta clicar no sinal ao lado do curso. Veremos a média final de cada aluno e a média geral.

Para uma análise coletiva dos resultados, pode-se clicar em qualquer um dos questionários realizados. Por exemplo, clicando no "Questionário 1", entramos no bloco de ADMINISTRAÇÃO do QUESTIONÁRIO. Dentro desse bloco aparece o link "Resultados".

Os resultados estão detalhados em: Notas, Respostas, Estatísticas e Avaliação manual. Em "Notas", já aberto, vê-se o desempenho de cada aluno, o tempo utilizado para fazer o questionário, a avaliação final, as perguntas que respondeu, acertos e erros. Se clicarmos sobre a nota da questão, veremos a pergunta respondida.

Na nota da avaliação, enxergamos todo o questionário preenchido pelo aluno. Temos a possibilidade de fazer o download desses dados e analisá-los fora do Moodle, em uma planilha Excel, por exemplo. Abaixo da tabela, temos os resultados médios, total e por questão.

A seguir, um gráfico de barras mostrando o desempenho dos alunos do questionário por faixa de nota, em que se pode analisar a distribuição de acertos. Neste questionário, 25 estudantes dos 190 acertaram todas as perguntas. Em "Respostas" a estrutura semelhante à do bloco anterior.

Agora vemos todas as respostas assinaladas por estudante. Ao clicar na resposta de um determinado estudante, abre-se a pergunta e o seu histórico de respostas. Em "Estatísticas", temos acesso a muitos resultados agrupados.

Os dois primeiros campos indicam como queremos ver as estatísticas, se por todas as tentativas, a primeira, à última ou a de nota mais alta. Nós manteremos o padrão, pois o questionário 1 foi realizado em uma tentativa de resposta. As notas foram pré-definidas para o intervalo entre 0 e 100%.

"Salvar as preferências" Em "Informação do questionário" as seis primeiras linhas trazem dados de identificação e duração do questionário. Depois, mostra-se a quantidade de estudantes que fez a tentativa de resposta. A seguir, começam a aparecer as análises estatísticas.

Primeiro, as notas médias dos estudantes por tentativa, no caso 76,42% para todas, pois só houve uma tentativa por aluno. A nota mediana, que separa os respondentes em dois grupos iguais é 80%. O desvio padrão que evidencia a dispersão em torno da média, da ideia se os resultados estão muito dispersos ou próximos à média.

Os valores aceitáveis são entre 12 e 18%, menor que isso, temos notas muito amontoadas, próximas umas das outras. Acima disso, valores dispersos, mais distantes entre si. O nosso exemplo o valor foi de 16,99%.

Depois vêm as medidas de assimetria curtose. O valor negativo da assimetria, indica que a distribuição de notas aponta para à esquerda, o que pode ser confirmado pelo gráfico mostrado na página notas. Outra característica associada é que a média 76,42% é menor do que a mediana, 80%.

Um valor de assimetria muito negativo, indica falta de discriminação entre as notas dos alunos que acabam tendo resultado acima da média. Neste exercício, metade dos respondentes acertou mais de 80% das perguntas, percentual acima dos 76,42% médios. O valor negativo da curtose indica que a distribuição das notas apresenta uma curva de frequências mais aberta do que a da distribuição normal associada aos dados.

Um coeficiente de consistência interna acima de 75% é considerado satisfatório. Se o valor for inferior a 64%, há indicativos de que algumas questões não são muito boas para discriminar alunos de habilidades distintas e, por consequência, as diferenças entre as pontuações estão, em grande parte, associadas ao acaso, ou seja, o questionário não é homogêneo. O nosso exemplo, a consistência interna é baixa de 43,40%.

Medidas corretivas devem ser consideradas no sentido de compor os próximos questionários, e evitar a baixa consistência interna. A taxa de erro está associada ao coeficiente de consistência interna. Menor a consistência interna, maior a taxa de erro.

Na prática, aponta o percentual do desvio padrão, que se deve a efeitos aleatórios e não há diferença nas respostas por conhecimento. Neste exemplo, constata-se 75,24% de taxa de erro. Valores superiores a 50% não são considerados satisfatórios.

O erro padrão é o valor do desvio padrão multiplicado pela taxa de erro dividido por 100. Na prática, aponta quanto de desvio padrão é consequência de aleatoriedade nas respostas. Quando o erro padrão exceder 8%, diz-se que uma proporção considerável dos estudantes não têm suas habilidades avaliadas adequadamente, isso é o que está mostrando o erro padrão do nosso exemplo de 12,78%.

Em "Análise da estrutura do questionário", uma série de estatísticas acerca da organização do questionário são apresentadas em formato de tabela. As linhas, são as perguntas disponibilizadas para todos os respondentes agrupadas por categorias. Cada um destes questionários exemplo, apresentou aos alunos 10 perguntas de "Múltipla escolha", com uma alternativa correta, escolhidas aleatoriamente dentro de 10 categorias, respondidas em uma tentativa.

Aqui se vêem as 10 categorias, os números inteiros e todas as questões associadas, os decimais. Se clicarmos em cima de qualquer pergunta, veremos a frequência de respostas por alternativa. Nesta primeira pergunta, dos 42 respondentes 32 a responderam corretamente, 76,19% e se pode ver como foi a indicação das outras alternativas.

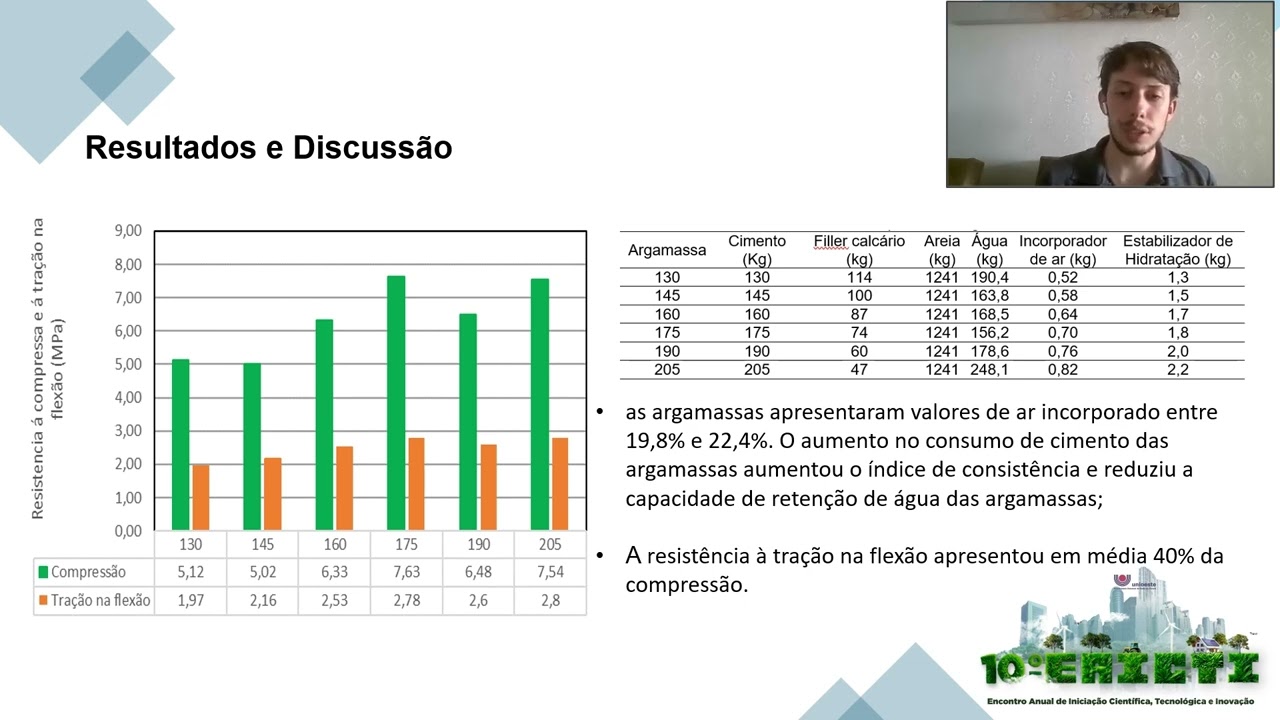

Continuando na tabela ao lado da categoria ou da pergunta, vemos as quantidades de "Tentativas" de respostas, no caso total de estudantes, 190 já que houve só uma tentativa. O "Índice de facilidade", mostra o percentual dos alunos que responderam corretamente à questão. Abaixo de 34% caracteriza uma questão difícil.

Acima de 66% considera-se fácil. Entre 34 e 66% como uma questão média. O desvio padrão mostra dispersão em torno do resultado médio, evidenciando a potencialidade de quanto uma questão pode discriminar.

No exemplo, percebe-se que o desvio padrão das questões é majoritariamente superior a 30% com elevado grau de dispersão nas respostas. A "Pontuação aleatória estimada", mostra o percentual de acerto aleatório de cada pergunta. No exemplo, o questionário tem somente questões de "Múltipla escolha" com 5 alternativas e uma correta, ou seja, a pontuação aleatória de cada alternativa é igual a 20%.

O "Peso planejado" é o peso da questão no total do questionário. No exemplo, cada uma das dez perguntas têm o mesmo peso de 10%. O "Peso efetivo", mostra o peso real das categorias no total de 100% relativamente à dispersão das respostas.

O "Peso planejado" e o "Peso efetivo" devem ser comparados. Peso efetivo maior do que o planejado, mostra que a questão tem maior participação na dispersão dos resultados do que se esperava. Quando peso efetivo for menor do que o peso desejado, a questão não tem tanto efeito sobre a dispersão dos resultados como se idealizou.

O "Índice discriminação" indica a eficácia da questão para distinguir estudantes com melhores resultados dos piores. Entre 30 e 50% há adequada discriminação. Acima de 50%, discriminação muito boa.

Abaixo de 30% à discriminação é considerada ruim. Fazendo os cálculos, 64% das questões deste questionário tem muito boa discriminação e discriminação adequada, 16% têm discriminação fraca e 20% discriminação muito fraca. A "Eficiência de discriminação" estima quão bom é o índice discriminação em relação à dificuldade da questão.

Uma pergunta que é muito fácil ou muito difícil não pode discriminar entre alunos de diferentes habilidades, porque a maioria deles obterá a mesma pontuação. Para a eficiência da discriminação, valores superiores a 50% devem ser alcançáveis. Valores inferiores de 50% indicam que a questão não é tão eficaz em discriminar estudantes de habilidades diferentes.

Calculando por pergunta, 47% delas são eficientes na discriminação. Abaixo da tabela temos um gráfico comparando o índice de facilidade e eficiência de discriminação para as 10 categorias de perguntas utilizadas. De maneira geral, constata-se que 9 das categorias são consideradas fáceis com dificuldade para discriminar as habilidades dos respondentes.

Em "Avaliação manual", aparecem as questões que precisam ser corrigidas manualmente. Nestes questionários, todas foram avaliados automaticamente. As funcionalidades vistas nos dão muitos subsídios, não só para que saibamos o resultado dos alunos, mas também, para que possamos avaliar a qualidade das questões que elaboramos.

A partir desse acompanhamento, podemos anular questões, excluí-las, melhorá-las para os próximos questionários, ou seja, a nossa dedicação pode se direcionar para a melhoria das avaliações. Assim, encerramos a apresentação do quinto e último ponto relacionado à criação e acompanhamento do resultado de um questionário. Espero, que as orientações e dicas possam ter te estimulado a criar um questionário no Moodle.

Muito obrigado!