c'est assez impressionnant de se retrouver dans des allées comme ça même si euh c'est pas encore totalement équipé enfin je vois réellement à quoi ressemble le Cloud [Musique] quoi parmi tout ce qu'on me demande de visiter les Data Center sont en bonne position c'est un peu là ou bas le cœur d'Internet hein c'est normal de vouloir savoir comment c'est fait d'après l'IOA l'Agence internationale de l'énergie le nombre d'utilisateurs Internet est passé de 3 à 5,3 milliards entre 2015 et 2022 sur la même période on estime que le volume de données échangé a augmenté de 600

% passant de 0,6 à 4,4 za octé un za c'est 1 milliard de Terra les mauvaises langues diront que c'est principalement du pron d'autres sont persuadés que pour réduire drastiquement ce volume il suffit d'effacer ses mails mais on s'en fout parce qu'en fait ce volume ne veut pas dire grand chose si on ne le met pas en perspective avec l'Impact matériel qu'il a parce que tout ça fonctionne grâce à des machines empilées dans des gros entrepôts les fameux dataacenter toujours entre 2015 et 2022 la charge de travail des DAT Center a augmenté de plus de

340 % mais sur la même période la croissance de l'augmentation électrique est estimée entre 20 et 70 % seulement on estime qu'en 2022 les Data Center ont consommé entre 240 et 340 TWh hors cryptomonnaie en effet ces chiffres ne prennent pas en compte la consommation des fermes de calcul pour pour les cryptonnaaies qui est estimé à environ 150 TWh je m'abstiendrai de tout commentaire ce qu'on peut déduire de tous ces chiffres c'est que la puissance de calcul et la capacité de stockage augmente fortement mais la consommation énergétique évolue moins vite mais il ne faut pas

oublier la mutualisation avec le développement du cloud aujourd'hui on a plus tendance à louer un bout de machine plutôt que d'avoir une machine sur soi qui sera sous-utilisée bref je vais pas m'étaler là-dessus j'ai abordé l'impact écologique d'Internet et du matériel informatique dans ma vidéo sur le sujet mais commence à dater un peu parce qu'il y a certains chiffres qui sont maintenant obsolètes hein ça évolue très très vite en revanche je sais qu'une vidéo est prévue par le réveilleur et la biologie fait des vidéos qui reprendra des sources plus récentes elle n'est pas encore disponible

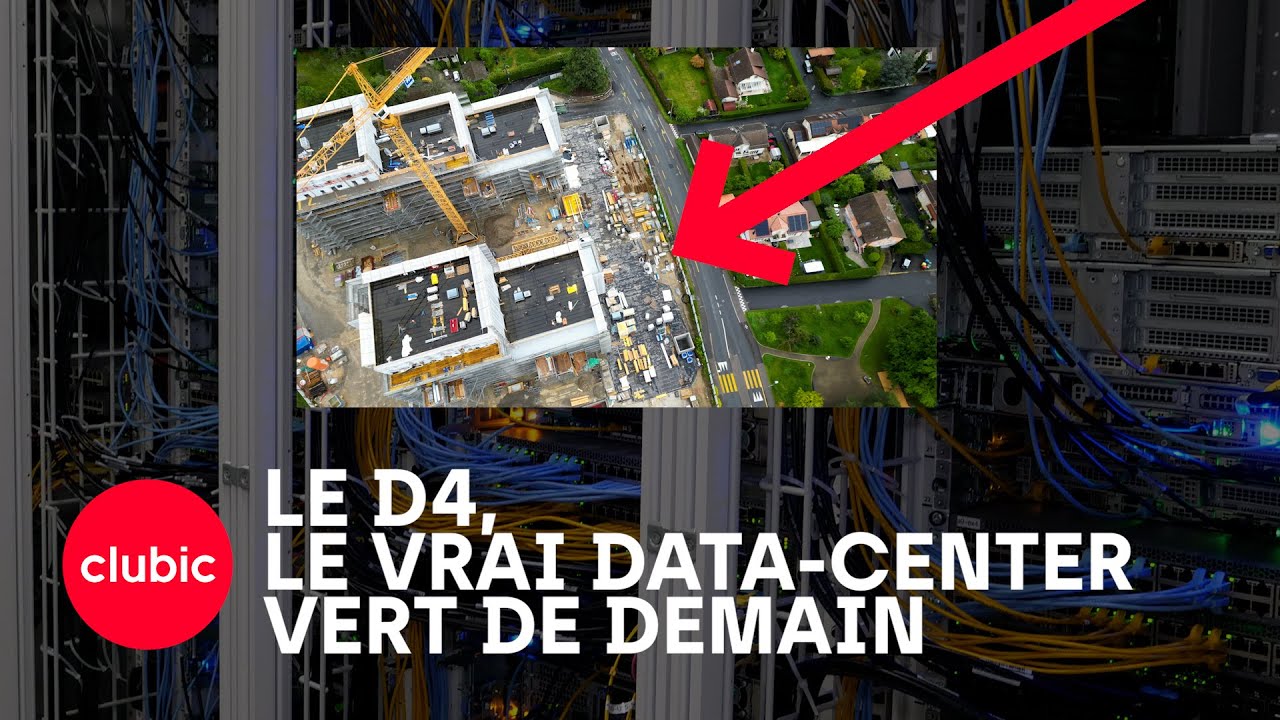

mais je mettrai le lien quand elle sortira à noter aussi le développement des intelligences artificielles qui demande de très grosses puissan de calcul et ça va peut-être modifier à la hausse la consommation des Data Center nous dans cette vidéo on va voir comment ça marche concrètement dans un centre de données d'un point de vue énergétique on va aller visiter les Data Center D4 et D3 de infomaniaque infomaniaque propose des services pour les particuliers ou les professionnels hébergement outils collaboratifs Cloud Computing et cetera l'entreprise est basée en Suisse et ces data center aussi en plus d'avoir

une empreunte carbone très basse ils développent leurs propres outils gèent leurs propres data center utiliseent le maximum de matériel fabriqué en Europe et embauche des gens de la région en plus il testent des trucs assez intéressants comme on va le voir plus tard on va commencer par visiter D4 qui est en construction et ensuite on ira voir le DAT Center D3 qui lui est en service depuis une dizaine d'années bref assez d'introduction on y va ah oui juste attendez un petit avertissement avant qu'on commence on va reprendre les bases pour que tout le monde soit

au même niveau et si vous êtes du métier bah je compte sur vous pour apporter des nuances et des précisions dans les commentaires un centre de données consiste à connectter et à faire fonctionner du matériel informatique dans des conditions optimales ça peut être de la puissance de calcul brut de l'hébergement du stockage de données du calcul pour entraîner des intelligence artificielle et cetera et cetera le matériel est généralement monté dans des boîtiers de ce type voilà ça c'est ce qu'on a app un serveur la largeur des boîtiers est fixe la hauteur varie en multiple d'une

unité appelée u ça c'est un serveur dans un boîtier 1 U les plus fins ça c'est du 4 U quatre fois plus épais ces serveurs sont montés dans des B qui font en général 47 u de hauteur voici plein de B vides qui attendent leur machine et moi ça ça me plaît j'adore les systèmes modulaires c'est mon truc vous le savez ce système de RAC en fait il est absolument génial si ça dépendait que de moi tous mes meubles seraient comme ça par exemple ma cuisine ça serait que des B avec un plan de travail

au-dessus et en plus c'est absolument génial parce que mettons ton four tu de mettre ton four dans ta salle de bain bah tu le mets dans ta salle de bain si tu as envie de mettre ta cuisine dans un data center bah tu peux servira à rien mais ça rentrerait non mais les systèmes modulaires c'est génial les bai sont organisés en couloir qu'on appelle des allées on détaillera comment fonctionnent les allées un peu plus tard alors ben je suis borisentaler ENF je suis le directeur stratégique d'infomaniaque dans les temps anciens j'étais le directeur je participe

à la la conception des des Data Center un data center fonctionnement est très simple c'est c'est alimenter des serveurs 24h/ 24 sans interruption et évacuer en fait les calories 24h/ 24 sans interruption un data center qui va consommer 1 MW de d'électricité va produire 1 MW de chaleur donc c'est tout autant critique de d'évacuer cette chaleur que de recevoir en fait ce mgaw d'électricité l'alimentation électrique d'un data center va de plusieurs centaines de kilow à plusieurs centaines de mgaw pour les plus gros le système de refroidissement doit être capable d'évacuer une puissance équivalente et bien

sûr il faut une grosse connexion en fibre optique avec le monde extérieur en plus de ça on va trouver une sécurité anti-incendie et une sécurité anti-intrusion réglé sur le mode paranoïac donc là par exemple ma ma face n'est pas enregistrée je peux pas rentrer dans le dans le local et comme l' dit Boris tout doit fonctionner 24 heur sur 24 7 jours sur 7 toute l'année et vous allez voir que ces contraintes impliquent pas mal de chos ici on est à D4 il est en travaux au moment du tournage et il est équipé d'un système

de refroidissement unique et l'emplacement du data center est aussi unique le data center est sous terre et donc au-dessus du data center il y a des immeubles qu'on verra d'ailleurs ils sont en construction en le data center va chauffer ses immeubles on va chauffer beaucoup plus que ces immeubles 5 % de la chaleur va va permettre de chauffer l'écoquartier et puis en gros on va chauffer 6000 logements l'équivalent de 6000 logements en en hiver et en été on va chauffer bien plus que 6000 logements parce que on a besoin de chaud de cœur pour le

chaud sanitaire ici on va remplacer en fait une centrale à pelais donc on va remplacer l'équivalent de de de un camion de de Pelet brûlé tous les de jours on va suivre le chemin de l'énergie dans le data center on a deux transformateurs de 1 MW on reçoit le courant 18000 V et transf ensuite nous rendent du 230 vol ici on reçoit donc les 230 V des transformateurs qui est renvoyer ensuite sur les onduleurs on voit qu'il a une deuxième arrivée électrique qui est en fait les les groupes de secours on a nos deux arrivées

électriques et ensuite on voit que le courant en fait va partir dans plusieurs onduleurs en fait on a deux onduleurs ou plutôt on a 12 onduleurs on a deux fois 6 onduleurs c'est des disjoncteurs qui doivent quelque part jamais se mettre en route qu'ils sont là vraiment en cas de de défaut en fait très important onduleur pour Ben sécuriser chaque fois en fait des étbles donc en général c'est des des disjoncteurs qui vont jamais se couper et si jamais on perd euh six onduleurs compère un corps parce que c'est doublé ces six onduleurs avec six

autres onduleurs et ben on a un corps le moyen de de courtcircuiter en fait toute cette partie ondulée pour aller en direct en fait sur le le tableau cette fois-ci des d'alimentation des serveurs on a commencé par l'arrivée électrique et là on change de pièce pour aller voir les onduleurs qu'on appelle aussi UPS pour un interruptible power supply donc là on va rentrer dans la zone onduleur qui est physiquement séparé en fait du reste pour aussi des raisons de sécurité parce que là il y a de la batterie làdedans chaque fois qu'il y a eu

dans l'histoire des Data Center des problèmes des incendies ça vient toujours en fait des batteries du local batterie du local onduleur historiquement les batteries les onduleurs é mis dans les dans le même endroit que les serveurs et depuis ben on essaie de cloisonner en fait ces deux éléments qui sont les plus sensibles au niveau de la source d'incendie sur un dat Center alors ici c'est un nouveau type d'onduleur qui on des rendements très élevés on fonctionnait déjà depuis depuis 2008 dans nos data center avec les onduleurs qui fonctionne en mode écho pour être le plus

vertueux possible en disant un onduleur sert très peu et on a 6 % de perte sur les onduleur donc là on a une nouvelle technologie d'onduleur fabriqué en Suisse et ce type de de nouveau onduleur en fait permet d'avoir des rendements à 99 % tout le data center est fabriqué uniquement avec du matériel qui est qui est fabriqué en Europe ou en Suisse on a à cœur de de de travailler uniquement avec des fournisseurs européens histoire de voir à quoi ressemblent les onduleurs en fonctionnement on va aller faire un petit détour par D3 on va

faire un petit saut dans le temps là on est sur des onduleurs en fonctionnement donc forcément ça fait plus de bruit et là on a des sur des onduleurs qui fonctionnent en mode en écomode c'estd Queen fait le courant du réseau va directement aller dans le data center et en fait c'est un type de uleur ou en moins de 2 miseondes l'onduleur peut prendre la charge avec la charge là tu as 5 minutes d'autonomie ce qui est largement suffisant le temps ouais parce qu'il faut 10 secondes exactement il faut 10 secondes pour que le groupe

démarre et charge protégé ici donc ça c'est les les allées avec les serveurs en fait le courant du réseau vient en direct dans le data center si jamais l'onduleur détecte une coupure ou détecte a un défaut sur le courant le courant va passer par l'onduleur sans forcément passer par les batteries c'est qu'il va juste être comment dire redressé et remis en alternatif pour être envoyé dans le ici on a la batterie et ici on a la batterie c'est que SICI on perd le courant du réseau c'est la batterie qui va alimenter le Data cent pendant

5 minutes d'accord bah sur les onduleurs on va aussi récupérer les calories de l'onduleur donc les 1 % de per ça c'est la récupération de chaleur l' ok d'accord d'habitude habituellement quand vous allez voir les fonctionn data center ben la partie onduur va avoir ses propres climatisation pour refroidir d'un côté le DAT de l'autre côté les onduleurs ben ici on récupère aussi les calories des 1 % de per des onduleurs pour aller amener cette chaleur au pompe à chaleur les batteries des onduleurs seront installées dans deux pièces séparées toujours pour limiter les dégâts en cas

d'incendie pas de fenêtre juste des murs en béton et une petite ventilation de sécurité plus le système incendie on utilise un type de batterie en fait qui sont spécialement conçus pour pour pas brûlé et pour avoir même des plastiques qui font que ils vont supporter des températures plus élevées donc c'est quoi comme petit batter c'est du du plomb c'est du lithium et là on est au plomb le plomb marche très bien c'est une technologie maétrisée donc on préfère un truc s quoi ouis exactement le retour desur se fait sur ce tableau et puis ensuite on

a la distribution qui va qui va alimenter en fait les rangés de RAC qu'on va aller voir tout à l'heure W à la Préhistoire d'Internet les allées n'étaient pas isolé entre elles c'est-à-dire qu'on posait des B dans un gros hall et pour évacuer la chaleur du matériel on posait des climatisations simple mais incroyablement inefficace parce que l'air chaud des machines se mélangeait avec l'air froid des climes aujourd'hui tout Data Center qui se respecte utilise le principe d'aller froide et chaude chaque B a logiquement deux côtés le côté dit froid qui montre la face avant des

serveurs et le côté chaud à l'arrière la configuration classique consiste à isoler physiquement les allées froides là on est dans on est dans ce qu'on appelle l'allée froide c'est-à-dire que les serveurs ici c'est vraiment la la face avant des serveurs et donc tu disais l'air arrive par où l'air froid arrive par où la foid arrive du sol et c'est le retour en fait de de l'air froide qui on rendu de la pompe à chaleur à 28°gr qui arrive ensuite pour Ben aujourd'hui là on est dans une phase encore pas d'exploitation mais ensuite tout sera hermétiquement

fermé et il faudra que l'air froid aille uniquement dans la dans les dans les serveurs le plafond est complètement fermé c'est du vert mais c'est complètement hermétique ok ensuite on peut aller voir une allée une allée chaude avant de voir la suite dans le data center on va regarder où passe l'air précisément dans les machines oui je suis allé dans le détail au maximum c'est du journalisme total voici un exemple de machine utilisé dans un data center ici le boîtier fait deux unités de haut il est tout neuf hein tout juste sorti du carton donc

pas encore complètement équipé à l'arrière on retrouve deux alimentations électriques pour assurer la redondance alimentation étonnamment petite hein pour une puissance maximale de 2200 W alors attention ça ne veut pas dire que la machine consomme cette puissance mais que son alimentation peut fournir au maximum 2200 W la carte mère accueille deux processeurs refroidis par des radiateurs ici et au milieu une place plutôt généreuse pour la mémoire vive le flux d'air dans le boîtier est assuré par une rangée de ventilateur plutôt petit n'importe qui ayant monté un PC connaît la règle plus un ventilateur est petit

plus il fait du bouquin sauf qu'ici on ne cherche pas à réduire la nuisance sonore on cherche l'efficacité les tours gamer rempli à 60 % de vide c'est peut-être joli mais c'est une énorme perte de place si on peut rentrer une configuration compl dans un boîtier tout fin alors on peut placer plus de machines par B donc plus de machines dans le data center ce qui implique des ventilateurs petits donc des allées bruyante et enfin on range en façade du matériel ici des cartes d'accélération pour entraîner des modèles d'intelligence artificielle alors bien sûr il existe

autant de boîtier que de configuration possible par exemple ici ce sont des unités de stockage chaque trappe abrite un disque dur ou l'équivalent en silicium un SSD alors on passe par là mais normalement on devrait pas pouvoir passer par là en temps normal VO le retour en fait la prise d'air en fait de toute l'air chaude du data centur on voit qu' un arrondit en fait comme une aile d'avion en fonctionnement normal l'air chaud part dans la pompe à chaleur et en mode secours l'air va partir à l'opposé pour être évacué pour que les calories

puissent être évacué à l'extérieur ah d'accord et donc là il y a un autre passage d'air au cas où on perd le système de de pompe à chaleur c'est ça donc pour résumer l'air frais arrive par le sol dans les allées froides passe dans les serveurs et ressort dans les allées chaudes où il est aspiré par une large ouverture au plafond pour partir vers les échangeurs de chaleur et c'est là que ça devient intéressant parce que le data center est différent des autres D4 est un des très très rares Data Center à chauffer de l'eau

pour être utilisé sur un réseau de chaleur ici le réseau de chaleur de Genève sauf qu'il y a un problème la température de l'air qui sort des serveurs n'est pas assez élevée le réseau de chaleur de la Ville de Genève est à 60° environ et l'air chaud du data center est à environ 40° le data center de infom utilise une pompe à chaleur pour refroidir l'air issue des allées chaudes d'un côté et réchauffer l'eau du réseau de chaleur de l'autre c'est un transfert d'énergie qui n'est pas gratuit hein car il faut faire tourner le compresseur

au milieu c'est une énorme clime avec une subtilité en plus c'est que l'évaporateur ne refroidit pas directement l'air des all chaude comme une clime classique on passe par un circuit intermédiaire d'eau qui permet d'isoler le fluide frigorigène inflammable du reste du dat Center là il y a du du courant d'air là l'air chaude du dat Center qui sera en 40 et 45°g oua va passer à travers cet échangeur Ro et on va produire de l'eau qui sera au plus bas à 38° l'air chaud va être converti en eau chaude l'eau chaude va être récupérée de

la pompe à chaleur c'estàd que la pompe à chaleur en gros va avoir une eau à 40° la pompe à chaleur son boulot va être de remonter cette température de 40° à 67° pour l'injecter dans le dans le réseau de chauffage à distance ici dans nos pompes à chaleur et ben on va utiliser vraiment les deux côtés de la Pâque d'un côté on produit de de l' chaude pour le réseau et puis de l'autre on va récupérer le froid en même et par un froid à 28°g pour refroidir les les serveurs là c'est deux tuyaux

donc derrière il y a la fameuse pompe à chaleur l'air chaud arrive par en haut ici là ça sera fermé complètement étanche l'air chaud arrive par en haut passe ensuite par ces échangeurs de chaleur et ensuite là ça c'est un mur de ventilateur littéralement ça passe à l'intérieur pour pousser l'air froid direction les allées froides de ta centur quoi c'est des ventilateurs courant continu brushless qui ont des des très ha rendements de ventil on va on va en voir d'autres on a on a beaucoup de murs de ventilateur dans dans Z Center alors vous allez

me dire une clime pour refroidir un data center ça existe depuis des années et d'ailleurs la tendance actuellement c'est plutôt de se débarrasser des climatisations pour utiliser des solutions moins énergivores mais ce qui change avec ce système c'est que ces climes ne rejettent pas sa chaleur à l'extérieur mais chauffe l'eau du réseau de chaleur de Genève donc au lieu de considérer la chaleur comme un déchet on cherche à évacuer pour le moins cher possible on la transforme en une ressource utile qu'on peut vendre même premier data center C en 2000 où on mettait on avait

jusqu'à 7 climatiseurs on fabriquait du froid comme des fous pour refroidir nos nos data centur pour éviter qu'il se rechauffe en 2008 on a commencé à faire des Data Center où on va utiliser l'air extérieur faisit de la diabatique et quand il faisait plus de 30°gr ben on allait on allait faire couler de l'eau en fait dans des cellules nid d'abeille on avait en fait un phénomène de de d'évapor rtion de l'eau qui faisait qu'on arrivit à descendre la température de 10°gr et on refroidissait comme ça nos data centeur ensuite on a fait des data

centeur on prenait que l'air extérieur qu'on filtrait et où on ventilait à fond et et à un moment donné on se disait mais en fait un data center c'est un producteur de chaleur énorme qui balance sa chaleur dans l'air parce que c'est considéré comme un déchet quoi par c'est un déchet exactement puis on s'en débarrasse comme on peut en fait et dire mais en fait non il faut valoriser cette chaleur donc au début on a on s'est dit bah on va trouver le moyen de valoriser cette chaleur et on s'est lancé en fait dans dans

s' aventure en disant bah c'est plusieurs millions de surcoup mais on le fait parce que parce qu'on est engagé on est à fond et moi gentiment ça donit un problème de conscience de dire mais on peut pas balancer C a chaud en permanence en hiver ça ça a pas de sens là où c'est très innovant c'est que c'est 100 % de l'énergie du data center qui va être valorisé et le fait de fonctionner en circuit fermé d'avoir ben de pouvoir valoriser 100 % enin nous de connaissance on n pas on n pas connaissance il y

a des attentions mais là on va on est à 3 mois de la la mise en exploitation de C data center on invite en fait bah tous les fabricants de Data Center pour dire mais ça doit être la norme et ça doit un data center doit fonctionner sur ce mode là c'est pas plus cher al le temps vous a coûté plus cher sur que ça a été on va dire 2 ans et demi de plus que de fabriquant data center normal pour nous c'està-dire slim par contre au final c'est un data center qui va nous

coûter moins cher parce que d'un côté les producteurs d'énergie pour chauffer bah ça coûte cher de faire des centrales app ça coûte cher de faire du chauffage avec de la géothermie ici on va générer beaucoup moins de CO2 parce que on utilise du renouvelable on est plutôt dans les a 10 g de de CO2 et puis puis ça génère pas de particules donc on arrive à faire du chauffage hyper virtueux à utiliser deux fois l'énergie électrique première fois pour data center une deuxième fois pour la chaleur qui est générée pour la pâack est-ce qu'on peut

aller voir la pompe à chaleur ah aller voir les la bête les deux bêtes c'est ici que ça se passe l'eau réchauffée par les échangeurs est envoyé vers la pompe à chaleur là c'est les pompes à chaleur 1,7 MW ouais c'estd qu'elles vont récupérer les 1,25 MW de de calories du data center et elles vont produire plus d'énergie elles vont sortir en fait 1,7 MW de d'eau chaude à 67°r ce qu'il faut préciser c'est que vu que c'est une techno qui est nouvelle ça n'existe pas pour les data centers ça a pas été fait pour

ça à la base tout le la problématique et tout le l'enjeu technique on va dire de ce data center par rapport à un autre c'est de réussir à adapter en fait une pompe à chaleur quoi donc c'était fait pourquoi ça à la base c'est et ben à la base ces pompes à chaleur elles vont servir d'un côté à à produire de l'eau chaude pour pour chauffer des bâtiments elle fonctionne avec des plages de température différentes on a dû avec le fabricant benah faire des tests en usine et faire en sorte que ces pompes à chaleur

puissent fonctionner pendant 20 ans minimum à à 40°r au lieu de 14°r donc on a doublé les les pompe à chaleur pour partir du principe que on puisse perdre complètement une pompe à chaleur et que le data center puisse continuer à évacuer ses calories on est aussi embêté parce qu'on est sous un parc et que le jour où on doit bouger changer ses pompes à chaleur et ben on sera obligé d'ouvrir la dalle de découper la dalle pour les pour les sortir après on aura encore un petit circuit je sais pas sil est en place

mais pour chauffer l'écoquartier là on est en direct on a fa deal avec eux pour dire vous nous prêtez votre sous-sol et puis nous on vous fournit de la chaleur on va dire entre guillemets à prix coutant c'est ils ont pas besoin d'avoir le tarif du cadre ou la moitié de l'énergie un peu comme l'électricité la moitié de du prix c'est le transport donc sur la ouais sur la pâack et ben on va lui envoyer en fait les les les minimum 40°r en fait de des calories du du data center et lui va nous rendre

28 degrés et puis après après il y a le côté vraiment réseau de chauffage à distance où là en fait on va récupérer en fait du 60°r du réseau de chauffage à distance et à l'arrière de la pompe à chaleur et ben on va sortir 67° pour envoyer dans le dans le réseau de chauffage à distance en fait c'est assez fou quand on y réfléchit une partie des jeun et voix vont prendre leur douche chauffer au processeur et au GPU c'est de l'eau chaude qui vient littéralement du cloud du point de vue du réseau de

chaleur le data center devient l'équivalent d'une centrale de chauffage urbain la utilisation de chaleur des Data Center a déjà été expérimentée un papier paru en 2020 ressense ne9u data center connectés sur un réseau de chaleur avec différentes technologies pompe à chaleur ou non en revanche il est très rare qu'on récupère la totalité de l'énergie du data center D4 de infomayac est un des premier voire le premier à être conçu pour récupérer 100 % de l'énergie dans le réseau de chaleur je parle de différentes technologies parce que le papier précise qu'il y a trois moyen de

refroidir un data center par rir comme on le voit chez inf faux maniaque par water cooling c'est-à-dire en refroidissant direct les composants qui chauffent le plus avec un circuit d'eau et pour les systèmes à très haute densité d'énergie par changement de phase au lieu de faire passer un liquide pour récupérer les calories on utilise carrément l'évaporation pour ces deux derniers systèmes la réutilisation de chaleur est plus simple car on peut directement avoir de l'eau chaude à 60° sans utiliser de pompe à chaleur mais malheureusement ça ne peut pas s'adapter à tous les types de data

center c'est plus pour des très gros centres de calcul spécialisés dans une tâche précise vous allez avoir beaucoup du même matériel et à partir de ce moment-là ça vaut le coup de standardiser le système de water cooling alors que dans les data centers de infomaniaque par exemple c'est plus multifonction en fait il y a de tout il y a du stockage il y a du calcul il y a plein de machines différentes qui ne sont pas refroidies exactement de la même manière qui émettent pas la même quantité d'énergie et donc c'est beaucoup plus simple et

beaucoup plus économique d'utiliser directement du refroidissement par r dans tous les cas pour réutiliser cette énergie il faut pouvoir être raccordé à un réseau de chaleur en France par exemple les réseaux de chaleur existent mais ne sont pas aussi développés que dans certains pays ça implique aussi d'être proche du réseau de chaleur pour éviter les pertes de transport donc le data center doit être urbain et pas installé au fond d'une zone industrielle ensuite un data center produit en permanence la même quantité d'énergie qu'il faut aussi évacuer l'été une centrale de chauffage urbain bah l'été on

l'arrête on diminue sa puissance les Data Center c'est pas possible ça tourne toujours à peu près à la même puissance D4 a l'avantage d'être raccordé à un réseau de chaleur suffisamment vaste pour pouvoir évacuer son énergie à n'importe quel moment de l'année en hiver il va servir à chauffer un certain nombre de logements et en été il va fournir de l'eau chaude pour les douches par exemple à beaucoup beaucoup plus de logements bien sûr on peut imaginer plein de choses pour que ça soit possible par exemple on peut envisager qu'un dat Center chauffe un petit

réseau de chaleur construit autour de lui en hiver et évacue une partie de son énergie dans l'atmosphère en été on peut aussi stocker la chaleur dans le sous-sol en été pour le réutiliser en hiver il y a plein de possibilités et c'est justement pour ça que D4 est intéressant si ça se trouve le concept va faire des petits dans tous les cas on ne peut pas avoir qu'un seul système de refroidissement et oui il faut pas oublier la redondance pour une raison ou une autre le réseau de chauffage peut ne plus être disponible surtout que

ce data cent est un des premiers dans son genre il y a un côté expérimental s'il y a un souci avec la pompe à chaleur par exemple il faut qu'il puisse continuer à tourner on a donc conçu un autre système de refroidissement qui sera utilisé qu'en cas de secours admireer un peu la prise d'air pour refroidir donc la totalité du data center en cas de d'urgence ça fait 3 m par 3 m là l'endroit où on est ou de de Don vraiment la prise d'air et je suppose qu'il y aura une grille aussi ouais il

y a un filet un filet en acier pour éviter que cette prise d'air vient avec sa copine à l'opposé du centre de données le flux d'air est mis en mouvement par deux murs massifs de ventilateur un pour envoyer l'air frais dans les allées froides l'autre pour évacuer l'air des allées chaudes c'est l'air qui va être poussé pour refroidir donc les serveurs donc soit on a l'air qui vient du bas et en fait l'air quel mod secours et puis au-dessus en fait on voit l'autre arrivée d'air quel fonctionnement normal c'est tous des clapés antirretour qu'on voit

ici en fait qui vont s'ouvrir en fait quand le data center fonctionnera normalement et c'est juste que quand on pousse l'air en mode secours ben il faut pas que l'air repart dans les all chaud donc on a un mur de de clap quo des débit on va surventiler les serveurs même s fait 36 degr dehors et ben on va refroidir les serveurs à 36°g mais avec des débisir plus importants que le fonctionnement normal du serveur le processeur B à 80 il s'en fout d'avoir 36°gr sauf qu'on doit envoyer du déb plus important à 36 de

que si on refroidit un serveur à 28° donc là on est du côté chaud de la ventilation de ceours ok donc on retrouve ici les fameuses trappes qui basculent quand l'air va sortir donc quand ce mur ici de ventilateur se mettra en route ça ça pivotera ces ces petites trappes là hop et l'air sortira à l'extérieur le data center étant en plein milieu d'un quartier d'habitation on a placé un mur d'absorbeur antibruit à l'entrée et à la sortie pour absorber le bruit de la ventilation de secours donc là ouais on est de l'autre côté des

ventilateurs ça c'est les ventilateur qu'on a vu de l'autre côté vu que c'est un mur de ventilo c'estàd que ça ça va tourner qu'en cas de situation exceptionnelle même pour ça pour éviter de déranger puisqu'on est dans un quartier d'habitation alors que ça c'est censé tourner que de manière exceptionnelle on a un système antibruit et c'est cette espèce de parois ici ça été calculé par un acousticien qui a calculé que l'on cur et le débit d'air qui va passer entre les deux pièges à son va faire en sorte que l'onde sonneur qui remonte va être

piégée dans le piège à son ce système de refroidissement de secours est donc un simple flux d'air venant de l'extérieur pas de climatisation juste de l'air et ça marche plutôt bien ce système parce que D3 un notre Data Center d'infomaniaque est refroidi comme ça deuxème data center donc là on est à D3 c'est ça donc ce data center il a il a 10 ans il est considéré comme data center très vertueux parce qu'il y a pas de de clim dans ce data center c'est va uniquement refroidir aclair extérieur là il y a de la redondance

c'est que ici on a il y a plus plus de redondance là on est plus sur du Tier 4 c'estd que ce qui manque dans le data center pour être Tier 4 ces deux tableaux électriques doent être dans deux dans deux pièces séparées pareil pour les onduleurs et on serait en Tier 4 empiler quelques millions d'euros de matériel dans les allées c'est facile faire tourner tout ça quoi qu'il arrive c'est plus complexe enfin quoi qu'il arrive ça dépend du niveau de fiabilité que vous voulez imaginons qu'on ne mette pas en place de sécurité particulière 99

% du temps le matériel de base va fonctionner sans problème l'alimentation électrique sera présente et le refroidissement va tourner 99 % c'est pas mal non bah pour un particulier oui mais si vous êtes une boutique en ligne 1 % d'indisponibilité par an c'est 88 he en fonction de l'entreprise c'est des centaines de milliers voire des millions d'euros qui s'envolent sans compter le coût en mauvaise réputation on va donc essayer de gratter au maximum ces 1 % restants le problème c'est que plus on s'approche du risque zéro plus il faut prendre en compte des cas extrêmes

plus c'est complexe plus c'est cher en fait une bonne partie du matériel redondant qu'on a vu c'est pour les 0,1 % voire pour les 0,01 %. voire des systèmes qu'on utilise jamais l'indicateur qui est utilisé pour situer facilement la fiabilité d'un centre de données c'est les tiers qui vont de 1 à 4 alors cet indicateur ne fait pas tout on en parle après mais pour vous donner une idée du niveau de paranoïa c'est pas mal le tiers 1 assure une garantie de fonctionnement de 99,671 %. oui c'est précis donc le centre de données avec le

niveau minimal de sécurité c'est maximum 28,8 he de temps or ligne cumulé dans l'année le tiers 4 lui garantit un temps de fonctionnement de 99,900 95 % maximum 26 minutes hors ligne par an ce qui demande des dispositions absolument draconiennes par exemple les circuits électriques sont tous séparés physiquement dans des pièces différentes et la redondance est plus importante mais les tiers sont-ils encore pertinents pour mesurer la fiabilité d'une infrastructure quand on a plusieurs data centers les les les tirs étaient initialement faits sur des technologies Data Center où on pouvait pas répliquer les données on était

obligé en fait de de sécuriser de plus en plus les Data Center aujourd'hui on est en train de de baisser le tir parce qu'en fait ça met la redondance inutile en sachant que la redondance on la veut sur des sites physiques vu qu'il y a plusieurs data center ça sert à rien de blinder à fond un seul exactement de nouveau en disant pour moi aujourd'hui la fiabilité on l'a avec la redondance sur des ces donc pour moi c'est plus du tir mais il faut partir sur la multiplication des des Data Center mais ce data centur

un pu annuel qui est juste en dessous de 1.1 et donc il reste très vertueux mais c'est de la chaleur perdue d'accord oui puisquon récupère pas la chaleur sur celui-là c'est un refroidissement qui part dans l'atmosphère c'est ça pu veut dire power usage effectiveness en français indicateur d'efficacité énergétique c'est tout simplement l'énergie totale consommée par le data center sur l'énergie consommée par les équipements informatiques avec un pu de 1,1 ça veut dire que pour 100 W consommé par un serveur il y aura 10 W consommés par le bâtiment ces 10 W prennent tout en compte

refroidissement onduleur éclairage système de sécurité et cetera et cetera et 1,1 c'est une très bonne optimisation même aujourd'hui alors que ce dat Center a 10 ans pour comparaison la moyenne européenne est d'environ 1,8 donc là on est côté côté serveur on est dans l'allée froide ici là le froid vient du plafond où en fait on a des con de filtration au-dessus des allées froides on prend l'air extérieur on la descend enfin elle tombe naturellement l'air froid tombe naturellement arrive dans les serveurs en hiver on va aller récupérer de l'air chaude des allées chaudes pour pas

voir trop froid on doit faire attention en fait que on a plus de problèmes avec le froid le froid est plus sensible que le chaud à 6 degrés toute la partie fibre en tombe en panne avec le connecteur vibre sur les serveurs donc on doit faire attention au froid le chaud on a on a beaucoup plus de marge là on voit qu'on est on est sur un Data centur en production donc tout est étanche pour que l'air parte uniquement dans le dans les serveurs on a on a un peu de tout c'est qu'on mixe on

mixe dans les années on va trouver du stockage on va retrouver du du calcul ça fait du bouquant he en fait non ça fait pas de bruit parce que il fait il fait froid dehors je veux dire que là en fait le bruit est pas très élevé parce qu'il fait frais quoi exactement parce qu'on va aller dans une allée chaude et et en fait là les ventilateurs il tournent juste pour que pour pas gêner en fait l'air qui monte naturellement dans dans les serveurs si on regarde dans une allé chaude on va voir alle est

chaude ou là il fait chaud il fait en effet il fait bon là là il fait bon donc là c'est bon une allée chaude donc connait le principe on l'a vu ailleurs mais vu qu'on est en production bah il fait beaucoup beaucoup plus chaud que que là-bas et puis on peut voir l'évacuation de l'air chaud en fait qu'on envoie à l'extérieur avec une petite partie qu'on va emmener dans les allées froides pour qu'en hiver on on est pas trop froid en fait ici on a trois armoires de ventilation que on a trois ventilateurs parallè on

a trois armoires de régulation qu'on va dispatcher dans le data center à des endroits différents pour partir du principe on peut perdre complètement une armoire le data center continue à fonctionner en il a toujours ce souci de dire on doit tout le temps être alimenté mais on doit tout le temps pouvoir évacuer les calories du du data center ici on est au-dessus du Data Center où on B va retrouver les cassons de de filtration ce qu'il est filtré avant et il va tomber l'air froid va tomber dans le serveurs l'air frais rentre là en fait

voilà rentre dans des filtres et c'est des filtres exactement une fois qu'elle est passé dans le data center et ben elle va être évacuée par les les ventilateur qu'on a vu et elle va partir directement en l'air s' fait 36°gr d'or et ben on va juste augmenter les débits d'air on va les multiplier pour pouvoir évacuer toujours les calories et ce qu'on fait en hiver c'est qu'on va récupérer une partie de l'air chaud pour la réinjecter en fait dans les allées froides pour pas que il fasse trop froid dans les SAV une partie de l'air

chaud qui sort là se retrouve dans le le froid pour réchauffer un minimum et le reste est renvoyé directement l'air donc c'est très simple mais ça marche terriblement bien et on a des serveurs qu'on bah ici qu'on 10 ans de fonctionnement bah on a un taux de panne qui est hyper bas et ça fonctionne très bien quoi de on avait besoin un peu d'ombre pour éviter qu'on aille le soleil qui tombe directement sur les installations donc on a mis une centrale solaire au-dessus du du data center et sur les bâtiments à côté 500 kW un

peu plus de 500 kW Crète et avec du panneau solaire fabriqué intégralement en Europe et des onduleurs aussi fabriqués en Europe on n pas pu voir les groupes électrogènes de secours de D4 donc on a profité d'être sur le toit de D3 pour regarder à quoi ça ressemble ça c'est les groupes électrogènes ah oui c'est ils sont gros c'est trois groupes qui dès qu'on a deux groupes électrogènes qui sont synchr et qui peuvent injecter du courant il faut une dizaine de secondes le temps qui démarre les onduleurs utilisent leur batterie et ensuite qu'on a de

groupe électrogène synchronisé et ben l'onduleur se coupe et c'est comme si c'était une autre source de courant comme le le courant du réseau quoi ces groupes électrogènes sont utilisé en cas de perte totale d'alimentation les onduleurs ne servent qu'à maintenir l'alimentation le temps que les groupes électrogènes démarrent donc groupe électrogène 1 de secours groupe de secours 1 groupe de secours 2 groupe de secours 3 i au cas où voilà et puis ça en fait c'est pour après les deux tableaux de 5 ro sur les de TGBT c'est marrant parce que en fait là on voit

la consommation du et on voit qu'elle en fait elle est divisée par deux parce que la charge la cons kW d'un côté la même chose quo là la consommation est d'environ 670 kW à peu près réparti donc sur les deux les deux côtés bon je suis un petit peu embêté pour la conclusion parce qu'on a tellement discuté de tout en détail qu'on a été limite niveau temps et j'ai pas pu enregistrer de conclusions sur place mais je pense qu'on a fait un bon tourin on a tout vu ou presque là maintenant vous voyez à quoi

ressemble de près un data center bien sûr il en existe des beaucoup plus gros mais le principe de fonctionnement reste à peu près le même et la chose qu'on peut constater c'est que bah c'est une logique industrielle ça n'a absolument rien à voir avec le petit gamer chez lui qui monte sa petite configuration de PC pour se faire plaisir là on est vraiment dans une logique d'optimisation optimisation énergétique optimisation écologique et je suis assez content d'avoir pu montrer à quoi ça ressemble avec un faux maniaque puisque je trouve que leur démarche est très intéressante j'aime

bien le côté où ils essayent de faire le plus local possible d'être le plus écolo possible et tout et ils sont vraiment honnêtes dans leur démarche vraiment pour avoir discuté avec eux toute une journée il y a il y a pas de souci là-dessus et le resto qu'on a mangé à midi qu'est-ce qu'il était bon je les remercie donc de m'avoir invité en particulier Boris pour toutes ses explications et Thomas pour son accueil chaleureux si cette expédition dans de Data Center vous a plu n'hésitez pas à le dire dans les commentaires je suis en train

de faire évoluer mon format comme vous avez pu le constater avec plus de spontanéité je laisse la parole aux gens qui m'expliquent des choses p pendant les visites je pense que ça rend le tout plus dynamique plus vivant plus intéressant voilà j'essaie un peu de de d'écrasser le format vous voyez le cadrage a été assuré par Thomas Bernaudin et il faut dire c'est quand même beaucoup mieux quand c'est lui qui est derrière la caméra que quand c'est moi hein n'hésitez pas à aller voir les offres d'infomaniaque si la philosophie d'entreprise vous parle on se voit

le mois prochain une autre visite de prévu un sujet qui n'a rien à voir avec celui-ci mais qui vous plaît bien ça je le sais parce que j'en ai déjà parlé sur cette chaîne et en attendant je vous dis salut amis bidouilleurs et bidouilleuse [Musique]