Olá pessoal, bom dia! Todo mundo me ouve bem? Maravilha! Muito obrigado pela presença nesta manhã. Obrigado pelo interesse no assunto e obrigado por sintonizar aqui no Palco Três com a gente. Vamos falar hoje sobre Cidades Inteligentes. Como construir Cidades Inteligentes com uso da computação em nuvem. Meu nome é Jackson. Eu sou gerente de contas do território de GovTechs. Já vou explicar um pouquinho o que é GovTechs. Antes, vou pedir que meus colegas se apresentem também. Oi pessoal! Bom dia! Obrigada pela presença! Meu nome é Ariane. Trabalho com o Jackson, atendendo especificamente GovTechs, como arquiteta de

solução, e meu papel é ajudar vocês caso tenham algum projeto para melhorar cidades, municípios, a vida do cidadão. Eu ajudo vocês com as decisões, técnica, dúvidas, enfim. Olá, pessoal! Bom dia a todos. Sou Bruno do time de DataLab. trabalho implementando soluções de Analytics. Trabalho também atendendo o time de Public Center e o de Commercial. Espero que gostem do nosso material. Bom dia! Obrigado! Como veem, estou muito bem acompanhado. E GovTechs. O que é GovTechs? Por que GovTechs? O que estamos fazendo aqui? A AWS tem especializações. Diversos times especializados em verticais, em segmentos. A AWS é

totalmente direcionada ao setor público. A AWS, também é direcionada a contas privadas, a que chamamos de CS. E quando falamos de Cidades Inteligentes, existe uma conexão entre o público e o privado, políticas públicas e também iniciativa privada. Hoje, dentro do setor público, do time de governo, existe uma especificação, um time especializado em GovTechs em companhias da área privada Que desenvolvem e vendem para o governo. Como veremos aqui, Cidades Inteligentes é um tema muito abrangente e ter uma equipe dentro da AWS que entende, que sabe fazer a conexão entre o privado e o público, e olha

para as cidades, olha pra a GovTechs, é muito importante para conseguirmos potencializar e acelerar a construção de Cidades Inteligentes. Falaremos hoje, então, dentro desse tema, um pouco do conteúdo, O conceito do que são cidades inteligentes, tendências e desafios. Vamos entrar um pouco mais na visão técnica, de estratégia de dados, disponibilidade das aplicações. E, a cerejinha do bolo com o Bruno, no final, uma demo ao vivo. Então, conceito de GovTechs, conceito de Cidades Inteligentes (Smart Cities). Estudiosos atuantes na área, pesquisadores têm diferentes visões do que é o conceito de Smart City, mas todas essas visões, esses

contextos, têm um ponto em comum, Que é a melhoria da qualidade de vida do cidadão, seja do ponto de vista urbano, do ponto de vista tecnológico, do ponto de vista de melhor aproveitamento dos recursos. A melhoria da vida do cidadão é o que essas visões têm em comum. Vemos que esse ponto em comum traz o desenvolvimento de polos econômicos, Traz também uma estruturação da governança de dados, da gestão mais eficiente das cidades. E podemos observar, tanto no urbanismo, numa ciclovia, que ajuda o cidadão a chegar do ponto A ao ponto B mais rápido, Também é

uma Smart City. IoT, um bueiro inteligente que começa a enviar sinais assim que o nível da água começa a subir é também uma Cidade Inteligente. A gestão mais eficiente dos dados de uma cidade é, também, Cidade Inteligente. Então, começamos a enxergar que Cidades Inteligentes têm ações e iniciativas para transformar essa cidade numa Cidade Inteligente, sem deixar ninguém para trás. Hoje, a ONU tem uma agenda para 2030, composta por 17 indicadores Que passam por saúde, educação, qualidade de vida. E no lema da Agenda 20-30, que o Brasil também já tem aderência e uma carta publicada. É

muito claro esse objetivo de não deixar ninguém pra trás, transformar as Cidades Inteligentes sem que ninguém fique pra trás. E quando falamos de Cidades Inteligentes do ponto de vista de tecnologia, de dados, observa-se que existe uma interação muito grande entre os sistemas, seja transporte e mobilidade, conexão dos sistemas que apoiam essa ação. Vemos que a tecnologia apoia essa interação, essa conexão muito focada em segurança, com o objetivo final De trazer melhoria para o cidadão, para a qualidade de vida do cidadão. Como mencionei, quando olhamos Cidades Inteligentes, ou o que a mídia fala bastante sobre Cidades

Inteligentes, pensamos logo em IoT. Mas não necessariamente apenas o IoT é um componente de Cidades Inteligentes. Temos aqui hoje na plateia, por exemplo, nosso parceiro Estar Digital, que faz hoje acompanhamento de vagas públicas nas cidades através do uso de IoT. Esse é um dos componentes. Estamos aqui hoje para falar que são diversos outros componentes que estão dentro de uma iniciativa de Cidade Inteligente, como, por exemplo, dados da gestão pública. Estamos aqui há cinco minutos conversando na cidade de São Paulo. Imaginem quantos dados foram gerados somente na administração pública de São Paulo? A cidade recebeu, a

cidade pagou, a cidade, gerou impostos, a cidade gerou dados. Além desses dados da gestão pública, que estão acontecendo o tempo todo, temos também dados climáticos do que vai acontecer com o nosso tempo, dados demográficos, quem entrou e quem saiu da cidade, Dados territoriais. A junção de todos esses dados forma um conjunto muito grande e muito valioso que podemos aproveitar para fazer uma gestão mais eficiente. E aqui vem uma pergunta: "Jackson, fazer uma gestão mais eficiente dos meus dados é uma Cidade Inteligente?" Se eu pegar os dados que estão disponíveis e tirar insights deles, fizer com

que aquilo me garanta otimização, eficiência e qualidade de vida para o cidadão, isso é uma Cidade Inteligente? É também. Então começamos a enxergar que não necessariamente, Eu pego uma cidade e a classifico: "Essa cidade é inteligente." Começamos a enxergar que as cidades estão propondo ações para se tornarem inteligentes, seja no urbanismo, tecnologia, cloud, IoT. E falaremos de um pedacinho, que é a gestão mais eficiente dos dados para se tirar insights. Acredita-se, cientistas fazem um forecast hoje, de que, em 2030, teremos dez vezes mais dados do que tínhamos em 2010. E é interessante fazer aqui um

paralelo, por exemplo, com o petróleo. Temos escutado bastante que os dados são o novo petróleo, inclusive, hoje grandes empresas têm dito que os dados são um novo petróleo. Se fizermos um paralelo, a humanidade conhece o petróleo desde o início da era cristã. Já era usado em iluminação, como material bélico. Mas somente em 1850, começamos a fazer craqueamento do petróleo, transformá-lo em óleo diesel, querosene, trazer para o transporte, trazer para essa tela que estamos vendo, para o celular que está na sua mão e trazer toda essa grande gama que o petróleo tem hoje nas nossas vidas.

Então, o que podemos fazer com uma quantidade tão grande de dados? Estamos só no começo dessa jornada, só começando a trazer esse valor e esses insights do que os dados podem ser para nós e trazer de melhoria para nossa vida no futuro. E o que esperar desse futuro, dessa grande quantidade de dados? Podemos esperar, e já estamos vendo isso do ponto de vista de consciência, de cyber segurança e privacidade. Um aumento da consciência de privacidade. Temos, por exemplo, no Brasil, a iniciativa da LGPD. Temos, por exemplo, a LGPD sendo criada. Temos, na Europa, a GDPR.

É uma consciência diferente para o cidadão em relação aos dados. Há dez anos, talvez não tivéssemos essa mesma consciência de ter um ambiente seguro e de ter privacidade dos meus dados. Começamos a observar também, uma fluidez entre o público e o privado. Com o celular na mão, você consegue pedir seu carro, sua comida, acessar seu banco. Tudo isso dentro do setor privado. Existia, no passado, uma diferença muito grande com o público. Você queria sua carteirinha de vacinação? Tinha que trazer um papel na mão, mostrar, Porque era um serviço público. Acredito que, assim como eu, alguns

entraram aqui mostrando sua carteirinha de vacinação pelo aplicativo. É disso que estamos falando: uma fluidez e percepção entre o público e privado, o privado puxando a usabilidade do público e o público também puxando o privado. Inteligência artificial aplicada às necessidades das cidades, de que falaremos um pouco mais na demo, e a criação de novos ecossistemas. Resolver um desafio de uma cidade, e melhorar a qualidade de vida do cidadão, Impulsionará a criação de novos ecossistemas e plataformas de colaboração. Começamos a falar que os dados são um ativo, não mais um custo. A visão de que custa

caro guardar meus dados, e o dado é um custo que preciso manter lá parado, está mudando. Governos, cidades, a iniciativa privada tem olhado os dados como fontes de renda, como ativos, como algo para trazer insights. E quais são os desafios que a gente enxerga? Maravilha. Há um mercado muito interessante, muito bom para nós. E quais são os desafios? Quando olhamos Brasil, esse país tão interessante em que vivemos, Esse país com dimensões continentais. O Brasil tem 5570 municípios catalogados, sendo que 87% têm até 50.000 habitantes. e 68% têm até 20.000 habitantes. Então, estamos falando de um

país de dimensões continentais, com uma característica muito grande do que entendemos por cidades não tão grandes, cidades relativamente pequenas. Não só o tamanho das cidades, o tamanho da população. Mas há tem outros itens que compõem a diversidade dessas cidades. Conectividade, arrecadação. Que tipo de indústria há naquela cidade? É uma cidade que vive do turismo? É uma cidade que vive da economia? Uma cidade que vive da indústria química? Não só a diversidade de tamanho de população, mas também a diversidade que compõe aquela cidade como município. Temos também desafios técnicos. Podemos mencionar como desafio técnico a padronização

e governança dos dados. Um exemplo muito claro, aqui: eu tomei vacina de sarampo, tomei vacina de tétano, acho que não tomei de catapora. Minha vacina da catapora foi a própria catapora. Mas eu me lembro que minha mãe me levava no posto de saúde na UBS. Tinha um papelzinho que eu levava pra casa um que ficava na UBS. Eles faziam um registro deles, um registro de dados. Podia ser em sistema, podia ser em papel. Mas ele tinha uma governança. Cada UBS do país, com a sua própria governança. Quando surgiu a necessidade de um sistema de notificações

em tempo quase real durante a pandemia, para acompanharmos quem está sendo vacinado, quantas vacinas já foram, precisamos de uma governança de dados muito mais sofisticada, rodando hoje em a AWS, rodando desde o início em AWS. Vocês mostraram com seu aplicativo, O sistema de notificações rodando em AWS. Imaginem a sofisticação de governança de dados que tínhamos lá no passado, há dez anos, e que a precisamos ter agora para ter todas as unidades básicas do país reportando em tempo real. Outro desafio é a mão de obra e capacidade de processamento. Como fazemos para processar essa quantidade tão

grande de dados? Com a nuvem AWS, como, por exemplo, nosso parceiro Quasar Desenvolvimento de Sistemas. Se vocês procurarem Quasar, case alvará de licenciamento, vocês vão encontrar uma empresa de Belo Horizonte com um time altamente especializado em liberação de alvarás, Que tem uma solução que faz a automatização de liberação de alvarás, de licenciamento. Se você é empreendedor e quer colocar sua companhia para funcionar, precisa pedir um alvará ao Corpo de Bombeiros, um alvará na prefeitura, dependendo do seu negócio. pedir um outro alvará, talvez para vigilância sanitária. Em cidades que a Quasar atua, tempos para a liberação

de alvará de até três dias foram reduzidos para 15 minutos, ligando dados do Corpo de Bombeiros do município, da Rede Federal, diminuímos de três dias para 15 minutos. Isso é bom para a cidade, Porque a cidade começa a arrecadar mais rápido. Bom para o empreendedor, porque ele começa a vender mais rápido. Bom para o consumidor, porque ele começa a consumir mais rápido. E agora a vamos começar a pincelar um tema que é o nosso grande ponto aqui. Quais insights podem ser gerados a partir das fontes de dados já existentes? Os dados estão lá, o valor

está lá. Como tirar insights desses dados? Temos um parceiro chamado Betha Sistemas. A Betha produz ERPs para prefeituras. Ela faz sistemas de gestão para prefeituras. No ano de 2019, A Betha desenvolveu uma solução Para fazer a predição de quais são os perfis de alunos mais propensos a se evadir da escola ou a reprovação. Utilizando o SageMaker, ela montou um modelo de inteligência artificial, aprendizado de máquina que levava em consideração 17 indicadores já existentes, indicadores de presença, indicadores de notas dos últimos anos, perfil socioeconômico da família, e fez um modelo no qual a solução dizia, no

primeiro bimestre do ano, quais seriam os alunos mais propensos a reprovação ou a evasão escolar. Isso permitia que a escola, no primeiro bimestre, No terceiro mês do ano, já saber, com até 90% de acerto, quais os perfis mais propensos a se evadir ou a reprovar. No ano de 2020, primeiro ano da pandemia, o Brasil sofreu, na verdade, durante a pandemia, um aumento de 171% de evasão e reprovação escolar. O município de Bombinhas, em Santa Catarina, utilizando essa solução de predição de quais são os perfis mais aptos, conseguiu diminuir, em 20%, a evasão e a reprovação

em relação a um ano normal. Então, no momento em que o país aumentou em 171%, aquele município, Utilizando essa solução em nuvem Betha Sistemas, AWS, conseguiu diminuir em 20% a evasão em relação ao ano anterior. Isso é bom para o cidadão, porque aquele garoto, aquela criança, aquela garota que poderia ter sido reprovado ou evadido, passou para o próximo ano. Ela tem mais chance de ter um melhor emprego, se formar melhor, de trazer melhoria para sua família. É bom para a cidade, porque o dinheiro investido na formação dela foi bem aproveitado. E bom para todos nós.

E como perceber o valor desses dados. É um desafio perceber o valor desses dados. Está todo mundo aprendendo. E eu vou chamar a minha colega Ariane para me ajudar e ajudar a gente entender um pouco melhor como tirar valor desses dados. Bom pessoal. Como Jackson já lhes deu um belo de um contexto, estamos falando de muitos dados que são gerados a todo momento, e isso vai crescer de forma exponencial. Enquanto estamos aqui, estamos gerando dados também, e só aumentando essa base. E fora isso, além da diversidade do território brasileiro como um todo, Da diferença desse

município, se ele é rural, se não é, o tipo de informação que ele precisa para trazer uma gestão eficiente para aquela cidade da forma correta, para ter valor para o cidadão, também temos, pensando do lado técnico, desafios para classificar esse dado. Temos dados estruturados, semiestruturados, não-estruturados. Como organizar tudo isso? E sem contar o legado também. Então, nem sempre será fácil para se extrair essa informação. Isso é um desafio para a nós também. Além disso, pensando na estrutura, tem o acesso. Então, também temos que pensar em como gerir os acessos Para prover a informação correta à

pessoa correta. Porque se provemos, digamos, uma informação aqui para a mim, chegar alguma informação de vacina, de IPTU da cidade, eu não vou entender nada. Então, ela tem que chegar para quem precisa daquela informação para conseguir ter ações eficientes e prover serviços e agregar valor. Quando conversamos com nossos clientes, o que eles comentam é que eles têm as informações, elas estão ali, mas esse é o grande desafio. Como entender isso para a trazer valor de fato? Como ter uma plataforma flexível para gerar o insight, um valor correto daquela informação? E aí... E aí, então a

pergunta. A primeira pergunta que a gente faz: Mas como é que eu organizo tudo isso? Você está me falando que tem um monte de dados diferentes, com formatos diferentes. Como é que a fazemos isso? Qual é o meio para fazer isso? E aí, quero apresentar a vocês o data lake, que aqui na AWS definimos data lake como um repositório onde vocês centralizarão dados estruturados e dados não-estruturados, semiestruturados, que vocês têm, ou seja, desde um CSV, uma foto, um vídeo, o que vocês tiverem de dados Que vocês estão gerando, vocês podem armazenar no data lake, e

de uma forma em que ele será centralizado, para que todas as aplicações que vocês tenham, ou que vocês precisem, possam consumir. Então, isso se torna, automaticamente, uma fonte única de verdade dessa informação. E que possa ser... Eu comentei que ele é flexível. Então, a ideia é que vocês possam ir plugando aplicações diferentes conforme a necessidade, e no tempo que vocês precisarem. Então, vocês podem ir incrementando, como se fosse uma pecinha ali que você vai encaixando. E aí, a pergunta dois: Mas eu tenho dados diferentes. Centralizei. E você está me falando que um monte de gente

e de aplicações vão consumir? Como é que ela vai saber o que está lá se está tudo misturado, tudo centralizado? E aí a temos aqui a camada, o catálogo. O que é o catálogo? Por que tem esse desenho aí fazendo essa camada, né? Ele é a interface do data lake. É ele que vai mapear o que a gente tem ali, os dados que temos armazenados. Então ele vai pegar e dizer: “Opa! Eu tenho um tipo string, tenho um tipo inteiro...” Ele que vai entender a informação que tem ali dentro e vai expor, como um catálogo,

para que as aplicações possam consumir e fazer queries em cima dela. Então você poderá fazer select em cima dos dados que estão ali dentro. Essa é a função. Dessa forma, temos, então... Passou! Dessa forma, temos as etapas para a gente trabalhar esse dado. E a AWS traz a ferramenta para ajudar vocês a construir cada uma dessas camadas. Se fôssemos agrupar aqui, para a fazermos um bate papo, Em camadas, eu agruparia em quatro partes. A primeira delas seria aqui em gestão, ou seja, onde está esse dado? Como é que vamos trazê-lo para a cloud, aqui, para

a AWS, para a começarmos a tirar valor e ter esses insights em que queremos chegar, igual aos exemplos que o Jackson nos trouxe. Então, aqui começamos a perguntar e a responder aos requisitos, tipo, qual o volume de dados que eu tenho para a trazer para a nuvem? Qual volumetria eu tenho? Eu tenho banda de internet? Precisa ser uma carga offline? Eu preciso ser em tempo real? Isso está no meu on-premise ou já está na nuvem, Mas é uma aplicação que eu quero trazer para a cá, que hoje não está mandando os dados diretamente para o

data lake. Então, tem uma série de perguntas que respondemos, e para cada uma delas, vamos encontrando o melhor serviço, a melhor ferramenta para trazer esses dados, e para começar a trabalhar. A segunda etapa aqui, seria a camada de data lake, Infraestrutura e Governança. Por que eu agrupei ali? Porque aí, uma vez que os dados já estão aqui na cloud, começamos a criar nosso repositório centralizado. E aí começamos a criar a infraestrutura do nosso data lake, para que, daí sim, as outras duas camadas aconteçam, Que serão serviços para a Analytics. Então você pode prover serviços para

o time que precisa ter um Analytics, precisa fazer uma query, pois é só extrair alguma informação ali. Ou até mesmo para o usuário final de vocês. Vocês podem extrair na parte de visualização, como por exemplo, o Amazon QuickSight, relatórios, dashboards... Expor... Então você pode ter “n” utilidades de acordo com quem vai acessar e qual a necessidade de casos de uso de vocês. E aí... Beleza. Temos as camadas. Falamos que temos os requisitos. Uma forma de começarmos a organizar e entender qual é o melhor serviço, qual é o melhor momento para atender. Podemos começar, então, a

pensar em data-driven, ou seja, começarmos a pensar movido a dados. Tanto a equipe técnica, quanto a equipe de produto, de negócio, enfim, o time como um todo que está pensando naquele serviço, naquele produto que vocês querem oferecer, começar a pensar assim: Eu tenho esses dados. O que eu preciso extrair deles? O que consigo extrair deles, como o Jackson comentou. Pode haver dados vindos de fontes, departamentos, cidades diferentes. Enfim, quando quero juntar, o que consigo tirar? Qual o insight que tiro dali? Porque às vezes, olhando isoladamente, não conseguimos perceber isso. É preciso juntar tudo. E também,

a parte técnica vai pensar junto com o negócio e vai falar: “se você quer esse dado, onde ele está?” E aí entram aquelas camadas que comentei para a escolhermos o serviço, ver qual a volumetria pensar, quem vai acessar. Então, começamos a estabelecer um pipeline robusto para esses dados desde o momento da captura Até o momento em que gerará valor para o negócio. Temos que pensar juntos e pensar movido a dados. É uma leve mudança que vimos tendo. E uma vez que começamos a pensar nesse pipeline, a primeira etapa, é estabelecer esse repositório a que me

refiro, onde tudo é movido em cima de dados. Estamos falando da várias... consome lá, consome os dados, pega lá, gera insights... Então, a primeira etapa é: vamos estabelecer onde ele vai ser armazenado, esse repositório central que comentamos aqui. No caso, usaremos o Amazon S3, Que será o coração do nosso data lake, que é ele que vai armazenar tudo. Então ele aceita objetos. É um storing de objetos da AWS. Vocês podem armazenar dados estruturados e não-estruturados. Como ele é flexível, você pode ter integração com diversos serviços, também. E é escalável, então, lembram-se da preocupação dos dados

crescerem de forma exponencial? Não temos aqui porque ele é altamente escalável. E uma vez que temos a base para centralizar isso, começamos a pensar Em quem vai consumir, qual vai ser a aplicação. Vai ser uma API? Vai ser o usuário final? Então é preciso estabelecer o ****** Utilizar um Amazon Cognito para gerir os acessos do usuário final. Vai ser mobile? Vai ser desktop? Começa-se a ter uma governança, uma gestão dos acessos para se chegar até aquele dado, para a se prover a informação correta, da forma correta. E quando falamos em dados, como o Jackson mencionou,

há a preocupação com a segurança dele, também. É preciso pensar na criptografia também, porque o dado está lá, armazenado, ele está em repouso. Então, como trabalharemos? O S3 tem já, criptografia, mas também é possível utilizar as chaves de vocês. Pode-se utilizar criptografia do lado do cliente. Também pensamos na rastreabilidade para saber de onde esse dado veio e qual foi a requisição, para caso vocês precisam extrair algum relatório, alguma auditoria, algum compliance, enfim. Vocês consigam rastrear tudo que está ali. E aí sim, aí já temos a nossa... Eu costumo brincar, que isso aqui é a base.

Gestão, Segurança e Armazenamento. É a base para a começarmos. E aí sim, a trazemos os dados e escolhemos qual é o melhor serviço. Qual a melhor maneira de trazer os dados que vocês tenham de acordo com a necessidade de requisitos do que vocês têm, para dentro do S3. E uma vez que os dados estejam lá, entramos com o catálogo para fazer esse mapeamento, para disponibilizar. Então deixaremos padronizado para que essas aplicações possam consumir. E pegando o gancho que o Jackson trouxe da LGPD, Caso vocês tenham a própria LGPD, ou algum outro requisito de conformidade, vocês

poderiam utilizar também. Ou o Macie. Porque o Macie é um serviço em que você anonimiza os dados. Ele consegue identificar dados sensíveis que vocês tenham armazenados. Então vocês conseguiriam anonimizar antes mesmo de armazenar. Já é uma forma de ajudar a conseguir estar aderente a algumas conformidades, alguns requisitos de segurança que vocês venham a ter. E aí sim, começamos a prover a ferramenta, O serviço necessário, de acordo com cada perfil que vocês tenham. Serviços para quem vai precisar de ferramenta de BI, para quem vai precisar de um dashboard, para quem vai precisar pegar aquele resultado e

fazer o input em outros sistemas, para dar evolução em alguma esteira, enfim. Aí é de acordo com... "O céu é o limite", eu costumo brincar. Até aí vamos criando em cima de várias tecnologias. E um passo, também, do que estamos falando aqui: Os dados estão ali, estamos consumido e queremos agregar valor para o usuário final, para o cidadão Ou para a área de produto de vocês de negócio. Ou seja, a disponibilidade dessa informação é muito importante, porque se um dado não chegou no momento que precisa chegar... vamos pensar em alguma coisa em tempo real, com

uma SLA para ser cumprida - ele perde o valor. Então, temos que estar preocupados, também com a saúde do backend do nosso sistema, nossas aplicações. Se ele conseguirá entregar no momento em que é esperado que aquela informação chegue. Pra isso precisamos pensar, então, em log, métricas e rastreabilidade dessa informação. Por que? A rastreabilidade para que saibamos de onde veio a request, para a onde ela está indo, como ela foi feita. Caso tenhamos algum problema, detecção de algum erro ou aluma lentidão, fique fácil saber que foi essa aplicação A que chamou a aplicação B... Conseguimos entender

onde está a lentidão ou o problema que venha a acontecer. E as métricas e os logs. Por quê? Porque, como é que teremos certeza de que aquilo é lentidão? Como é que a gente sabe que aquilo não é um comportamento normal? Não é o esperado da nossa aplicação. Então as métricas entram aí. Precisamos entender qual é o comportamento que a gente quer que tenha, ou seja "na minha aplicação, esse dado tem que estar disponível em 5 segundos!" Então, é só um exemplo de métrica. Qual o KPI que a gente quer alcançar? Para sabermos, caso alguma

coisa ali esteja fora desse padrão, vamos analisar melhor. Vamos entender o que está acontecendo ali, e os logs para ajudar a construir tudo isso. Uma aplicação tem que ter um log Para a gente saber se ela está normal, se ela está com a taxa de frequência, de erro. Imagine você, sem querer, colocar um endpoint como um "s" que não devia. Vai tomar erro, e a gente precisa ter os logs para a entender. E esses três pilares aqui: log, métrica e rastreabilidade. Podemos dizer, então, que estamos trabalhando a observabilidade das aplicações. Quais são exemplos de observabilidade?

Por que ela é importante? Ela ajuda a entendemos se a nossa aplicação está saudável, teremos a noção se ela está bem, E ter mecanismos para prevenir e corrigir, também. Então, precisamos ter a monitoração ponta a ponta dessa nossa aplicação, igual ao que comentei sobre as request. Onde ela começa? Qual o comportamento esperado e onde ela termina? Precisamos ter isso não só para uma API, uma requisição, uma coisa assim. Não. Precisamos trabalhá-la como um todo. Então, mesmo as aplicações modernas: microsserviço, container, no legado que temos, é importante ter toda essa rastreabilidade e centralizar isso em alguma

ferramenta. E aí podemos usar os DEM, Digital Export Monitoring, Ou seja, ferramentas digitais de monitoramento para facilitar essa gestão. Teremos, então, algum lugar para centralizar toda essa informação, toda esse log, toda essa métrica, para gerar esses insights. Porque, imagine: você tem um erro ou uma lentidão, um Erro 500, enfim. Vai ficar olhando em dez pastas diferentes? pastinhas de log lá, em que salvou o arquivo? Não, não vai dar certo. Demora mais para a achar o arquivo correto do que para a corrigir esse Erro 500 Que tomamos e tirar o "s" ali. Então, precisamos centralizar, de

uma maneira fácil para a enxergar isso, ferramentas para avaliar. E por quê? Porque assim conseguimos ajudar a cumprir os SLAs e os SLOs. O que seriam os SLOs? Quando vamos lá e falamos com nosso cliente: “eu te atendo em três dias”, por exemplo. Vamos supor que vocês tenham um SLA de três dias. Internamente, não podemos demorar três dias. Temos que demorar menos, do contrário, não conseguimos entregar o que falamos para o cliente. Esse seria o SLO. Temos que entregar em tempo menor. Teríamos um SLA de dois dias, por exemplo. Então, precisamos ter essas ferramentas para

acompanhar isso. E aí, no caso de AIOps... O que seria isso? Se estamos falando de tecnologia de melhorar e trazer eficiência, por que não utilizar a inteligência artificial para ajudar a corrigir? Então tem muitos erros, muitas coisas que podem acontecer, que são passíveis de correção automática. Não precisamos ir lá. Detectou? Roda algum script que você já tem, E já deixa programado automaticamente. A IA já vai pegar e vai entender que aquilo é um comportamento normal e vai corrigir para você antes mesmo que você tenha, ou seja, onerado. Ou seu usuário final, e se perca o

valor desses dados, porque passou 10 segundos, 5 segundos do tempo que precisava. E aí temos as ferramentas, também, para a ajudá-los na observabilidade e de forma gerenciada, para que vocês não precisem ficar pensando: "Vou instalar, vou subir o servidor. Como farei tudo isso?" Sem complexidade. Mas também é bem famoso. Muita gente gosta das coisas opensource. Temos o Grafana, o Prometheus, e está tudo bem. A AWS contribui com a comunidade opensource. Então, se vocês já utilizam, também é possível manter a observabilidade, usar para rastrear e fazer o monitoramento com esses serviços e utilizar a parte gerenciada

da AWS, como por exemplo, no caso do Grafana e do Prometheus, temos o Amazon para o Grafana, que já é gerenciado também. Ou se vocês falam assim: "Ah! Mas eu não uso esses. Eu tenho cada aplicação!" Quem nunca? Quem é de TI já deve ter visto cada aplicação, cada cenário. Tem uma ferramenta, tem um log, depende de quando foi feito, enfim. "Mas eu não uso nenhum desses. Terei de ficar instalando agente para coletar métricas, para fazer tudo isso?" "Nossa, eu queria padronizar, tem que trocar tudo?" Não. Dependendo do que vocês utilizarem, dependendo dos requisitos que

estão na aplicação de vocês, é possível com o Open Telemetry, que é um projeto opensource também, que funciona como integrador dessas aplicações. Então, com um único agente, você consegue capturar os logs de todas as aplicações e mandar essas métricas, esses logs para diversos serviços de monitoramento. Também é um caso legal que daria para a pensarmos. E aí, legal. Dei um overview bem macro, correndo com o tempo para a sobrar para o Bruno mostrar para vocês, que eu sei que todo mundo quer ver a Console, mas antes de ir para a Console, vou falar o que

ele vai fazer aqui na demo. Falamos de gestão inteligente, estamos falando da importância dos dados para uma cidade, para que não olhemos para a um ponto só, e tenhamos visão 360º dessas cidades, gerando insights. O que pensamos aqui na historinha fictícia da nossa demo, Para a mostrar para vocês como isso tudo se junta? Teremos uma cidade, e suponhamos que temos uma cidade litorânea, diversas praias. Suponhamos que praia é um bairro, só para ficar bonitinho. Várias praias. E desejemos saber, aí. Temos aqui dados vindo de sistemas, que estão aqui. No nosso caso, usamos só hipoteticamente. Até

deixei amarelinho ali, para mostrar o AWS DNS. Ele é um serviço de migração de banco de dados. Então, vocês poderiam pegar dados de bancos heterogêneos ou homogêneos e trazer aqui para dentro. Por isso que ele está ali. E aí vocês poderiam trazer os dados aqui da nossa cidade. Dados de infraestrutura, dados populacionais, todos espalhados, cada um com um departamento, uma secretaria, enfim. E queremos ver o que dá para fazer de gestão inteligente, para prover recursos melhores às pessoas que estão ali, que habitam a cidade. O que vamos fazer? Vamos partir do princípio, de que já

fizemos a migração. Já trouxemos esses dados, eles estão no S3, armazenados no nosso bucket. E aqui no caso, Haverá um bucket do Amazon S3 que chamamos de raw. O que é raw? Quando estou trabalhando com data lake. Esse é um termo para a dizer que o dado está cru, ou seja, só mapeamos o dado e colocamos no storage. Ele está cru, não tem nenhuma mexida, não foi transformado, não tem limpeza. Está do jeito que ele veio. Esse é o primeiro passo. Aí traremos esses relatórios diversos da nossa cidade litorânea. Vamos rodar a AWS Glue, porque

ele é um integrador. [aplausos] Vou esperar o pessoal... Eu aplaudo! Vamos rodar aqui no AWS Glue. Porque o Glue vai criar aquele catálogo para nós. Vamos rodar... Dentro do Glue, tem o crawler, que é um outro termo também, que vocês vão ouvir bastante em data lake, não sei se todos aqui trabalham com isso. O que o crawler vai fazer? Ele vai olhar lá dentro e vai falar: "Opa! Este é um dado que eu tenho. Vou mapear, vou colocar aqui... Olha, tenho o campo 'nome'. Eu tenho o campo, que é um string. Eu tenho um campo

'idade'..." Ele vai mapear para a gente. É aí no nosso... [aplausos] Não atrapalhar o pessoal. E aí, o que fazemos então? Temos aqui... Veio o dado cru. Do jeito que ele está. Fazemos um primeiro processo para mapear o que temos para selecionar. Por que colocamos outro S3 aqui, chamado de Analytics. Porque nem tudo que vem, é o que precisamos. Tem dentro... Imagina quantos relatórios? Vem muita... vou chamar aqui de "sujeira". Então não precisamos analisar tudo isso, rodar query em cima de tudo isso. Para quê? Então, aqui selecionamos... -O Bruno vai mostrar. - os dados que

queremos, e jogamos para um armazenamento que vamos chamar de Analytics, no nosso caso, que é o dado limpo. É aí sim, que vamos usar para extrair os insights que queremos. E aí, em seguida, ele vai rodar aqui o Amazon Athena, Que é uma ferramenta para fazemos queries em cima desses dados em serverless. Então vocês não precisam subir nada, não precisam instalar nada. Para rodar um Select, por exemplo, e ver o que tem lá dentro para a tirar, fazer umas queries simples aqui, um count... para começar a entender o que está lá dentro. Por fim, vamos

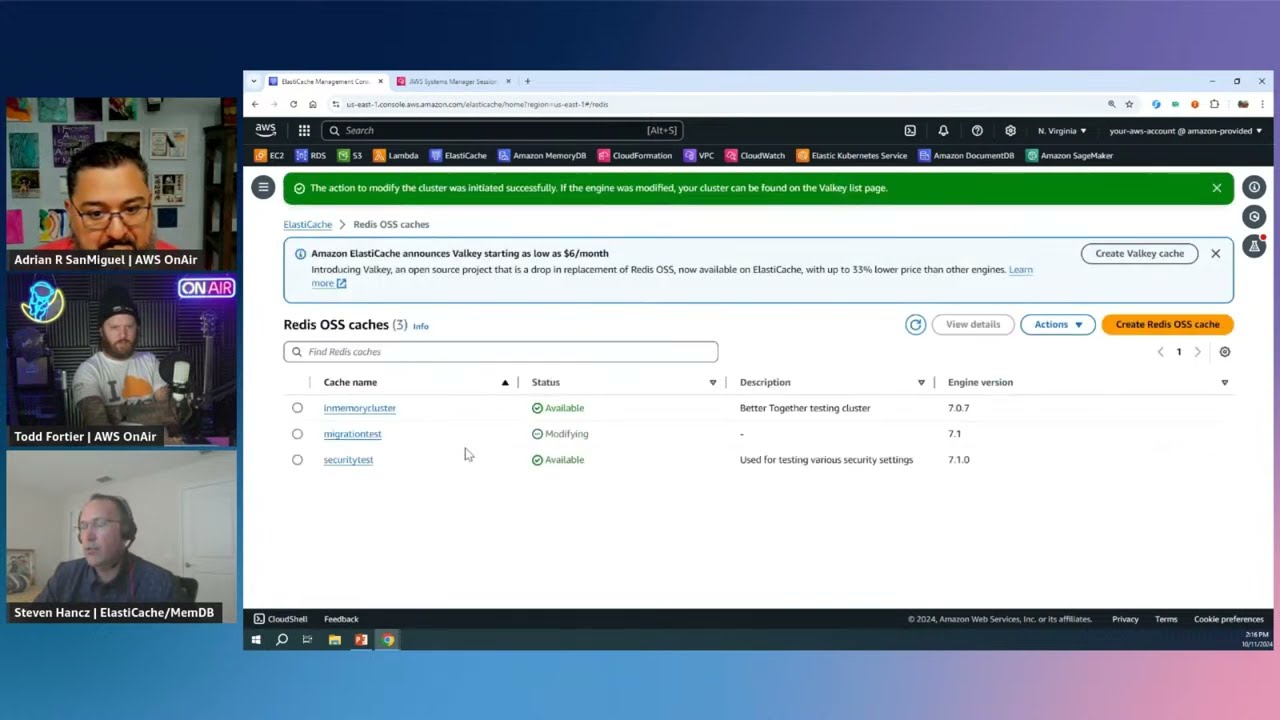

mostrar ao nosso usuário final aqui no nosso caso. Usando o Amazon QuickSight, qual a informação. E ver, o relatório, conseguir cruzar esses dados diversos para a saber qual é a melhor solução para a nossa cidade litorânea, pensando numa gestão eficiente. Isso aqui é só para a dar um overview para a vocês do que o Bruno vai fazer. Agora a parte legal, ele vai para a Console. Isso é. Está ouvindo minha voz bem? Está com chiado aí? Está legal? Obrigado. O primeiro desafio da demo aqui é trocar a tela. Bom, pessoal, essa aqui a interface do

S3. A ideia aqui, que os dados que já temos, como a Ariane comentou com vocês, esses dados já estão na S3, então são arquivos mesmo. Podemos ver que são arquivos CSV, então temos dados de bairro, Temos dados aqui de infraestrutura, de urbanismo dessa cidade fictícia que estamos trabalhando aqui. Dados da população, da demografia, quantidade de moradores, faixas de idade de moradores. Então, a ideia é de começar a criar, junto com vocês, o passo a passo para criarmos esse data lake, esse ambiente de Analytics. O primeiro passo, a Ariane já comentou com vocês, que é criar

o crawler. Então vamos aqui na Console. O o crawler faz a criação do catálogo. Ele vai pegar o metadado técnico do seu dado e criá-lo. Vou pegar aqui um bucket, aquele bucket que estava mostrando para vocês, que tem bairro, escola e infra. Seleciono-o aqui. Vou dar o anexo, escolher qualquer role como a Ariane comentou, que é a nossa credencial de segurança e acesso, e escolhemos o database aqui. Vou colocar esse num database demo. E pronto! Fizemos nosso crawler. Vou colocá-lo para rodar aqui. Enquanto eu falo um pouquinho mais dele. Só um minuto. Coloquei-o para rodar.

O que crawler fará? Ele virá a esses arquivos CSV e fará uma inferência. Olhará coluna a coluna do arquivo e fará uma inferência. Essa coluna é uma string? Ela é um texto? Ela é um numérico? É um inteiro? Então o crowler faz esse trabalho para a gente, essa análise. Ele já cria esse catálogo que acaba sendo um lugar central, que usamos para fazer integração com diversas ferramentas. Vou mostrar a vocês aqui, o próprio Athena. Então, a ideia é que... Ele está rodando o crawler ali. Mas eu tenho um outro banco. Deixe-me abrir. Somente dados. Tem

um exemplo desses dados aqui. O que o crawler fará? Ele pegará aquele arquivo de bairro, por exemplo, e identifica que o campo de código é o campo begint. Então ele fez isso fazendo inferência no arquivo. Ele vai no nome do nome de bairro, identifica com uma string e com isso ele torna para a gente isso aqui, uma maneira de você poder trabalhar e realizar as queries em cima desses dados. Já fizemos uma query em cima do arquivo de bairro. Então, aqui eu tenho um código de bairro, o nome do bairro, a quantidade de visitantes, Que,

nesse caso, cada bairro, pra gente, é uma praia. Então a quantidade de visitantes por bairro, a faixa de idade, alguns dados do bairro. Também tenho dados da infra. Então vinho aqui e faço uma query em infra. Tenho dados da infra também, o percentual de ruas iluminadas para aquele bairro. Vejam que aqui, já nem tem nome de bairro. Eu tenho um código de bairro que está atribuído a um bairro. Deixe-me voltar aqui ver se nosso crawler terminou de rodar... Ele já terminou de rodar. Então, se formos naquele database que escolhemos, anterior, que é esse Demo Summit...

Vou dar um refresh aqui. Ele já fez o trabalho daqueles arquivos que estão lá no S3 pra gente. Então, já que tem aqui todas as inscrições do S3, então esse seria nosso primeiro passo. Mas qual é o próximo passo? O próximo passo é olhar um pouco pra esse bairro aqui e começar a fazer umas análises dos dados. Então eu estou vendo aqui dados de infraestrutura e de bairro. Mas será que eu consigo Fazer uma correlação entre os dois e olhar os visitantes por bairro, ver se o visitante por bairro pode estar relacionado ao urbanismo daquele

bairro. A ideia é trabalhar um pouco disso. Então, vamos usar uma outra ferramenta, que é o Glue Studio. Vou abrir aqui para vocês. Primeiro, vou remover o que ele cria aqui. Mas o Glue é uma ferramenta visual que te permite fazer esses tipos de análise, fazer ETLs, fazer toda essa preparação do dado para você depois poder tomar algum tipo de decisão baseada nesse dado. Então vou escolher aquele que colocamos aqui. Ele já tem uma caixinha do próprio catálogo, então vou lá no nosso database e escolho a nossa tabela de bairros. E ele já traz o

esquema de bairros. Então ele fala, nessa tabela de bairros, eu tenho o código de bairro, nome de bairro, a quantidade de visitantes. Isso já está trazendo data tag da própria coluna. Vou trazer mais um dado aqui. Vamos pegar mais um dado lá, vamos pegar um dado de infra, vou escolher lá, de novo, nosso database. Escolho infra e ele vai fazer a mesma coisa pra gente. Ele traz os dados de código de bairro, Ruas iluminadas, percentual de ruas iluminadas, o percentual de saneamento básico. Então ele trouxe, praticamente de forma automática, sem fazer nenhum tipo de código.

Vou mudar aqui para ficar um pouco mais claro, para fazermos um desenho, colocar esse nome aqui também de bairros. Agora, é juntar essas informações e começar a analisar. Será que faz sentido bairro versus infra? E como fazemos isso aqui? De uma maneira também bem fácil. Vamos escolher aqui uma transform do Glue, que é uma ferramenta onde você pode fazer... E tem vários tipos de transforms. Eu estou pegando a de join, mas você tem transforms de drop, de seleção de arquivos, renomear arquivos, isso tudo de uma maneira visual. Vou nele aqui e vou adicionar nele o

meu campo, a minha outra tabela de infra. E eu preciso passar pra ele. Mas qual é minha condição de join? Então vou lá pegar o meu código de bairro. E vimos que na tabela de infra tem um código de bairros também vou adicioná-la no código de bairro, e ele já vai gerar um output para você com a junção das duas tabelas. Então podemos ver que tem dados de bairro e dados sobre urbanismo. Qual é o próximo passo? O próximo passo é fazemos um pouco do que a Ariane comentou com vocês, que é gerar esse dado

numa outra camada. Então vou escolher um target aqui e colocar esse dado trabalhado num S3 que demos o nome de Analytics. Não é preciso levar todo aquele dado que colocamos no raw, mas vou trazer só o que preparamos para fazer essa análise. Então, o primeiro passo é escolher o formato do arquivo. Vou colocar o formato Parquet porque ele é um formato colunar, bem comum de se usar em ambientes de data lake. Eu preciso escolher qual que é meu bucket. Então vou escolher aquele bucket de Analytics que a Ariane comentou. Vou dar só um nome, para

uma pastinha aqui e eu quero que isso crie para nós dentro de um database. Vou escolher um database, dar um nome para a nossa tabela e eu só preciso vir aqui agora dar o nome para o nosso job e escolher a role que ele vai executar. Vou dar um "save"... E a gente já tem aqui o nosso join. Então, o próximo passo aqui é rodar esse join. É só colocá-lo para rodar. Então, de uma maneira totalmente visual, Basicamente, sem fazer nenhum código. O que fizemos aqui só foi fazer escolher os campos que queremos, os campos

do join, e conseguimos montar um relatório e ele vai nos gerar no final, uma tabela só com os campos. E é própria para fazermos as análises. A vantagem do Glue, também, se, eventualmente, o seu time tem interesse em evoluir o código, com o código também, o Glue já gera esse script para você. Então, tudo o que a gente fez, visual, ele vai gerando esse script no formato Spark. O Spark é um tipo de engine de processamento de dados Que permite, no nosso caso, em que estamos começando com um volume pequeno, mas ele escala para um

grande volume de dados, então você pode processar milhões de registros. Ele tem essa vantagem de poder escalar de uma maneira bem fácil. E o Glue você só paga pelo que você vai usar. Então é uma maneira bem interessante de iniciar o seu da data lake trabalhando com ferramenta server sem ter que provisionar toda uma infra para isso. Ele está rodando aqui, e só mais um minutinho enquanto ele vai rodando. Tem um exemplo aqui no outro database de como que fica a tabela. Vou abrir aqui esse caso de um nome de Dados Summit. Mas aí ele

gera uma tabela juntando os dois arquivos. Então eu tenho aqui tanto dados do próprio bairro também como dados também de urbanismo. De modo totalmente visual, a gente conseguiu fazer esse join. Essa é a vantagem de uma ferramenta que a gente acha muito interessante, especialmente se você tem um time, e você está começando. Você não quer investir em time muito grande de Analytics pra começar o desenvolvimento. Você pode ir crescendo da maneira que for necessária para o seu time ou para o seu município, no caso aqui ou pra sua instituição. Só você acabou aqui ele já

acabou. Acabou. Então, se a gente voltar lá no nosso database do Demo Summit, Veremos que ele criou mais uma tabela lá que colocou como Demo Summit, mesmo nome. Ela aqui possui os dados dos dois arquivos. Então qual é o próximo passo? Agora temos um dado um pouco mais estruturado. O próximo passo de tentar tirar um insight visual. E como que fazemos isso? A AWS tem uma ferramenta que se chama QuickSight. Ele é uma ferramenta com a qual se conseguem construir testes de painéis E publicar esses testes também dentro de seu da sua empresa, sua instituição

do seu município, de uma maneira bem rápida. E ele também tem conexão diretamente com o S3 e com o Athena. Então o que vamos fazer agora? Vamos dar um nome aqui para uma fonte de dados nova. Vamos criar uma fonte de dados nova, vamos procurar lá a nossa tabela. Vamos selecioná-la aqui. E vou importar para dentro do que sai do QuickSight. O QuickSight tem uma funcionalidade que se chama Spice, em que você pode trabalhar tanto rodando as queries diretamente no Athena ou um banco de dados. Ele se conecta a vários bancos, como Redshift, Aurora, o

banco de dados que for, no caso, vocês tiverem na sua empresa também. Ou você tem uma opção de trazer isso aqui... Ele já fez a importação está 100%. ...trazer esse dado para esse formato spice. Ele é um formato em memória do QuickSight. Vamos ver aqui. Montar o relatório, que ele faz isso instantaneamente. Então vamos começar a fazer umas análises desse case que a Ariane comentou. Então vamos olhar pra nossa cidade. É uma cidade litorânea. E quantos visitantes ela recebe? Basta que eu clique em visitantes, e ele já vai fazer o cálculo pra gente. A cidade

recebe 133 mil visitantes, então é um número razoável. E o o QuickSight tem uma funcionalidade também, que é o que está selecionado aqui, uma marquinha aqui. Esse item aqui já sugere alguns relatórios para você, praticamente, não tive que fazer nada. Ele já sugeriu essa métrica, que seria um indicador para a gente. E aí começamos aqui a trabalhar com dados e possivelmente tirar alguns insights. Então vamos começar a olhar também pelo que comentamos: Como que está o urbanismo e a infra dessa cidade? Então, vamos olhar a quantidade de restaurantes. Ele também já gera mais indicadores. Só

vou colocar aqui do lado, e aí vamos para próximo. Será que a rede hoteleira está adequada? Vamos começar a olhar a quantidade de hotéis e ele já vai gerando para vocês todos os indicadores. Isso de uma maneira totalmente visual. E aí eu quero olhar. Mas como é que essa cidade está em termos de urbanismo? Vamos olhar o percentual de ruas iluminadas dessa cidade. Vou mudar a métrica pra ele mudar pra média. E aí percebemos que essa cidade tem 63% das ruas iluminadas. De repente, aqui há potencial de melhora ou algo do tipo. Isso vai estar

de acordo com cada município. E aí vamos olhar um pouco também para saneamento básico. Vou mudar a forma dele agregar. Eu também olho aqui e percebo que ele já está tem 68% da cidade com saneamento básico. Vou colocar isso aqui aqui pra cima, puxar pra cá. Já começamos a montar de modo bem visual, esses indicadores. Isso permite pensar nos dados da cidade e tomar algumas decisões. E a partimos de dados brutos. E agora, próxima análise que eu queria de fazer, vamos começar a olhar para os visitantes. Quem são esses visitantes? Então, se eu vir aqui

e selecionar visitantes e selecionar a faixa de idade, por exemplo, eu começo a ter um outro gráfico. Quem são esses caras? Nota-se que 60% dos visitantes está acima de 30 anos. Então, olhando aqui de 30 a 50 e acima de 50. E também tem um público muito grande de crianças de 1 a 15 anos. Será que isso está relacionado com a nossa infra? Vamos colocar isso aqui de lado e começar a dar uma olhada também. Agora olhar num prisma mais do bairro. Então, a primeira coisa que vamos fazer, é olhar o bairro e a quantidade

de visitantes. Será que tem mais visitantes por bairro? E o que conseguimos ver aqui é que tanto a Praia dois como a Praia cinco têm um número muito maior de visitantes que as outras praias. Será que isso está relacionado com a infraestrutura da praia ou algo do tipo? Vamos também fazer esse tipo de análise aqui. Vou só puxá-lo para cá. Vamos pegar de novo os bairros e colocar todos os indicadores Que a gente fez ali em cima de um prisma de cidade. Mas, olhando agora por bairro. Vou mudar aqui pra média, Aqui para média também.

Só mudar aqui e ajustar aqui um pouco. O que podemos olhar aqui, que realmente são as estatísticas. [aplausos] Aqui é soma. Soma e saneamento básico médio. O que podemos analisar aqui é que realmente, tanto a Praia Dois como a Praia Cinco. Elas têm uma quantidade maior de hotéis e restaurantes, têm um percentual maior de ruas iluminadas E também saneamento básico. Será que isso aqui é um motivo ou não de se ter uma maior procura de visitantes nessa região? Esse é um insight que, basicamente, a gente fez com alguns cliques. Só vou salvar o dash aqui,

com alguns cliques, e que possibilita tomarmos alguns tipos de decisões. Isso de uma maneira bem rápida, sem ter que fazer um grande desenvolvimento. Você só publicar aqui e dar o nome do painel. Publicamos aqui sem ter que fazer um grande desenvolvimento. E com isso podemos pensar em outros outros aspectos, não só em termos de saneamento básico, iluminação. Mas será que essas praias aqui também? Eu não posso incentivar um pouco mais o comércio local, a criação de mais hotéis, mais restaurantes? Porque imagina um turista que está aqui na Praia Seis. Aqui, por exemplo.6. Tem uma infra

ruim, tem poucos restaurantes. O turista tem que ficar se deslocando para uma Praia Cinco ou Praia Dois. Acaba não sendo uma experiência muito legal. Já é um pouco do que comentamos ali no início. Exatamente! Obrigado, Bruno. Como falamos no início de Cidades Inteligentes, Como uma junção entre políticas públicas e iniciativa privada. O Bruno mostrou aqui, rapidamente. Vimos que as Praias Um e Dois têm mais hotéis, mas os turistas também estão indo para Praias Seis, Três, Quatro. O tempo... Qual é o tempo que eles gastam pra se deslocar de uma praia para outra? Muito provavelmente, eles

estão indo da Praia Um e Dois pra Praias Três e Quatro. Eles estão gastando um tempo nesse deslocamento. O tempo que eles gastam nesse deslocamento poderia ser um tempo em que curtiriam uma praia, comprando uma água de coco, Gerando impostos para o município, girando a economia daquelas praias. Será que o prefeito poderia montar uma política de apoio à criação de novos hotéis nessas praias? Será que conseguiríamos fazer parcerias com a Etec? Com as escolas locais para criar cursos de garçons, cursos de hotelaria, melhorar a infraestrutura dessas outras praças que também estão sendo visitadas, para que

o turista consiga ir pra praia quatro e ficar lá uma noite, consiga comer lá... Então, dessa visão que tivemos, as ferramentas que o Bruno mostrou, já se conseguem tirar decisões muito práticas, Que envolverão polos de desenvolvimento econômico, como falamos, criação de polos naquelas praias, ecossistemas e plataformas de colaboração, melhoria de vida para o turista, melhoria de vida para as pessoas dessas praias que terão ali restaurantes, hotéis para trabalhar, e melhoria para nós que poderíamos ir lá tomar água de coco, passar o dia inteiro na praia sem ter que nos deslocar para onde tem mais hotéis.

Com certeza, você pode só voltar aqui para a gente? E tudo isso, fizemos aqui, de uma maneira bem rápida. Gastamos uns dez minutos para montar nossa parte da demo. E é um potencial também de poder trazer mais insighs. Então podemos, sim. Pegamos duas bases ali. Imagina um município, a quantidade de bases que tem. O que daria para começarmos a analisar e só a maneira totalmente visual. Não tem um gasto tão alto de custo de desenvolvimento. Exatamente aí fazemos uma pergunta: Vocês acham que isso é uma Cidade Inteligente? Ter esse tipo de insight para melhoria de

vida do cidadão. Acha que é um caminho para Cidades Inteligentes? Muito bom. A gente tá com a mesma opinião. Maravilha! Só complementando células, hein? Vocês viram que está... A cidade não precisa, já está super modernizada, já que você começou a ter a IoT para começarmos a abordar a Cidade Inteligente, podemos começar com o que temos. E ir evoluindo conforme o tempo, então a vantagem do cérebro. A vantagem é que começamos a usar... O Bruno mostrou rapidinho, - monta-se, e conforme se vai ganhando expertise, vai-se plugando outros serviços e outras ferramentas até chegar a Queries BI

Analytics. E então você pode evoluir aos poucos. Sim, já pensar num modelo de Machine Learning Logo de início, ou algo mais complexo, que pode demorar mais tempo para implementação. Bom, pessoal, aqui estou deixando também para vocês dois QR Codes. Esse primeiro aqui, é para uma série de cursos. Temos em um site que se chama Skill Builder AWS. Tem mais de 500 cursos gratuitos, então vai ter das ferramentas que eu mostrei para vocês aqui hoje e também de outras ferramentas AWS. Então, se estiver interessante para vocês, podem vir aqui e acessar. Fazer o cadastro é bem

tranquilo. E também a AWS tem uma trilha de certificações Para você que está pensando em se tornar um especialista no AWS, então é uma trilha bem definida. A AWS tem trilha voltada para desenvolvimento, área de Analytics... E aqui também estou deixando o QR Code para vocês. Caso tenham interesse, é só acessar aqui. Eu queria agradecer a todos. Muito obrigado pelo tempo de vocês. Foi muito bom podemos preparar esse material e participar aqui, compartilhar com vocês. E muito obrigado mesmo o pessoal. [aplausos]