hola amigos yo soy álvaro felipe y hoy quiero hablarles acerca de big dada para eso quiero contarles una pequeña historia el es carlos tres panaderos hace pan hace buen pan entonces le va bien tiene buenos clientes sin embargo él quiere que su negocio crezca así que como todo buen emprendedor empieza a leer sobre marketing sobre negocios sobre gestión lo que todo buen emprendedor debería hacer leer todos los días así que de esta manera él comprende que debería guardar los datos de sus clientes para poder tener mejores relaciones informales cuando hay descuentos ofertas nuevos productos eventos

etcétera ok pero como él no sabe mucho de tecnología los guarda en un documento de texto pero no tienen una estructura para un cliente le pone primero el apellido luego el nombre al siguiente cliente le pone primero el nombre luego el apellido a otro cliente le pone primero el correo luego el apellido luego la fecha de nacimiento todo es un desorden mayúsculas minúsculas una locura pronto él mismo se da cuenta de que esto no es eficiente demora mucho en encontrar una información porque todo está desordenado así que leyendo se entera que es mejor todo esto

en una hoja de cálculo porque ahí ya hay un orden hay filas y columnas entonces en la columna uno pone el nombre en la columna dos el apellido en la columna tres el teléfono celular etcétera todo está mucho mejor pero un día conoce a un señor llamado alexis losada ya le siendo sala le dice esto no es una base de datos esto es una hoja de cálculo tú necesitas una base de datos carlos entonces carlos le dice hoy el éxito yo he escuchado que access es una base de datos entonces nuevo mis datos access y

alexis se enoja muchísimo peor y le dice access no es una base de datos tú necesitas una base de datos yo me encargo entonces alexis diseña una base de datos que lo pone feliz y también pone feliz a carlos obviamente mejórate alexis hay bastantes bases de datos esperándote entonces carlos ya tiene sus bases de datos pero pronto se da cuenta que la información viene de muchos lugares aparte de esta base de datos los correos electrónicos que comparte con sus clientes los mensajes que envía y recibe por las redes sociales la información de sus ventas la

información de lo que le paga a sus empleados la contabilidad en general no los datos de sus proveedores que proveedores tiene qué productos le traen cuánto les paga en qué fechas vienen qué créditos tiene etcétera la información de analíticas de su sitio web cuántas visitas tiene cuánto tiempo se quedan de donde lo están visitando cómo llegan a su sitio la información de su inventario la información de los registros de su negocio una gran cantidad de información que hace que en algún momento carlos se quede así sin saber qué hacer con tanta información ahora carlos es

un pequeño empresario y está sintiendo que hay mucha información pero también se da cuenta que si él fuera capaz de centralizar toda esa información que viene de diferentes fuentes y trabajarla como una sola información es decir saber que este cliente que me escribió por facebook es este con el que tuve conversaciones por el correo electrónico y es este que tengo en la base de datos que me ha comprado este y este producto de esa manera puedo definir el comportamiento de este cliente pero obviamente están todos los datos por diferentes lugares y es muy complejo ahora

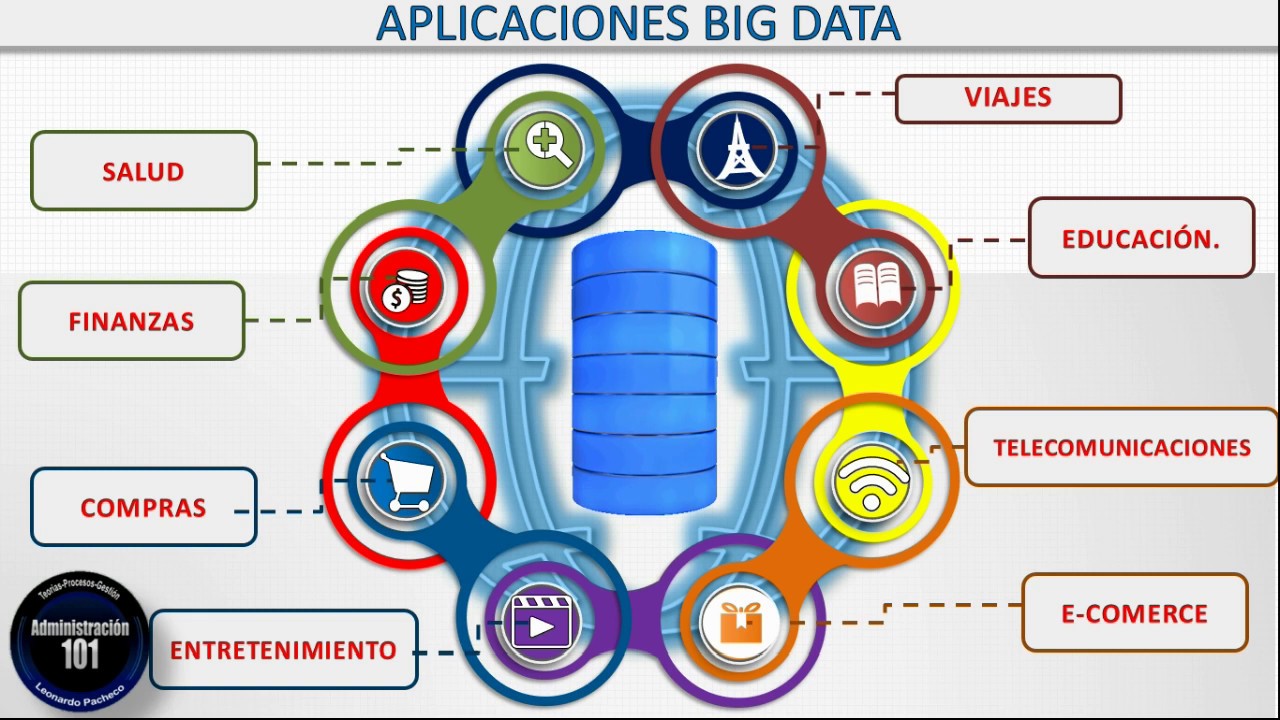

imagínate el reto que tiene que asumir una gran empresa un banco una cadena de supermercados una tienda por departamentos que tienen locales en varios países una empresa de software con clientes a nivel mundial una empresa de telecomunicaciones etcétera cuánta información ellos manejarán enormes cantidades de información que también están repartidos por distintos lugares esta es la esencia del big data antes de explicarte que es big data de manera técnica hablemos de la terminología de esas palabras que vas a escuchar en el mundillo del big data y es bueno que tú las conozcas en primer lugar los

datos no estructurados son aquellos que no tienen una estructura definida como carlos poniendo los datos de sus clientes en un documento de texto y poniéndolos como caigan no tienen una estructura sin embargo igual son datos iguales información importante tú dirás sí pero tú pusiste el ejemplo de carlos porque l era un principiante de la tecnología nosotros no lo vamos a hacer nosotros siempre estructuramos nuestra información falso cuando envías un correo electrónico el cuerpo de ese correo es un son datos no estructurados a pesar de que haya información muy importante hay documentos de texto conversaciones por

slack toda la información que guardas en tu sistema de gestión de proyectos ya sea sana reloj de ira wright etcétera todos esos datos no estructurados y son datos importantes de tu empresa además tenemos los datos estructurados que son los datos que ya se diseñan como el ejemplo de carlos pasando sus datos hoja de cálculo tenemos luego la base de datos llega alexis y dice tenemos que hacer una base de datos esto es un conjunto organizado de información de datos estructurados y existen los motores de base de datos que es software que permite almacenar procesar y

extraer la información de estas bases de datos también tenemos el término on premise que se usa para referirnos a las empresas que guardan sus datos e infraestructura en local es decir en sus propias oficinas han comprado computadoras servidores racks han hecho el cableado tienen un lugar específico para guardar todos esos datos eso es un premio obviamente en un momento determinado no había otra forma de hacerlo si tú querías guardar información tenías que comprar equipos y ahí guardar la información y ahí procesar esa información sin embargo esto es muy costoso necesitas un espacio físico que es

costoso necesitas comprar los equipos y saber que en determinada cantidad de años estos equipos se vuelven obsoletos y que renovarlo necesitas personal capacitado y especializado para manipular estos equipos es realmente el nuevo modelo es el cloud computing que significa que todos estos servicios de cómputo estén en internet ofrecidos por una empresa las empresas más importantes de cloud computing son amazon con la w s google con disipe y microsoft con asier entonces ya no tenemos que tener esas grandes cantidades de equipos y gastar tanto dinero sino que nuestros datos están almacenados en la nube en la

nube se procesan en la nube hay mucho poder de cómputo un mito muy común de la nube es decir que es la computadora de otra persona y eso es absolutamente falso y quiero dejarlo muy en claro nunca creas eso el cloud computing es un conjunto de servicios de cómputo enormes gigantescos y un conjunto de servicios de cómputo escalables es decir que si se requiere más poder rápidamente puedes escalar un data warehouse es un gran almacén de datos estamos hablando de cantidades extremas de información de petabytes de información un petabyte es 1000 terabytes es decir un

millón de gigabytes imagínate es tremendo tenemos también el machine learning qué es el aprendizaje automático significa que las computadoras sean capaces de aprender a través de patrones y poder detectar nuevos patrones y hacer predicciones es como tener un asistente que está todo el día revisando la información para encontrar datos importantes te pongo un ejemplo imagínate que le damos un millón de fotos de un perro o una computadora y le decimos oye computadora en este millón de fotos hay perros entonces la computadora empieza a aprender con esas fotos de perros y se supone que al final

pues debes saber cómo identificar a un perro en nuevas fotos este millón de fotos es un número completamente aleatorio que me inventado ok pero luego de procesar estas fotos le damos una foto de un gato de un caballo o de un león de un perro o de algunos objetos a ver si la computadora y entendió y ya puede reconocer un perro ese es el principio de machine learning y se puede aplicar a muchísimas áreas no solamente al big data pero que es big data no lo hemos explicado de manera técnica hasta el momento big data

es un gran volumen de información de diferentes fuentes no cuenta una sola fuente por más grande que sea esta fuente tiene que venir de diferentes fuentes con diferentes estructuras ya una velocidad tan rápida de cambio es decir de nuevos datos que van llegando como una gran avalancha de datos que no paran de llegar y al no parar de llegar y de moverse estos datos son casi imposibles de procesar y analizar con los sistemas de cómputo tradicionales es decir necesitamos muchísimo poder de cómputo es decir cloud computing el big data también se puede hacer on premise

con herramientas como hadoop pero actualmente la tendencia sino salas nube porque nos da más poder a menor costo el big data debe cumplir con cinco veces o cinco v es para los amigos de españa' estas cinco veces son las siguientes gran cantidad de información difícil de procesar con los medios tradicionales variabilidad es decir que los datos sean diferentes si todos los datos son de una misma base de datos pues no tiene mucho reto eso simplemente se analiza con de base de datos tradicional pero cuando viene de diversas fuentes ya hablamos de big data pero no

solo que vengan de diversas fuentes la velocidad es importante es decir con qué velocidad cambian estos datos nunca dejan de llegar nuevos datos por ejemplo tu teléfono está rastreando por donde te mueves siempre entonces siempre está generando nueva información aunque tú no la digit es también tenemos la veracidad significa saber qué datos son veraces y qué datos no ejemplos si tenemos una cuenta en redes sociales con un millón de seguidores pero comprados esos datos no nos valen absolutamente de nada para un análisis y también está el valor el valor es saber qué tan pertinente es

esta información para los objetivos que tú estás buscando por ejemplo si yo he de tim y quiero mejorar las ventas usando a big data los datos de geolocalización de mi teléfono no influyen absolutamente en nada entonces no son datos de valor para este análisis seguramente te estarás preguntando si los datos vienen de muchísimos lugares como podemos analizarlos como si fueran una sola fuente para eso tenemos un proceso llamado tele la primera fase es la fase de extracción que es cuando nosotros capturamos los datos de todas esas fuentes y los centralizamos la segunda fase es la

fase de transformación cuando nosotros estandarizamos los datos como han venido de diferentes lugares hay que darles un estándar algo llamado data clean y limpiar los datos para que parezcan de una sola fuente obviamente hay que escribir un modelo un algoritmo para limpiar esos datos aunque también el match in learning nos podría ayudar en esta etapa y luego el log el lotes la carga de la información es decir ya extrajimos los datos ya los limpiamos y ahora hay que cargarlos o guardarlos en un data warehouse para su posterior análisis hasta este momento estamos hablando de datos

muchos datos limpiar los datos analizarlos pero para que has escuchado tal vez esta frase de que los datos son el nuevo petróleo que empresas como google o como facebook hacen millones con nuestros datos si todos lo sabemos pero te has preguntado algún día como como google o como facebook transforman estos datos en dinero está el dato acá y está el dinero acá de que me estoy perdiendo para convertir este dato en dinero bueno hablemos del ciclo de vida de los datos y eso te va a ayudar a entender cómo los datos se transforman en dinero

en primer lugar necesitamos capturar estos datos repito los datos que vienen de diferentes fuentes hay que capturarlos sería la primera etapa de lete el es cierto la extracción en segundo lugar está el almacenamiento se supone que ya se hizo lt l ya capturamos ya transformamos y ya guardamos en un data warehouse ya tenemos los datos guardados ahora viene la fase del procesamiento y el análisis ya tenemos los datos como si fueran una sola fuente limpios y estandarizados ahora toca encontrar patrones estos patrones los podemos buscar de manera predeterminada es decir nosotros definir que estamos buscando

y escribir los modelos los algoritmos para esas búsquedas o podemos apoyarnos en match in learning la diferencia es que machine learning puede encontrar patrones que nosotros ni siquiera imaginábamos que necesitábamos eso es muy chévere y la última parte es la exploración y visualización ya tenemos toda la información hay que mostrarla en un dashboard hay que mostrarlo en un tablero para que los tomadores gerentes de negocios gerentes generales de empresas y autoridades gubernamentales autoridades municipales puedan tomar decisiones con estos datos viendo la información ya procesada ya en tableros en gráficos muy fáciles de entender pero hasta

ahora siguen siendo datos dónde está el dinero ok lo que pasa es que con estos datos tú puedes tomar decisiones estos datos te muestran comportamientos de los usuarios o te muestran tendencias o te predicen el futuro obviamente no pueden predecir el futuro de manera exacta pero las tendencias dicen algo en estadística no entonces podemos saber si las ventas van a subir van a bajar en qué temporada qué tipos de usuarios van a comprar en cierta región geográfica se acuerdan el escándalo de cambridge analytics como ellos pudieron manipular las elecciones simplemente sacando patrones de comportamiento de

los usuarios de facebook terrible ahí es donde está el dinero y las ganancias ahora no solamente para las empresas también para la ciudadanía podríamos analizar datos abiertos el famoso open data y encontrar soluciones por ejemplo soluciones de tráfico o soluciones de seguridad supongamos que podamos analizar el índice de delincuencia en toda la ciudad cruzarlo con las cámaras de vigilancia con las denuncias en comisarías cruzar todos los datos y poder definir en las zonas seguras y las zonas no seguras incluso en horarios del día me imagino una aplicación se me ocurre no una aplicación que te

pueda decir según la hora del día qué zona es segura y qué zona no es segura para transitar y eso se puede hacer con big data obviamente entonces para resumir el big data permite encontrar soluciones para los negocios o para la ciudadanía a través del análisis de grandes volúmenes de informes usando gran capacidad de cómputo principalmente con cloud computing y con machine learning si quieres saber más de big data y métele las manos en la masa' este tema y no simplemente una presentación hablando del panadero y de ejemplos por encima sino meterte a las tripas

del big data entender cómo se analizan los datos y ver realmente cómo se trabaja te invitó este 18 de mayo en ciudad de méxico al edecán méxico 2019 donde manu rodríguez nuestro profesor en cloud computing y customer engineer en temas de cloud para google va a dictar el workshop big data on google es un workshop de tres horas completamente presencial lo vas a tener ahí al experto en cloud para preguntarle todo lo que quieras preguntarle y hacer que tu inscripción valga cada centavo si estás en méxico te invito a ir a méxico ahora mismo para

adquirir tus entradas antes que se agoten y si no estás en mexico te invito a ir a e de puntín diagonal premium para actualizar tu cuenta y tener acceso a las grabaciones y materiales de este workshop nos vemos en mexico