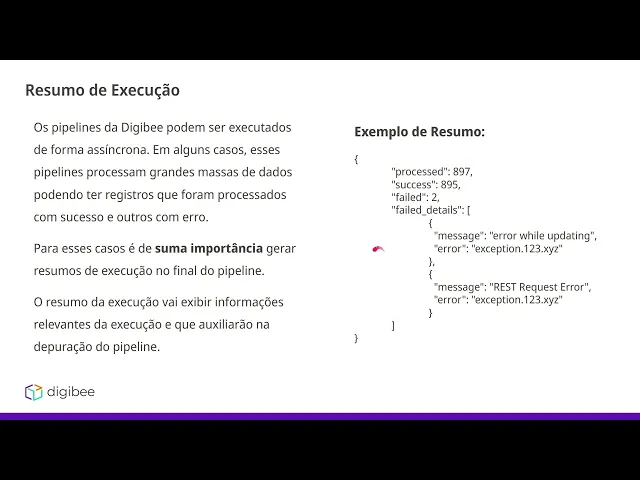

Olá esse é o integration developer bootcamp estamos na etapa de boas práticas de desenvolvimento nesse vídeo falaremos sobre resumos de execução os pipelines da DB podem ser executados de forma assíncrona em alguns casos esses pipelines processam grandes massas de dados podendo ter registros que foram processados com sucesso e outros com erros para esses casos é de suma importância gerar resumos de execução no final do pipeline o resumo da execução vai exibir informações relevantes da execução e que auxiliarão na depuração do pipeline aqui à direita temos um exemplo de resumo temos os quantidade de dados processados

quantos deram sucesso quantos deram falha e principalmente aqueles que deram falha nós temos informações do Porque isso aconteceu mas por que que devemos fazer esse resumo da execução porque quando publicamos um pipeline e saímos do momento de desenvolvimento o que temos de informação sobre alguma execução está na aba de monitoramento e na aba de monitoramento nós temos acesso a três coisas os logs o input e o output do pipeline Isso significa que após uma execução nós temos informações sobre o Jon de entrada do pipeline entregue pelo Trigger o deson de saída do pipeline que é

a última informação que chegou no pipeline e os logs que definimos no momento de desenvolvimento não temos mais toda aquela aba de test mode em que podemos acompanhar Card por Card componente por componente o que estava acontecendo e Justamente por isso quando nós estamos processando diversos dados como 830 dados como no caso anterior entender Quais foram os problemas que causaram dois erros já na saída do pipeline faz toda a diferença no momento de fazer a manutenção ou a depuração porque aqui por conta desse registro de saída nós temos conseguimos bater o olho entendeu onde o

problema aconteceu e porque ele aconteceu agora que entendemos o por fazer devemos entender como fazer para gerar resumos de execução podemos utilizar os componentes como Object Store Cassandra e outros bancos de dados e o session Management e através deles conseguimos armazenar um Jon com informações sobre o sucesso ou erro de um devido processamento enquanto ele acontece e incrementa contadores vamos ver um demo casase vamos imaginar que precisamos criar um pipeline que fará uma migração diária entre um banco de dados e uma p hash para cada registro do banco de dados precisamos Efetuar uma requisição post

passando as informações do registro e durante a execução várias chamadas serão feitas e caso alguma resulte em erro precisaremos ter informações de qual registro retornou erro e por pipeline deve gerar o retorno especificado ao lado então no resumo da execução Ou seja no dião de saída do pipeline devemos ter informações de quantos dados for processados quantos for bem sucedidos e quantas falhas e emo de falhas temos um Array de erro details que demonstra Qual foi o problema e qual foi o registro que resultou em erro vamos acompanhar isso passo a passo primeiramente para entender o

que estava acontecendo nós precisamos entender o demo que é consultar registros de um banco de dados e para cada registro fazer uma consulta em uma p por exemplo então aqui buscamos toda a massa de dados em caso de sucesso em que os dados foram encontrados nós vamos fazer uma iteração desses dados e aqui dentro nós vamos fazer uma chamada hash como no caso a seguir dentro do subfluxo do forit no process fazemos a requisição caso a requisição de sucesso nós continuamos a integração normalmente e aumentamos o Sumário sumarizadas de sucesso agora caso resulte em erro

nós precisamos pegar nesse caminho de saída de erro Qual foi o o o problema o que aconteceu e qual registro deu erro e salvar em uma pilha de erros em uma base temporária qualquer depois que fizemos essa esse gerenciamento de em caso de erros vamos salvar o que aconteceu nós podemos sair do forit Depois de toda a execução de todos os registros e fazer um resumo da execução então o primeiro passo é Nós salvamos o resultado do farit que são sumarizadas de Total sucesso e falha logo depois nós consultamos a pilha de erros para ver

quais foram os erros que aconteceram caso obtiveram nessa execução e nós salvaremos na sessão também essa pilha de erros então no momento já salvamos os sumarizados e já salvamos a pilha de erros caso tenha acontecido aqui agora já podemos del da base temporária esses dados que já foram puxados pra nossa sessão então nós deletamos os erros que foram inseridos nessa execução visto que é uma boa prática fazer uma limpeza uma manutenção visto que esses dados não serão excluídos automaticamente e logo depois da exclusão nós recuperamos todos esses dados que foram salvos e criamos o resumo

da execução O resultado é que na aba de monitoramento no dião de saída teremos algo parecido com esse formato teremos a quantidade de sucessos quantidade de falhas e caso eu tenha falhas nós temos os er os detalhes do das falhas vamos abrir a plataforma entender na prática como isso funciona essa foi a aula de resumo da execução e nos vemos na parte prática para entender na plataforma