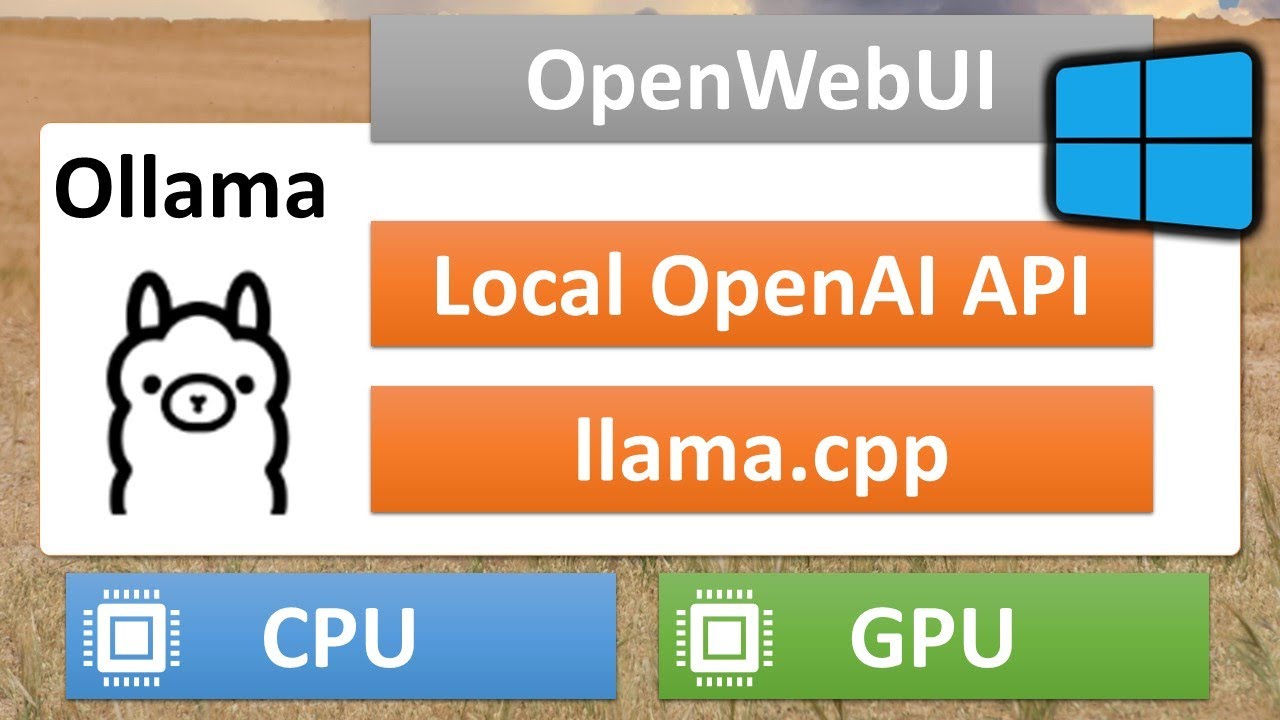

Você já imaginou poder estar instalando aí localmente uma inteligência artificial tanto aí dentro do seu PC ou do seu servidor web onde você não será cobrado absolutamente Por nada é 100% de graça o uso aí dessa Inteligência Artificial Onde você consegue fazer diversas integrações consegue fazer o uso da api bom fica comigo nesse vídeo hoje que irei te mostrar como fazer isso fala pessoal bem-vindo ao can canal de a gestão e hoje a gente vai fazer a instalação do olama bom para quem não sabe o que é o olama o olama é uma inteligência artificial

que a gente instala localmente dentro da nossa máquina beleza e a gente também consegue estar instalando ela aí dentro de uma VPS dentro de um server dedicado enfim o alama ele inicialmente surgiu aí supostamente aí com vazamento aí da Inteligência Artificial aí da Meta que no caso foi o lama do ok E aí através desse vazamento aí de dados conseguiram aí a comunidade tá criando aí eh o olama certo onde a gente consegue est utilizando aí e tanto aí a inteligência artificial da Meta como diversos outros modelos também atualmente a instalação do olama e nos

permite aí fazer dois tipos de instalação que é aí Pelo mac Eos E pelo o Linux o Windows ainda não está disponível o que a gente vai utilizar nesse vídeo hoje vai ser o Linux porque a gente vai estar instalando aí dentro de dentro da nossa máquina Beleza o nosso servidor na nuvem OK pra gente poder estar utilizando aí e a p dela em qualquer lugar e bom qual o diferencial aí do olama dessas outras inteligências que nós já temos hoje em dia como o chat PT né Mistral e outras diversas inteligências que já estão

surgindo aí no mercado bom o diferencial do olama é que dentro dele a gente consegue est utilizando ele aí sem ter que tá tendo custos pelo uso ok a gente consegue tá utilizando ele aí free aí de forma ilimitada Ok e bom como eu falei anteriormente o olama ele traz pra gente aqui certo diversos modelos de linguagem além do lama 2 ok que é o modelo da Meta beleza ele traz pra gente aqui o lava o Mistral certo e muitos outros modelos aí que a comunidade mesmo foi criando Ok e o alama 2 o alama

também ele nos permite aí tá criando o nosso próprio modelo Ok e tá subindo aí dentro do olama Ou seja você mesmo Criar o seu modelo de linguagem dentro do olama com os parâmetros tudo que ele precisa para poder est trabalhando com ela isso daí é muito interessante também que eu ainda não explorei mas quero tá es florando e tá trazendo pro meu feedback aqui para vocês ok e bom voltando aqui pra instalação certo como eu falei anteriormente né Nós temos dois modelos de instalação atualmente ok que é aí o Mac e e o Linux

futuramente vão estar trazendo aí pro Windows Ok tanto o Mac quanto o Windows ele traz pra gente aí uma interface gráfica né e da da instalação aí do olama ok Um pouco semelhante ali com o chat PT né antes da última atualização Beleza já que o modelo de instalação que a gente vai fazer como vai ser pelo Linux ele vai ser um modelo mais cru mesmo ok pra gente utilizar só a pay dele que a gente vai estar utilizando tanto ali dentro do flois quanto o no no n8n beleza e bom pessoal vamos deixar de

enrolação e vamos embora para esse vídeo bom pessoal eu gostaria de pedir aqui para vocês iniciar essa instalação certo para vocês se inscrever no no meu canal Porque grande parte de quem assiste meus vídeos não é inscrito no meu canal e eu gostaria de pedir para vocês para eu continuar trazendo vídeos como esse de qualidade aqui dentro do YouTube mais conteúdos como esse eu gostaria de pedir para vocês se inscrever no canal e deixar aquele like para poder e fortalecer e bom pessoal eu já tô conectado aqui dentro da minha VPS beleza e pra gente

fazer essa instalação é a gente vai precisar aí eh desse material de apoio que vou estar deixando aí na descrição do vídeo onde vai ter um link para vocês acessar o meu site beleza e lá descendo lá embaixo no site vocês vão encontrar um botão de download para poder estar baixando aqui esse material de apoio beleza para você estar acompanhando essa instalação junto comigo e bom pessoal eu gostaria de falar aqui rapidinho Certo Sobre a VPS que a gente vai estar utilizando para fazer a instalação dessa aplicação beleza as minhas recomendações pelo tempo de experiência

utilizando o olama eu vou est aqui passando a minha recomendação de qual máquina a gente precisa est utilizando Ok bom o que eu recomendo pra gente poder utilizar aqui o olama Eu recomendo a gente utilizar não uma VPS mas S um server dedicado ok Porque essas aplicações ela ela consumem bastante Ram bastante Ram bastante memória Ok e bastante também do processador beleza e aí se você tiver uma VPS fraca ele vai est demorando para te trazer respostas não vai processar muito bem enfim até porque é uma inteligência né é dentro da tua máquina e requer

uma máquina forte Ok se você for utilizar ali é uns parâmetros mais simples a gente consegue ver aqui nos modelos que a gente vai utilizar vamos ver aqui os modelos eu vou est utilizando o lama do aqui como exemplo aqui para vocês mas a gente pode utilizar qualquer outro e aqui ele traz aqui os requisitos pra gente utilizar cada modelo certo nós temos diversos modelos dentro do do lama 2 temos um modelo com 7 bilhões de parâmetros 13 bilhões de parâmetros e 70 bilhões de parâmetros e cada ele tem aqui os seus requisitos como vocês

podem ver aqui oito de Ram que é preciso 16 de Ram e 64 GB de Ram Ok eu vou est utilizando um modelo simples aqui porque a VPS que eu vou est utilizando ela não é tão potente Beleza ela só tem aí 16 de Ram e o cor dela é um pouco baixo Então vou est utilizando esse de 7 bilhões de parâmetros Mas o que eu recomendo para vocês é utilizar uma VPS dessas aqui entendeu com um processador forte e uma boa quantidade de memória RAM aí pra gente poder est trabalhando Ok se vocês querem

utilizar umas mais em contas vocês também pode estar utilizando aí né uma vds Ok a contáb ela oferece pra gente aí essas é o que são essas vds é como se fosse uma VPS só que dedicado Ok onde ele também tá com um preço até interessante aqui para nós beleza esse daqui ele já atende ali já pra gente utilizar uns parâmetros eh utilizar um modelo um pouco mais baixo com menos parâmetros beleza e bom vamos voltar aqui pra instalação o que eu já tô conectado aqui dentro da minha VPS e pra gente fazer essa instalação

o primeiro comando que a gente vai rodar vai ser esse daqui certo Opa deixa eu fechar aqui vai ser esse primeiro aqui que vai ser o responsável por baixar aí os repositórios necessários aí pra gente poder tá fazendo essa instalação dessa aplicação beleza vamos esperar ele instalar tudo aqui se ele pedir pra gente digitar e Yes a gente digita aqui beleza e pronto opa não deu certo porque ele abortou ali se ele abortou é porque não deu certo então vou colocar Y maiúsculo aqui agora coloquei minúsculo por isso que não deu certo então se ele

abortar né acontecer isso aqui com vocês né ele vim aqui com o nome aborte depois de vocês digitar Y digita aí novamente beleza algumas vpss elas acabam tendo esse pequeno problema aí e às vezes acaba passando despercebido certo e pronto pessoal esperei aqui ele terminar de fazer aqui as instalações necessárias ok pediu para digitar mais alguns Z não fi digitando e bom ele terminou aqui de fazer aqui certa instalação aí do que eu precisava beleza e o próximo comando que a gente vai rodar vai ser esse daqui ele vai ser responsável por rodar o script

de instalação do olama Ok vamos executar ele aí beleza e ele já vai iniciar o download aí do olama dentro da nossa máquina VPS Ok vamos esperar ele terminar aqui pronto pessoal ele terminou aqui né de instalar aqui o olama certo e agora a gente vai rodar aí o próximo comando ok que vai ser esse daqui esse daqui ele vai ser responsável por baixar aí né o modelo que a gente quer tá utilizando como eu vou utilizar o modelo do lama 2 certo eu vou estar utilizando esse daqui mas se você quiser estar utilizando outro

modelo é só vocês acessar aqui certo o o lama clicar aqui em modelos e ele vai trazer diversos modelos para você ok lama 2 Mistral neural chat 2 sem censura e outros aí que você pode estar utilizando beleza eu quero estar utilizando o lama 2 com 7 bilhões de parâmetros Ok então deixa já eu deixa eu só deixar aqui 7B beleza para não ter erro Ok copiar aqui 7B colocar aqui beleza e vou aqui né dar um pull para el poder baixar aí essa esse tipo de modelo beleza ele já traz aqui já também aqui

né o peso já desse modelo né ele pesa aí 4ro GB beleza vamos esperar ele fazer aqui a instalação desse modelo e aí a gente já inicia ele aqui beleza pronto pessoal ele já fez aqui já a instalação certo do modelo que eu né coloquei aqui para ele baixar né FL uma 2 com 7 bilhões de parâ certo agora pra gente poder utilizar esse modelo certo a gente precisa criar um prox reverso beleza E é isso que a gente vai fazer agora vamos aqui né seguir aí com os próximos comandos Ok se vocês querem estar

testando vocês podem estar utilizando Esse comando aqui ok que ele vai estar iniciando aí o modelo e aí tu consegue né tá trocando conversando com ele através da o próprio terminal mesmo beleza aqui vocês mandam uma mensagem e aí conversa com ele beleza vou dar um cont control c aqui para poder sair certo opa não é barra buy que sai beleza que não cara tá utilizando agora não então vamos embora lá certo o comando que a gente vai estar utilizando vai ser esse daqui beleza que ele vai ser responsável pra gente abrir aí um editor

de texto para criar o nosso prox reverso pra gente poder est utilizando tanto ele aí dentro do n8n quanto dentro do flo ising beleza tá fazendo as requisições aí para dentro dele ok a gente executou ise como aqui para criar aí um arquivo de texto né E a gente vai copiar daqui ó da da chave até server beleza e vai tá colando aqui ok e aqui a gente vai colocar né onde tem aqui né esse domínio certo a gente vai colocar aí o nosso subdomínio beleza vejamos aqui deixa eu criar aqui um subdomínio rapidinho vou

criar um aqui é dentro da flare beleza pronto eu já tô aqui dentro da minha Cloud vou est criando aqui né um adicionar um registro né Sem prox e vou est criando aqui certo é um para pro meu aama beleza vou chamar aqui de olama olama vou colocar o IP dessa VPS beleza e aí vou clicar aqui em salvar Ok e pronto já já tá salvo vou copiar aqui o subdomínio e vou tá colocando aqui o subdomínio aqui certo dentro aqui da substituindo né aquele subdomínio que já tava aqui de gestão pcom beleza e aqui

a gente não mexe mais nada tá um cont control x y enter beleza e aí o próximo comando que a gente vai estar utilizando vai ser esse daqui para criar o link simbólico desse prox rever que a gente tá criando aí certo e o próximo comando vai ser esse daqui Ok onde aqui a gente vai substituir pelo o subdomínio que a gente criou ó lama de gestão pcom que no caso foi o que eu criei certo vamos copiar aqui vamos torcer para já tá propagado e dar tudo certo perfeito pessoal sinal de que deu tudo

certo se eu copiar aqui né esse esse subdomínio aqui que a gente criou o prox reverso vim aqui no navegador colar aqui é para ele trazer pra gente aqui dizendo que o olama está rodando sinal de que tá tudo certo agora Armando como é que eu faço para poder tá conectando ele aí dentro do meu Flu dentro do meu in bom é muito muito simples vocês não precisam estar gerando chave de autenticação nem nada do tipo Ok é só tá pegando o subdomínio de vocês que vocês criaram e tá colocando aí dentro do dentro ali

da credencial ali do flois dentro do n8n né junto com o modelo que você quer estar utilizando vou est mostrando isso na prática aqui com n8n Vou acessar aqui meu n8n com fuiz também é muito fácil só que eu não tô com Flu aqui instalado agora OK então vou estar fazendo aqui com vocês aqui com n8n beleza isso daqui é o meu N8 já temos várias I rodando aí dentro dele e pronto pessoal a gente vai criar um fluxo aqui dentro do unn certo utilizando aí é a api aí do do olama certo vamos clicar

aqui vamos adicionar aqui um manual a gente vai fazer mesmo só uns testes aqui só para mostrar para vocês funcionando OK vou utilizar aqui a inteligência artificial Vamos colocar aqui um llm certo e aqui a gente vai colocar o modelo de linguagem aqui o olama vamos procurar aqui olama modelo já achou aqui certo a gente vai criar uma credencial aqui nessa credencial a gente vai colocar aí é a URL aí do nosso olama vamos procurar aqui cadê Aqui certo vamos voltar aqui vamos colar aqui vamos salvar é muito simples ele Já identificou aqui já fez

a conexão já da nossa credencial E aí ele já traz pra gente aqui os modelos que a gente pode estar utilizando como vocês podem ver certo e bom vamos fechar aqui a gente já selecionou o modelo já criou aqui agora a gente vai fazer uns testes aqui dentro da nossa do nosso chat aqui vamos enviar uma mensagem para ver o que que ele vai retornar pra gente salvar aqui Enviar uma mensagem aqui vou dar um um molar como eu tô utilizando aqui um parâmetro com tô utilizando um modelo com sete 7 bilhões de parâmetros é

um modelo Zinho bem fraquinho certo assim por dizer é muito inteligente eu acho que ele vai me responder em inglês vamos ver aqui olha aí como vocês podem ver certo ele já tá funcionando aqui para mim aqui fui eu mandando uma mensagem né Olá e aqui ele respondendo aqui para mim ok e aqui eu já posso já conversar com ele pode me ajudar como uma receit de Polo Ele demora um pouco para responder aí dependendo do que eu pergunto para ele porque eu tô utilizando uma VPS que não é muito forte certo uma VPS um

pouco fraca Ok porque na verdade o recomendado é utilizar um servidor dedicado não em uma VPS OK aí ele tá rodando aqui certo ele vai responder aqui pra gente se eu colocar aqui na minha VPS aqui aqui é uma VPS que eu tô utilizando aqui com oito núcleos falei que era 16 de Ram mas na verdade ela é 24 de Ram certo e aqui é o consumo dela como vocês podem ver aí ele tá consumindo aí né é bastante certo da CPU como vocês podem ver certo porque aí é uma inteligência né rodando aí dentro

da nossa máquina ele tá consumindo aí 400% aí da nossa CPU certo e vamos ver aqui o que que ele vai retornar pra gente e pronto ele trouxe aqui a resposta aqui para mim como vocês podem ver certo agora ele até respondeu em português certo como vocês podem ver aqui com certeza vem aqui algumas receitas de bolo que você pode preparar ele já trouxe aqui para mim aqui as receitas como vocês podem ver aí certo uma inteligência aí bem legal de estar trabalhando tô utilizando modelo assim com com apenas S 7 bilhões de parâmetros vocês

podem utilizar modelos mais fortes ainda certo bem mais inteligentes para poder est trabalhando certo a resposta aqui Demorou cerca de 1 minuto ou 2 minutos aqui para mim responder Ok por causa aí da da minha máquina se vocês colocar numa máquina mais potente aí a qualidade de resposta certo e o tempo aí vai ser bem mais curto certo vocês vão ter uma qualidade aí maior bom pessoal o vídeo foi esse espero que vocês tenham gostado se vocês querem estar entregando essa inteligência artificial com o seu WhatsApp vou est deixando no card aqui em cima um

vídeo onde ensina você criar sua inteligência artificial e vincular ele com WhatsApp a utilizando Flow a em vez de utilizar o chat PT você pode estar utilizando o próprio olama Ok para fazer essa integração aí e vincular ele aí com o seu WhatsApp beleza e bom pessoal o vídeo foi esse Espero que tenham gostado deixa o like se inscrevam no canal beleza para não perder mais nenhum vídeo como Esse valeu n

![Review do modelo de IA para ambiente local projeto [Ollama.ai]](https://img.youtube.com/vi/QEk5orlryeg/maxresdefault.jpg)