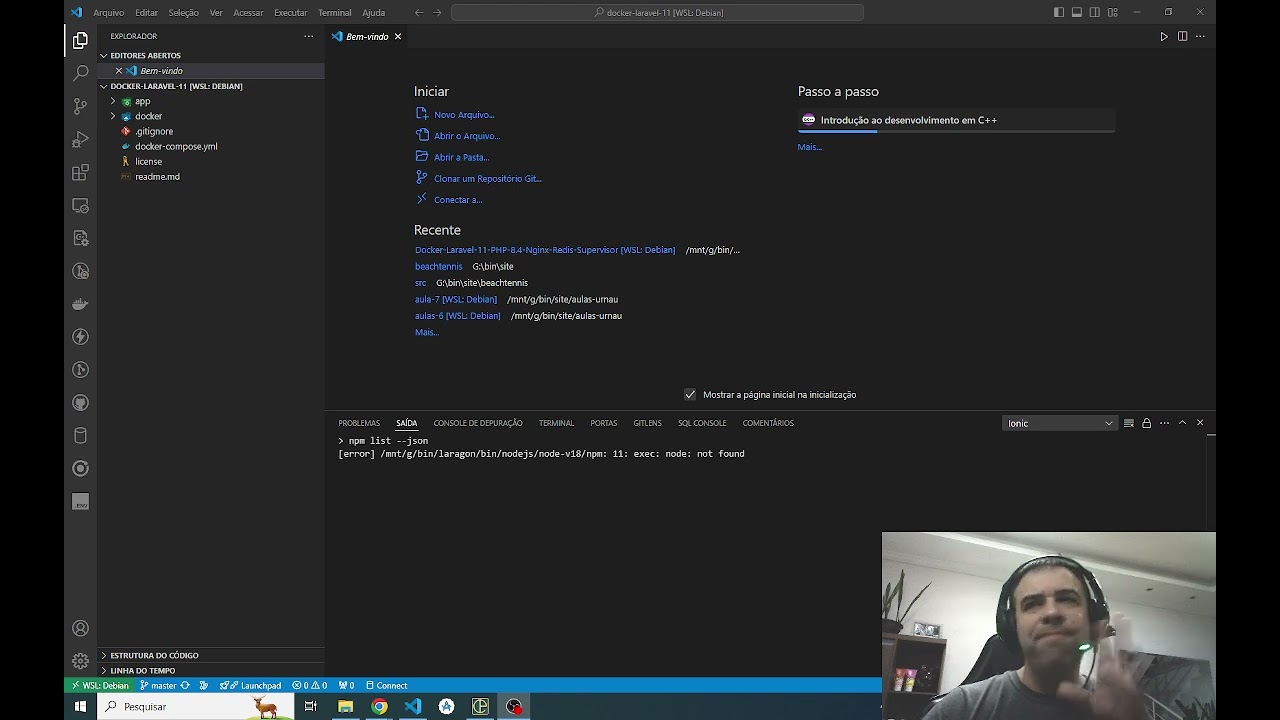

Fala galera T de boa seguinte Vamos começar agora mais um vídeo aqui no canal e nesse vídeo eu vou te ensinar como você consegue utilizar o Lama no seu computador sem precisar por exemplo baixar Esse modelo no seu computador como a gente faz com o olama né e eu vou te ensinar utilizando uma chave API de um serviço que é gratuito Então você vai utilizar o lama do seu computador quantas vezes você quiser de forma 100% gratuita show de bola então se você na verdade antes de prosseguir né se você não me me segue aqui por exemplo no YouTube se você não é inscrito no canal já clica aqui se inscreve porque Bom basicamente meu canal é um Hub de Inteligência Artificial e se você tem interesse é o melhor local para você poder aprender e no final do vídeo eu nem vou te pedir o like agora se você gostar desse vídeo ao final vou te pedir para você deixar o like porque vai me ajudar demais show de bola então vamos aqui pro tutorial como que a gente vai fazer primeira coisa de tudo vocês vão entrar no site que tá aqui na descrição chamado console. gcp de inteligências artificiais de modelos de linguagem tá na verdade não só modelo de linguagem a gente vai ver que tem o Whisper por exemplo que é o modelo de transcrição tá de áudio para texto no caso E por que que ela é muito boa né Qual que é o diferencial da groc bom antes disso eu quero explicar alguns termos para vocês Caso vocês não saibam vocês conhecem sobre cpus gpus provavelmente Vocês já ouviu falar né e o que que são CPU CPU é Central processing unit ou unidade de processamento Central é basicamente o seu processador o processador do seu computador quando a gente tá falando de GPU é Graphic processing unit que no caso é a sua placa de vídeo se você tem no caso uma placa de vídeo você tem ali uma GPU show de bola e aqui a grock o que que eles fizeram eles fizeram o que a gente chama de lpu que é língua de processing Unity ou unidade de processamento de linguagem então eles fizeram um hardware ou seja o o componente do seu computador específico para poder rodar modelo de linguagem de forma mais rápida e por isso que a inferência o tempo de inferência deles ou seja a o tempo de resposta do do modelo né de linguagem é muito mais rápido entendeu então é um serviço excelente e a gente pode utilizar esses serviços da grock a partir das apis E no caso aqui a gente vai utilizar o lama Beleza então que que a gente vai fazer vai clicar aqui em login né eu vou logar aqui com meu github no caso vou clicar aqui em login with github show de bola ele já entrou aqui para mim que que eu vou fazer vou criar uma chave api Então vou vir aqui em API Keys Beleza vou clicar aqui em Create api Key vou colar colar no caso tutorial YouTube tranquilamente submit e vou copiar essa chave api não compartilhem essa chave api com ninguém ela é sua nesse caso aqui não vai dar tanto problema por quê Porque a chave ap api da groc a groc é um serviço gratuito então não vai dar problema mas quando você tiver utilizando por exemplo a chave api da Open Ai que é um serviço pago se alguma pessoa tiver acesso à sua chave api ela vai poder utilizar os modelos da Open ai e vai descontar no seu cartão então não compartilha esse código aqui com ninguém beleza Beleza então já copiei vou vir aqui no Google colab e vou clicar aqui na chave clicando aqui na chave eu vou clicar em Adicionar novo segredo aqui eu vou colocar grock api ke vou colar aqui em valor o no caso o código que a gente copiou beleza e show de bola a partir disso vocês estão vendo que ele até fornece aqui um código de exemplo pra gente né eu vou clicar aqui em copiar tá vendo cliquei aqui copiei e já vou olha só vou clicar aqui então quando eu faço isso vou colocar aquele mesmo o mesmo mesmo nome que eu coloquei né grock api Key e vou clicar aqui em executar Olha o que que ele me retorna conceder acesso ele vai me retornar justamente aquele código então dessa forma aqui eu já tô ensinando vocês a que a não colocarem a chave api explicitamente no seu código você fornece ela desse jeito aqui no caso para para uma pessoa que tiver olhando seu código ela não consegue ver a sua chave api ela só roda por trás Então vou salvar esse valor numa variável chamada grock api ke beleza a partir disso bom a gente já tem ela aqui no nosso e no nosso código totalmente salva e agora como que a gente faz para utilizar o lama de Fato né A gente vai ver aqui no site da grock em documentação beleza clicando aqui em documentation eu vou clicar aqui em E no caso aqui ele já te dá um passo a passo né então primeira coisa a gente tem que fazer é instalar a grock Então vou PIP Olha só PIP instal grock a partir disso ele vai instalar aqui é a biblioteca pra gente então é só esperar um pouco beleza já instalou e aqui tem um passo a passo então o que que a gente vai fazer ó vou copiar esse código vou colar aqui eu poder te explicar Ele tá importando aqui duas bibliotecas a biblioteca aqui operational System ou sistema operacional e a biblioteca aqui da grock Beleza então ele tá importando aqui olha só o que que acontece aqui ele tá pegando aave api aqui no da chave api eu já vou substituir diretamente na variável que a gente salvou a nossa chave api que é grock api beleza eu poderia muito bem simplesmente só fazer isso aqui ó só fazer isso aqui diretamente que aí ele já vai pegar a iepi aqui e vai salvar direto aqui beleza eu vou deixar o código só assim por enquanto tá então ó a gente já tem um cliente aqui da groc totalmente feito configurado você pode ver que não deu nenhum erro então a gente já configurou beleza e agora a gente vai fazer o seguinte a gente vai colocar aqui no caso é qual que é o nosso a nossa query né Qual que é o nosso a nossa pergunta para I e qual que é o modelo que a gente quer usar então por exemplo se eu vier aqui ó em models eu posso clicar aqui em models e você vai ver o tanto de modelo que a gente tem então não é só o lama a gente tem o gema por exemplo dois é a gente tem o Whisper que eu falei que faz transcrições a gente tem aqui vários e vários modelos Beleza tem o lava que é o modelo de visão então bom para aqui fingir exemplo eu vou utilizar o lama é 3. 1 70 bilhões Beleza então vou copiar aqui janela de contexto de 128.

000 tokens então é um modelo muito bom vou só tirar aqui esse Model e vou dar um cont CRL V aqui ó só copiei Beleza o Model id e colei aqui em Model beleza a partir disso eu vou perguntar uma coisa para ele vou perguntar o seguinte pode me fornecer eh um título otimizado para seo para o meu blog de Ia onde farei um post sobre hag por exemplo onde falei um pouco sobre hag e aqui ó ele vai me dar totalmente a resposta então deixa eu Opa Deixa eu só copiar isso aqui vou executar vou executar e agora Olha Só se eu der um print ele vai falar assim Claro aqui estão algumas opções de título otimizado para se para o seu blog sobre hag hag o que é e como funciona a geração de resposta por ia introdução a haag geração de respostas com ia com base em dados então você pode ver que a gente tá utilizando aqui no nosso computador de forma 100% gratuita o o lama né então aqui na grock a gente pode utilizar muitos e muitos mais modelos então você pode ver aqui que a gente tem é o lama 3. 2 né que é o novo lama aí que surgiu o de 90 bilhões que vai vir em breve Então a gente tem vários e vários inclusive o Whisper e aqui a gente consegue fazer transcrições de forma 100% gratuita de áudio então imagina a quantidade de aplicações que você pode construir em cima disso Beleza então a grock ela funciona basicamente aqui nesse formato eh você consegue utilizar a grock também aqui com base em requisições http mas eu não vou ensinar dessa forma porque enfim assim é mais simples né da gente poder é como é que eu falo da gente poder iniciar o nossos estudos e aí você pergunta ah mas como que eu forneço contexto bom é é um pouco mais complexo aí tem que saber um pouco mais de Python porque a gente vai adicionando aqui nessa lista de mensagens um dicionário com o o o cargo né vamos supor assim que no caso seria de usuário e aqui de content eu poderia colocar aqui por exemplo olha só vou colocar aqui um novo dicionário só para vocês terem uma noção do que é possível fazer né isso a gente pode fazer no próximo vídeo inclusive se você quiser um vídeo mais aprofundado trabalhando aqui com essa com a ap da GR me fala aqui que aí eu consigo testar o WH o Whisper né consigo testar o lama com vocês e vários outros modelos de forma mais Prof mas aqui eu vou fazer o seguinte o Roll eu falar é System então aqui no é o é o próprio sistema o cargo tá eu falar que o conteúdo noo aqui vai o System prompt ou seja qual que é aquela I eu dizendo ela o que que ela deve como que ela deve agir Beleza então vou falar o seguinte você é um assistente de ia muito formal sempre chama as pessoas de Senhor beleza por exemplo eu vou falar só Senhor e não Senhora porque ele tá falando comigo aqui beleza então você conversa com o senhor Anor hermus Sempre beleza show de bola a partir disso ele já vai ter essa noção agora quando executar de novo isso aqui olha o que que vai acontecer Senor an hermus é um prazer lhe fornecer um título otimizado para se para o seu blog de A então note como que a gente consegue trazer respostas muito melhores aqui né utilizando o próprio lama de graça Então esse tutorial aqui é justamente para poder ensinar vocês a como Vocês conseguem utilizar essas ferramentas gratuitas e um spoiler a maioria das tarefas que você vou fazer muito provavelmente você não vai precisar de um serviço pago como da própria Open ai esse serviço aqui já vai dar muito certo e aí tem um outro detalhe para poder te falar que é se a api aqui da groc cair ou seja se a grock falir de um dia pro outro a sua aplicação pode cair também então tem uma coisa que a gente chama de routing deixa eu até escrever aqui ó tem uma coisa que a gente chama de routing e routing é basicamente O quê é quando você redireciona eh um llm para outro por exemplo quando um deles cai então é basicamente isso de forma muito muito simplista tá routing é o qu é roteamento Então pensa que o serviço da grock cai qual que é o que você tem de de backup entendeu caso ele caia então é basicamente isso que acontece na verdade você tem esse tipo de routing você tem routing para tarefas específicas então você pode em uma aplicação ter vários modelos como o cloud 3.