[Música] vencida essa etapa aqui né de de gerarmos o hop agora vamos falar um pouquinho sobre o treinamento né como que a gente envidou esforos em usar o dataset que nós geramos ter o hop aqui como informação externa e derivar modelos ótimos não supervisionados né de modelo de agrupamento de clustering das petições iniciais Então vamos falar um pouquinho sobre esse treinamento então o fluxo do treinamento né segue aqui o ter um dataset a gente precisava desse dataset dataset já falei aí né como a gente gerou ele esse dataset ele entra como insumo tanto para um

modelo para fazer uma segmentação aqui eh eh do espaço de petições iniciais quando a gente tá olhando aqui para esses círculos aqui imagina que a gente fez uma aplicou um algoritmo não supervisionado E ele segmentou separou as nossas petições iniciais em diferentes grupos agora eu quero verificar se se essa separação ela é uma separação boa pode ser aproveitada ou ela ou ela carece de melhorias né Então essa segmentação ela entra pro otimizador esse dataset também entra e o hop que nós já vimos né essa informação dos rótulos eh de um subconjunto das amostras rótulos de

precedentes qualificados em cima de um subconjunto das amostras ele entra aqui no otimizador também esse otimizador vai dizer pra gente como está eh digamos assim a saúde desse modelo não supervisionado ele está sendo assertivo não está sendo assertivo né então com essa métrica a gente consegue tentar outra vez buscar outra solução eh fazer outro treinamento desse modelo não supervisionado sem buscar soluções melhores ou seja a gente viabilizou agora desenvolver um processo interativo de busca da melhor solução de um classificador não supervisionados para as petições iniciais né então com isso Nesse contexto a gente investigou várias

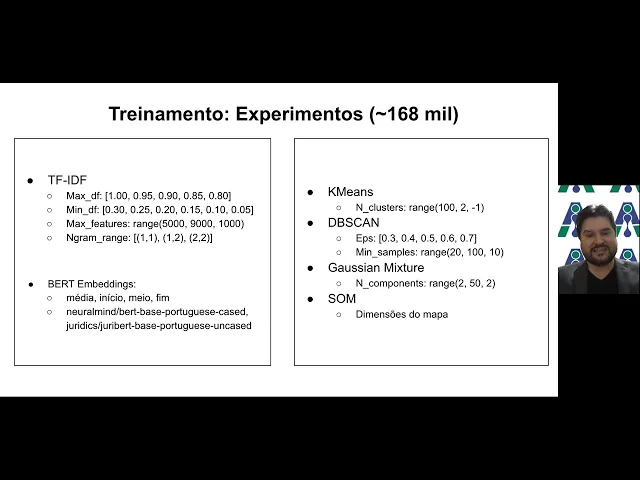

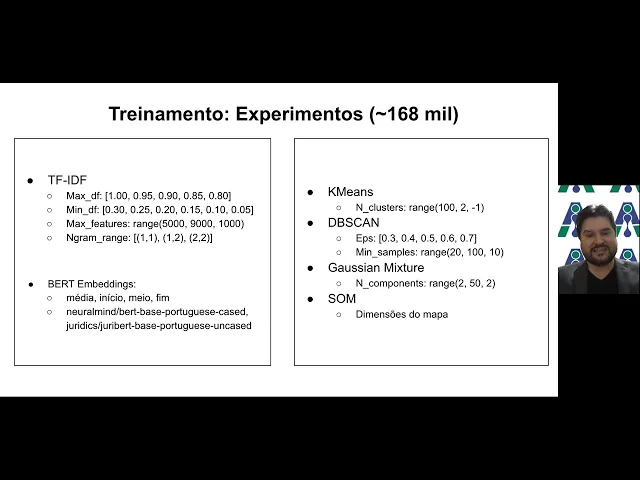

técnicas né nesse nessa fase de Treinamento a gente investigou várias técnicas tanto de transformação do dado descritores de texto quanto também algoritmo de agrupamento então Eh técnicas de imbed por exemplo nós testamos T fdf Bert algoritmos particiona né são os algoritmos não supervisionados investigamos c médias dbscan mistura galciana redes de corrone né que aqui é o som self organized map e também eh usamos como eu já disse a métrica de o r ajustado para eh como sendo uma métrica para medir a qualidade desses modelos né então isso aqui foi uma fase de pesquisa nós testamos

então aqui várias técnicas de embeds vários algoritmos não supervisionados e usamos uma métrica aqui que é o o Hand index ajustado para fazer eh eh Para apoiar o otimizador em busca do melhor modelo da melhor configuração então isso aqui é um um trabalho árduo é de pesquisa de experimentação passamos uma uma quantidade de tempo razoável com equipe equipes dedicadas a investigar quais os melhores modelos aqui qual a melhor conjectura de solução aqui só alguns detalhes né de parâmetros que nós amos tanto do TDF dos imbed do best eh modelos não supervisionados como eu disse o

camas dbscan e mistura galciana e redes de corrone aqui esse aqui são é é o espectro aí do dos parâmetros que nós eh ficamos experimentando buscando uma solução ótima sobre eles Resumindo mais ou menos nós fizemos mais um pouco mais de 168.000 experimentos para chegar na solução que nós entregamos aqui pro CNJ variando todas essas esses parâmetros que estão na tela bom uma vez que a gente eh fez essas buscas né Chegamos no modelo matematicamente ótimo pela métrica agora nós precisamos validar se esse modelo ele precisávamos validar esse modelo mais uma vez que a gente

entendeu como sendo padrão ouro o que que era o padrão ouro era uma avaliação do especialista da regra de negócio o time de de direito entrou em cena novamente né E eles avaliaram 36 processos e a avaliação se deu da seguinte forma primeiro uma avaliação cega eles pegaram esses processos na realidade pegaram nós foi entregue a eles apenas as petições iniciais ao que eles precisavam ler essas petições iniciais e indicar livremente Qual é o rótulo que eles colocariam naquela petição inicial em se tratando de precedente qualificado não é então quando você est vendo na tela

aqui eu tenho o número do processo o tema rotulado livremente né e depois nós pegamos esses mesmos processos rodamos na nossa solução ao que ela entregou eh eh a aqueles rotos que ela eh eh inferiu e no segundo momento nós entregamos essa essa esse resultado para o time direito validar né então a ideia foi essa primeiro um teste cego e PIS uma validação da resposta que a ferramenta trouxe Então essa foi a metodologia em que nós eh passamos pelo crio do do pessoal do direito o resultado da ferramenta então em termos de volume foram 36

processos analisados o pessoal do direito leu um pouco mais de 970 páginas de texto para fazer todas essas análises e dentro desses 36 processos apareceram esses temas que estão na tela aí do STJ e do STF né Eh os resultados estão aqui eh apresentados em termos de cada método aqui né então nós temos aqui em azul o resultado que o cé é umum tipo de algoritmo de agrupamento trouxe o DB Scan em vermelho em laranja em verde as redes de corrone que é o som e em vermelho a mistura galciana o Nossa solução Ela tem

ela tem um um parâmetro que eu vou explicar eh em aqui nas próximas transparência que é um parâmetro livre que ele permite ao usuário final parametrizar a elasticidade a rigidez ou conceito contrário da elasticidade da ferramenta então a gente ele pode aplicar uma rigidez maior querer por exemplo que ele seja aqui no eixo X aqui ó que ele tenha uma similaridade mínima de 90% para que aquilo seja entregue como sendo o rótulo 90% 70 e 60 foram feitos vários testes com diferentes cortes e aqui estão aí eh nesse gráfico a avaliação dos métodos de agrupamento

que nós tivemos com o melhor descritor que nós encontramos aqui para essa solução em específico que foi o TF DF né e na no eixo Z aqui a gente tem um percentual de acerto dentro dessa desse desse conjunto de validação aí de de teste que nós passamos pro time de Direito de 36 processos aqui uma vez identificado A melhor solução le TF DF eh E também o melhor modelo que se apontou aqui foi o cdias Né o DB Scan deu uma solução muito parecida com camas se a gente olhar aqui DB Scan e Camas sempre

estavam concorrentes aqui mas nós optamos em em Direcionar para o cames por ser um com a complexidade algorítmica menor ou seja ele roda mais rápido eu não preciso de tanto requisito de hardware para para rodar esse algoritmo eh então aqui né Aqui nós estamos nessa transparência vendo os resultados que nós alcançamos eh com K médias tá o eixo Y aqui ainda o percentual de acerto e estratificando os dados aqui pro TJ RO tjrr TJSC e trf5 né aqui com entes cortes né 70% 71 70 Eh Ou seja na realidade foi um corte só né a

gente eh eh eh junto com o pessoal de direita esse corte aqui Foi verificado que ele era um corte ótimo para esse caso específico aqui volta de 70% e aqui a gente tem aqui os resultados eh do percentual de acerto e nós tivemos com essa ferramenta né Então tá variando aí um mínimo de 78 P7 um máximo aqui de 92.0 [Música]